Видать, MSI забросила к Guru3D сразу обе последние видеокарты линейки Lightning (я даже подозреваю, что не в единичном экземпляре каждую), пару дней назад я публиковал пересказ их обзора HD 6970 Lightning, а сегодня post'ю аналогичный материал про GTX 580 Lightning. Интересно будет сравнить два этих продукта с одинаковой системой охлаждения по уровню шума и рабочим температурам.

Видать, MSI забросила к Guru3D сразу обе последние видеокарты линейки Lightning (я даже подозреваю, что не в единичном экземпляре каждую), пару дней назад я публиковал пересказ их обзора HD 6970 Lightning, а сегодня post'ю аналогичный материал про GTX 580 Lightning. Интересно будет сравнить два этих продукта с одинаковой системой охлаждения по уровню шума и рабочим температурам.

Для начала нам предлагают посмотреть на сводную таблицу с характеристиками различных решений от Nvidia, что вышли за последние несколько лет:

| GeForce 9800 GTX |

GeForce GTX 285 |

GeForce GTX 295 |

GeForce GTX 470 |

GeForce GTX 480 |

GeForce GTX 580 |

|

| Потоковые процессоры | 128 | 240 | 240 x2 | 448 | 480 | 512 |

| Частота ядра (МГц) | 675 | 648 | 576 | 607 | 700 | 772 |

| Частота шейдеров (МГц) | 1675 | 1476 | 1242 | 1215 | 1400 | 1544 |

| Частота памяти (МГц) | 2200 | 2400 | 2000 | 3350 | 3700 | 4000 |

| Количество памяти | 512 МБ | 1024 МБ | 1792 МБ | 1280 МБ | 1536 МБ | 1536 МБ |

| Интерфейс памяти | 256-бит | 512-бит | 448-бит x2 | 320-бит | 384-бит | 384-бит |

| Тип памяти | gDDR2 | gDDR3 | gDDR3 | gDDR5 | gDDR5 | gDDR5 |

| HDCP | Есть | Есть | Есть | Есть | Есть | Есть |

| Два DVI | Есть | Есть | Есть | Есть | Есть | Есть |

| HDMI | Нет | Нет | Нет | Есть | Есть | Есть |

Далее идёт детальное сравнение спецификаций референсной GTX 580 и героини сегодняшнего обзора:

| Графическая карта |

GeForce GTX 580 | GeForce GTX 580 Lightning |

| Тех.процесс производства | 40нм | 40нм |

| Количество CUDA ядер | 512 | 512 |

| Потоковые мультипроцессоры | 16 | 16 |

| Текстурные юниты | 64 | 64 |

| ROPы | 48 | 48 |

| Частота графического ядра | 772 МГц | 832 МГц |

| Частота шейдерного домена | 1544 МГц | 1664 МГц |

| Частота памяти | 1000 МГц / 4000 МГц | 1050 МГц / 4200 МГц |

| Объём видеопамяти | 1536 МБ | 1536 МБ |

| Интерфейс памяти | 384-бит | 384-бит |

| Пропускная способность памяти | 192 ГБ/с | 200 ГБ/с |

| Количество и тип коннекторов питания | 1x6-пин, 1x8-пин | 2x8-пин |

| TDP | 244 Ватта | 260 Ватт |

| Рекомендуемый блок питания | 600 Ватт | 600 Ватт |

| Максимальная допустимая рабочая температура | 97 градусов по Цельсию | 97 градусов по Цельсию |

Также как и в случае с HD 6970 Lightning, частотная формула ушла не очень далеко от референса. Хотя кому, кроме домохозяек, иностранцев и "жадных детей" интересен заводской разгон? ![]()

Фотогалерея MSI GeForce GTX 580 Lightning

Как и в прошлый раз, на тесты к Гуру3Д попала retail-версия новинки, т.е. ровно та же самая, что попадёт на прилавки магазинов в обозримом будущем.

Коробки у видеокарт семейства Lightning практически не изменяются на протяжении долгого времени, я думаю, что Вы это тоже заметили ![]() Если MSI читает эти строки - пусть обратятся ко мне, я им посоветую отличного художника, что смог бы помочь с дизайном будущих упаковок этих и других видяшек.

Если MSI читает эти строки - пусть обратятся ко мне, я им посоветую отличного художника, что смог бы помочь с дизайном будущих упаковок этих и других видяшек.

Видяшка во плоти, так сказать. Ценник у неё, камрады, не хилый - 499 долларов США. Будем надеяться, что стоимость установлена в соответствии с качеством продукта MSI.

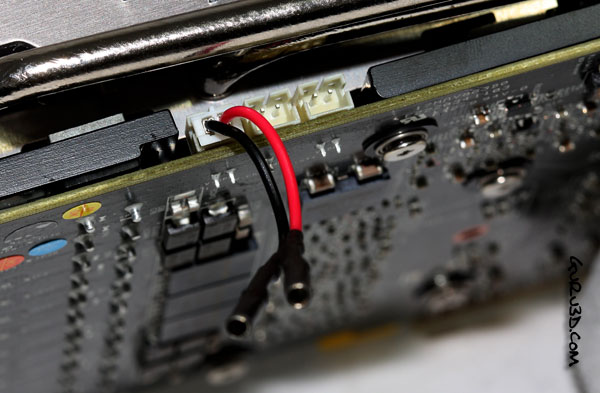

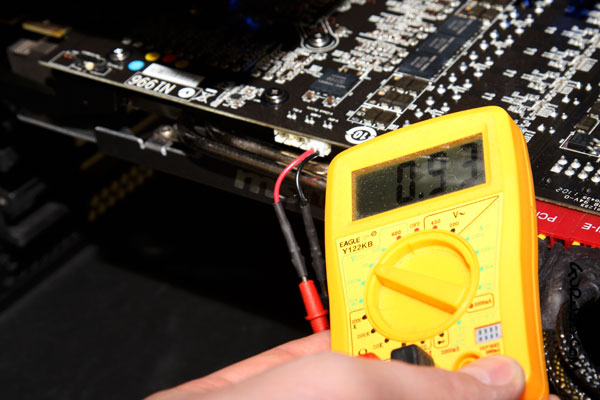

Рассмотрим комплект поставки: диск с драйверами, адаптер с DVI на D-Sub, переходник питания и два мостика-кабеля для объединения карточек в SLI. Как всегда, из особенностей видяшки семейства Lightning, можно выделить традиционные провода, служащие для более удобного замера напряжений в предназначенных для этого точках видеокарты.

И снова мы лицезреем "понты для нищих" - позолоченные видеовыходы. Кстати о последних - у MSI GeForce GTX 580 Lightning есть пара DVI, один DisplayPort и ровно такое же количество HDMI.

Отмечается, что длина видеокарты - 27 сантиметров. Для питания этого маленького монстра понадобится достойный БП с двумя 8-и пиновыми коннекторами (или можно воспользоваться переходником питания, что делают из двух 6-и пиновых один 8-и пиновый коннектор).

Два SLI коннектора говорят о том, что без труда (но с достаточными капиталовложениями) можно построить тандем из двух или трёх видеокарт N580GTX Lightning.

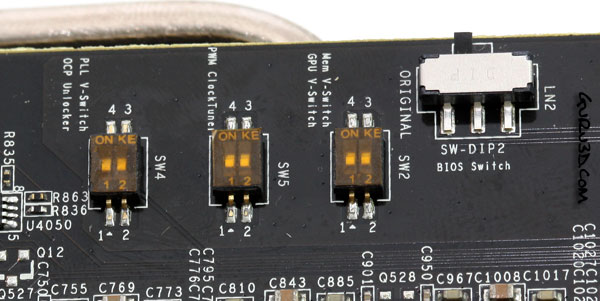

Тут подойдёт описание из предыдущего материала, его и вставлю - на фотографии выше показаны столь нужные любителям побаловаться с экстремальным (с применением жидкого азота, например) разгоном переключатели, снимающие определённые лимиты на возможности видеокарты (в том числе защиту от сверхтока, да и снятие ограничения по напряжению для памяти и графического ядра упомянуть будет не лишним).

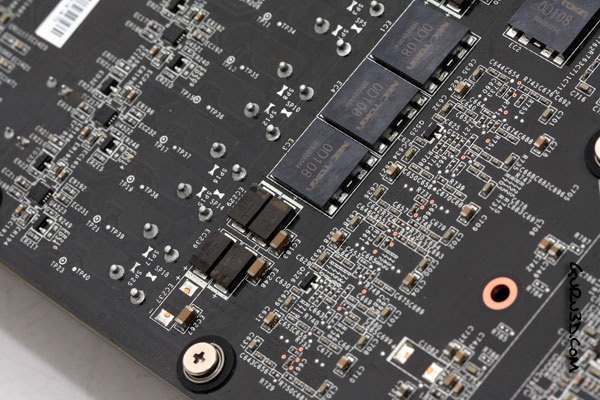

Без Proadlizer'ов не обошлось.

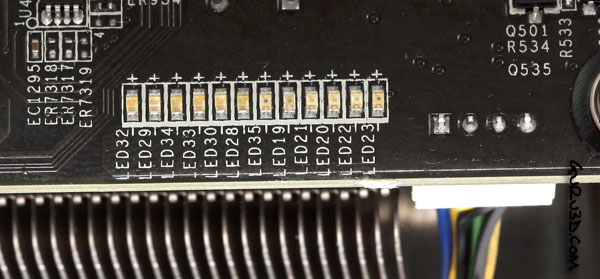

На фото выше показаны светодиоды, отвечающие за визуализацию активности фаз питания видеокарты.

Показано, как при помощи кабелей для замеров напряжения из комплекта видеокарты, это самое напряжение и замеряется мультиметром ![]() Такой способ, по мнению производителя, удобнее и безопаснее, чем традиционный.

Такой способ, по мнению производителя, удобнее и безопаснее, чем традиционный.

Энергопотребление/температурный режим/уровень шума

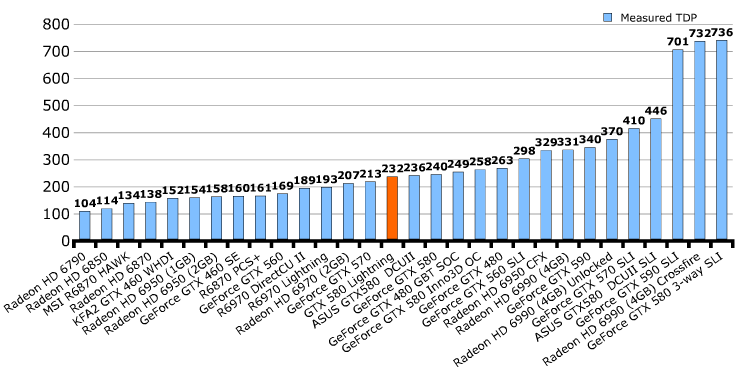

Энергопотребление видеокарты MSI GeForce GTX 580 Lightning

1. Система в режиме простоя потребляет = 175 ватт

2. Система с видеокартой в режиме полной нагрузки кушает = 382 ватта

3. Получившаяся разница = 207 ватт

4. Добавим среднее энергопотребление карты в режиме простоя ~ 25 ватт

5. И получаем энергопотребление в нагрузке = ~ 232 ватта

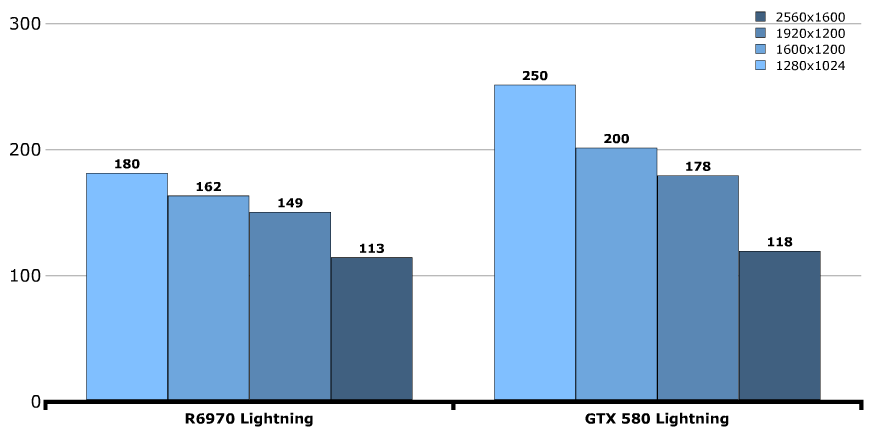

Как и положено, GTX 580 кушает больше электроэнергии, чем HD 6970 (это я решил сравнивать между собой оба новейших Lightning'а). Посмотрите на таблицу ниже, разница приличная.

Интересно - как сильно повлияют 39 ватт разницы на температуры карты и эффективность системы охлаждения? Для рассматриваемой видеокарты Guru3D рекомендуют обзавестись блоком питания не менее 600 ватт, а для SLI - 850+.

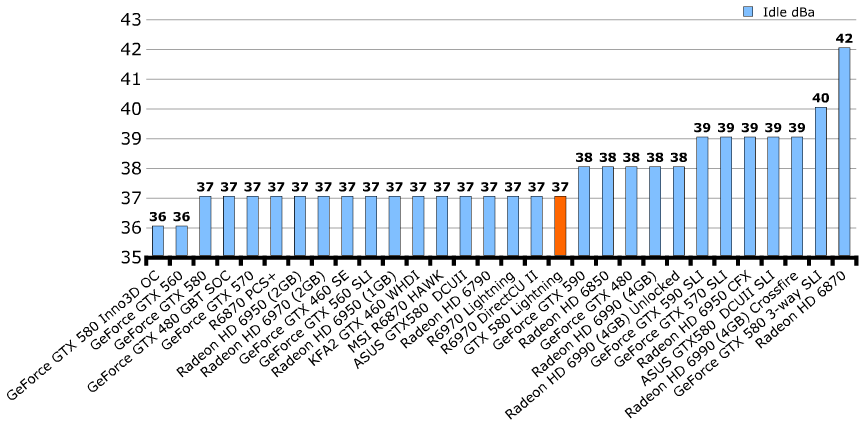

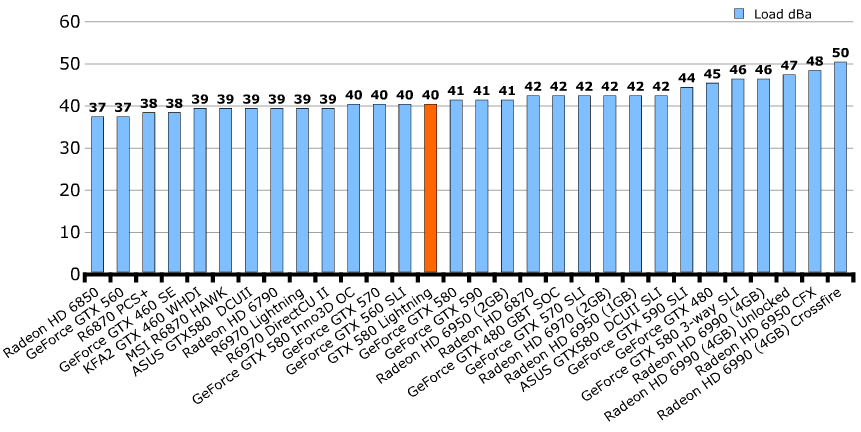

Уровень шума, издаваемый системой охлаждения видеокарты MSI GeForce GTX 580 Lightning

График номер один показывает, насколько тихо/громко работает система охлаждения нового творения MSI, а номер два показывает положение дел в нагрузке.

В простое между двумя "Молниями" паритет. Но что в нагрузке?

Как я и ожидал, в нагрузке шум от N580GTX Lightning выше, чем от "Радика", к счастью немного - всего на 1 децибел.

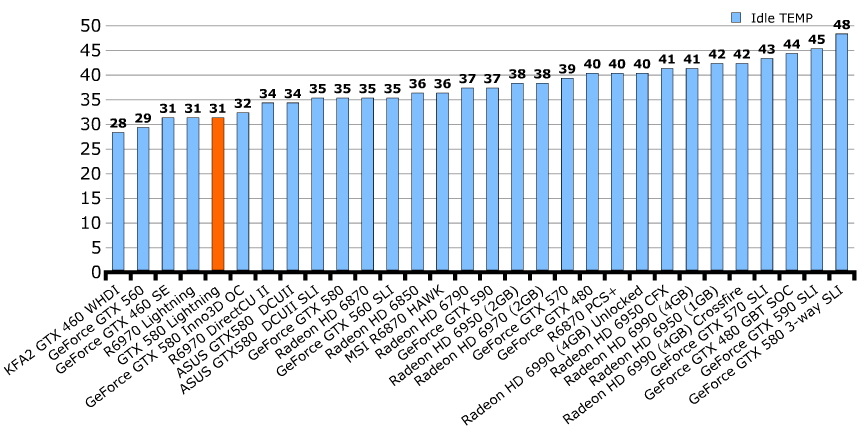

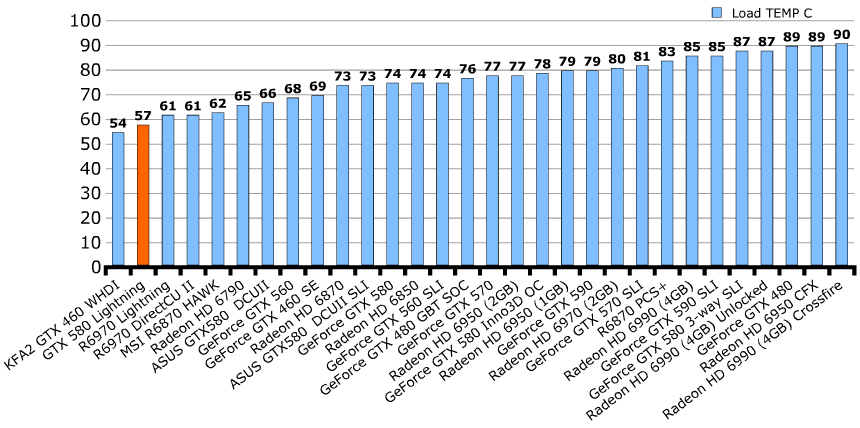

Температурный режим

В данном тесте ничего не меняется (и вряд ли что-то изменится) - сначала производится мониторинг температур в простое, потом - в нагрузке игрой.

Аналогичная ситуация - в простое карточки не отличаются одна от другой по рабочей температуре.

Ну вот уж чего не ожидал, так того, что GTX 580 Lightning продемонстрирует меньшие температуры в нагрузке, нежели чем HD 6970 Lightning! В чём же дело, как такое может быть? Может причиной тому послужила более громко работающая система охлаждения (а при идентичности СО можно утверждать, что более громкая = лучше охлаждающая)?

Конфигурация тестового стенда и используемые игры

Материнская плата - eVGA X58 Classified

Процессор - Core i7 965 @ 3750 МГц

Видеокарта - MSI GeForce GTX 580 Lightning (N580GTX Lightning)

Оперативная память - Corsair 6144 МБ (3x 2048 МБ) DDR3 1500 МГц

Блок питания - 1200 ватт

Монитор - Dell 3007WFP - разрешение до 2560x1600

Операционная система - Windows 7 х64

DirectX 9/10/11 End User Runtime (самые последние версии)

NVIDIA GeForce 260 <> 266.58 WHQL

Игры и синтетические тесты:

- Metro 2033

- Battlefield Bad Company 2

- Colin MC Rae Dirt 2

- Far Cry 2

- Call of Duty - Modern Warfare 2

- Crysis WARHEAD

- Anno 1404

- 3DMark Vantage

- 3DMark 11

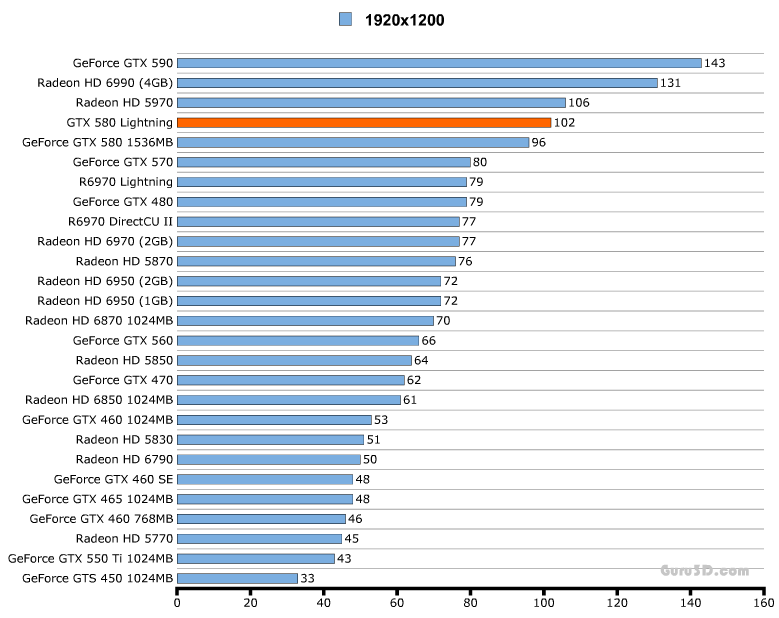

DX9: Call of Duty: Modern Warfare 2

Тестирование проводилось на следующих настройках:

- Уровень - Contingency

- 4x Антиалиасинг

- 16x Анизотропная фильтрация

- Все настройки на максимум

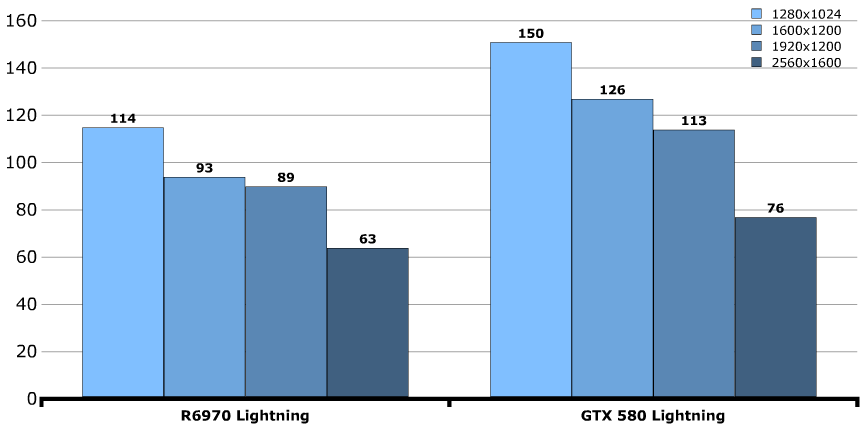

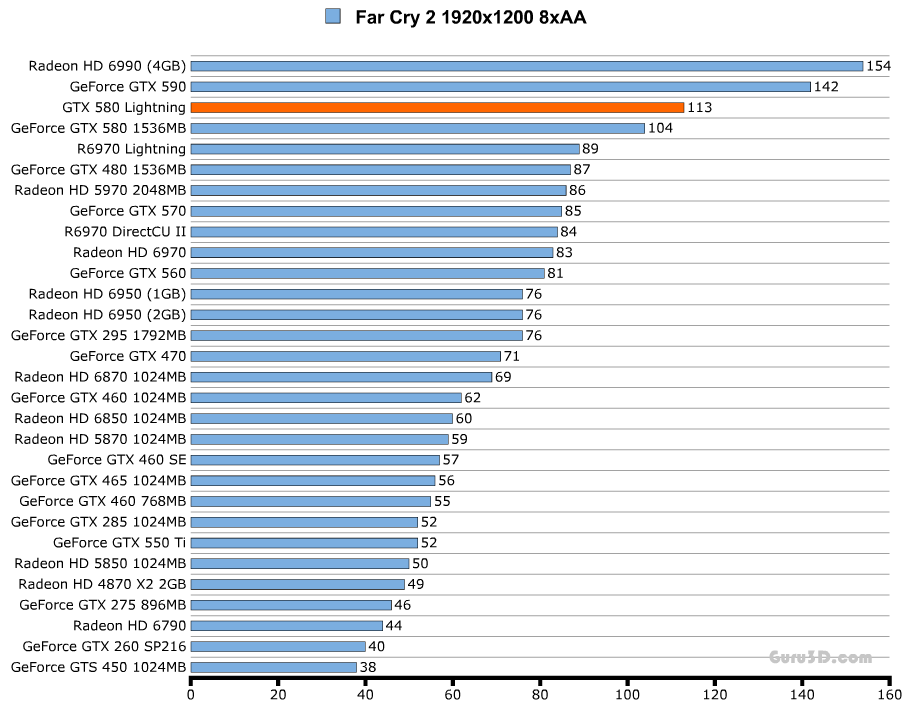

DX10: Far Cry 2

|

Тестирование проводилось на следующих настройках:

|

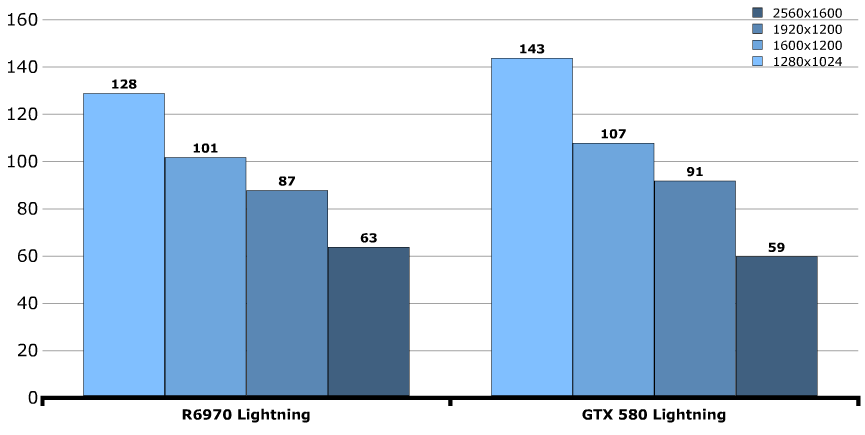

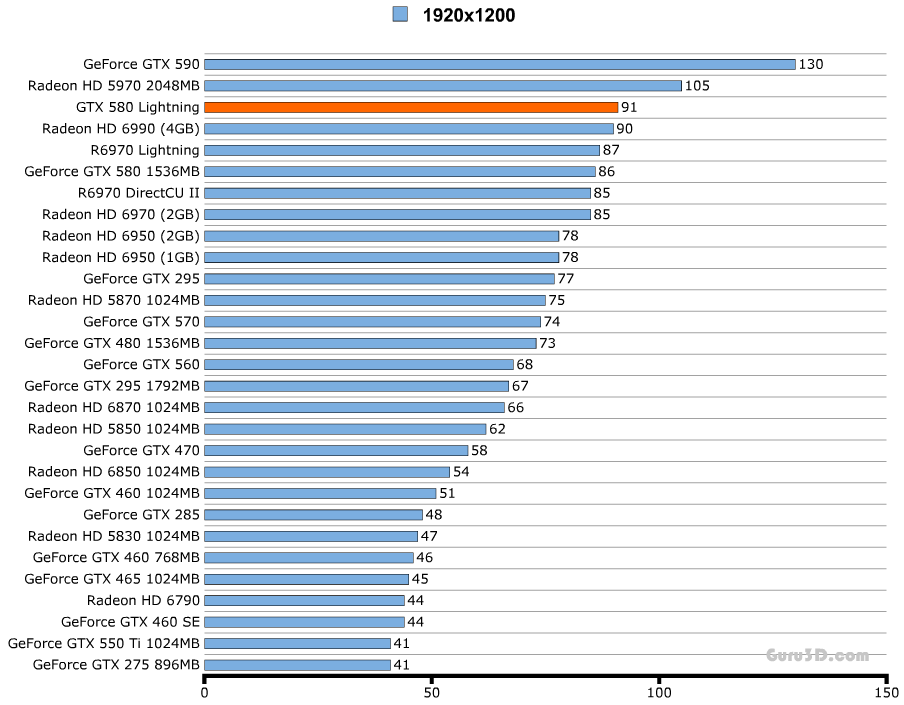

DX10: Anno 1404 - Dawn of Discovery

|

Тестирование проводилось на следующих настройках:

|

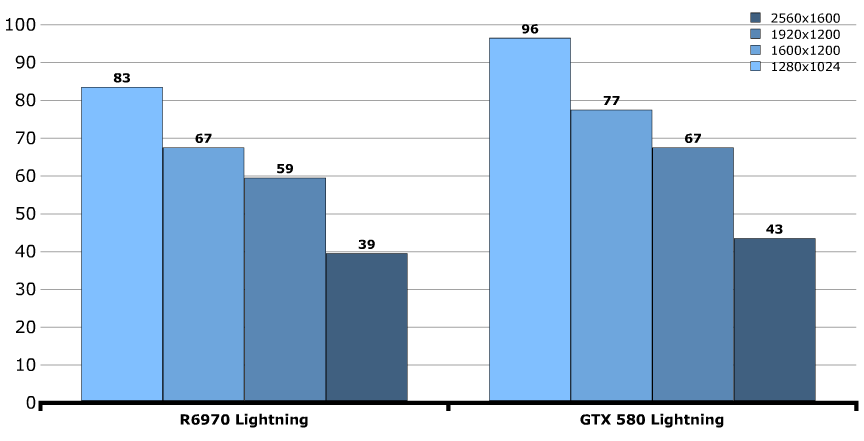

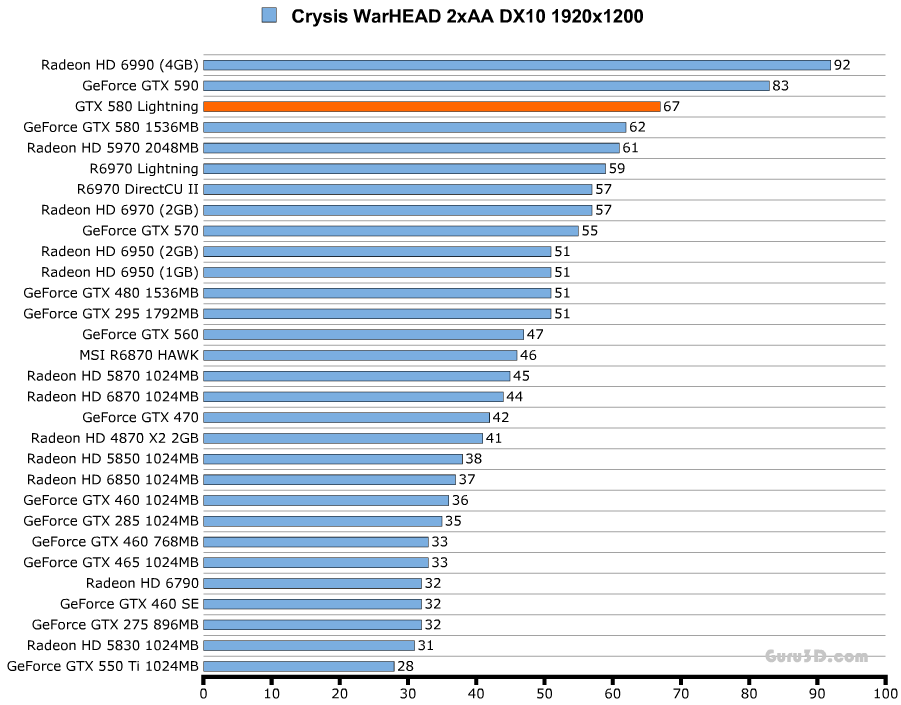

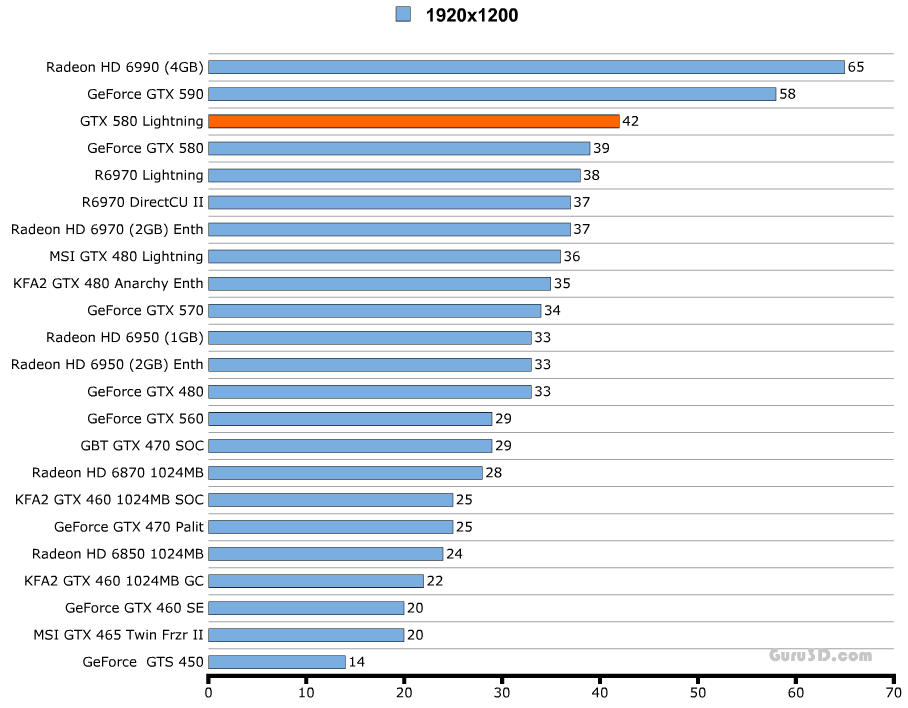

DX10: Crysis WARHEAD

|

Тестирование проводилось на следующих настройках:

|

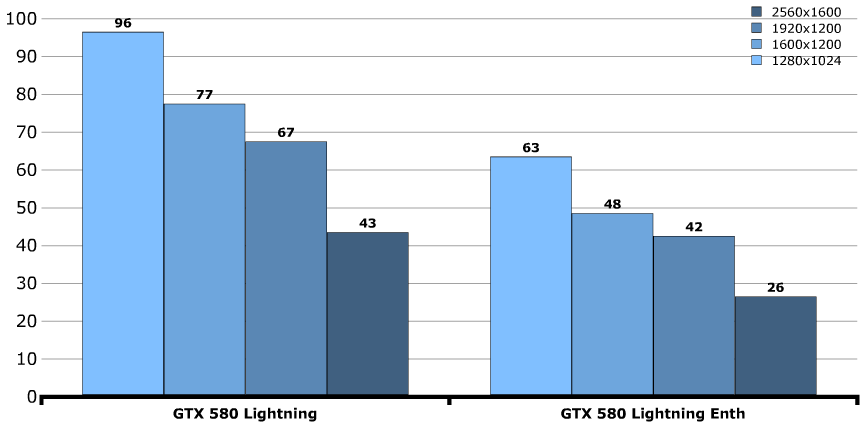

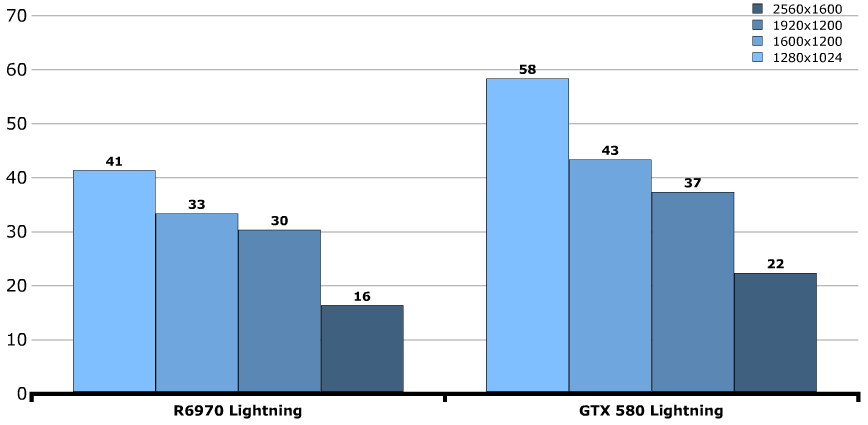

Вот график, демонстрирующий то, как ведёт себя новое творение MSI в режиме игры Enthusiast при тех же настройках графики, что и выше:

Итоговый график по "Крайзису". Жду-не дождусь, когда уже западные ревьюверы начнут включать Crysis 2 в свои тесты. Я понимаю, что игра вышла не так давно, но всё равно жду усиленно ![]()

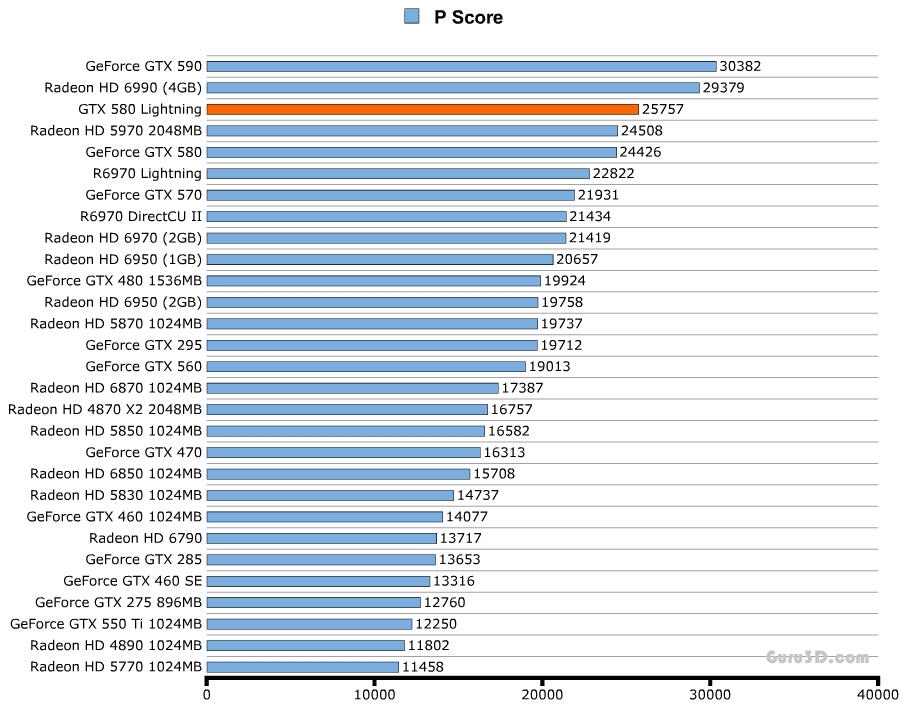

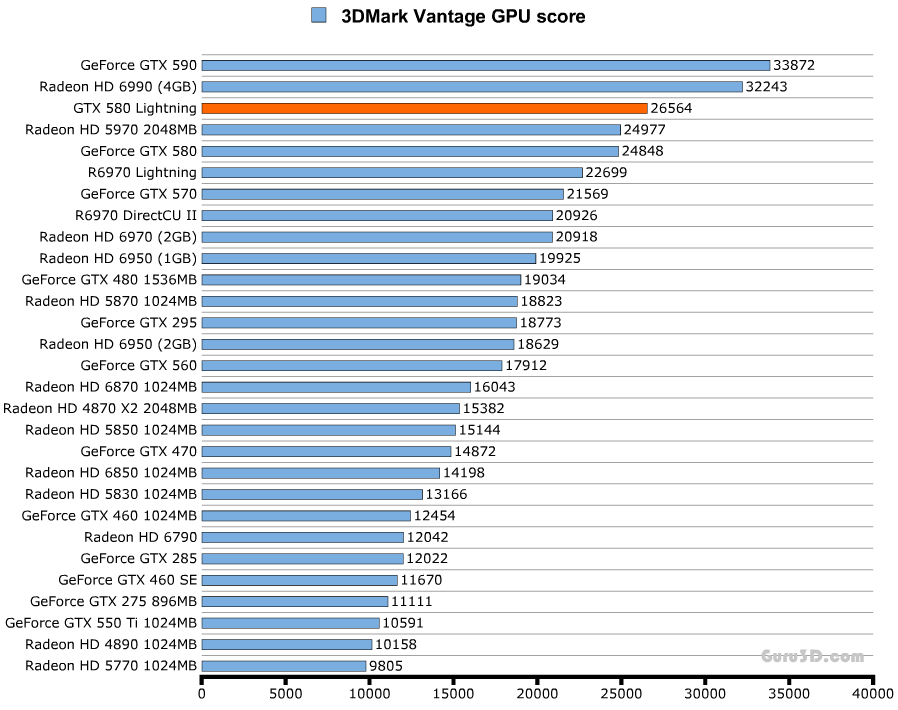

DX10: 3DMark Vantage

Как ясно из таблицы - тестирование в Вантаже происходило на пресете Performance.

Ранее, P-тестированием всё и ограничивалось, но теперь Гилберт проводит ещё и тест чисто по GPU, как наиболее правильный по его мнению:

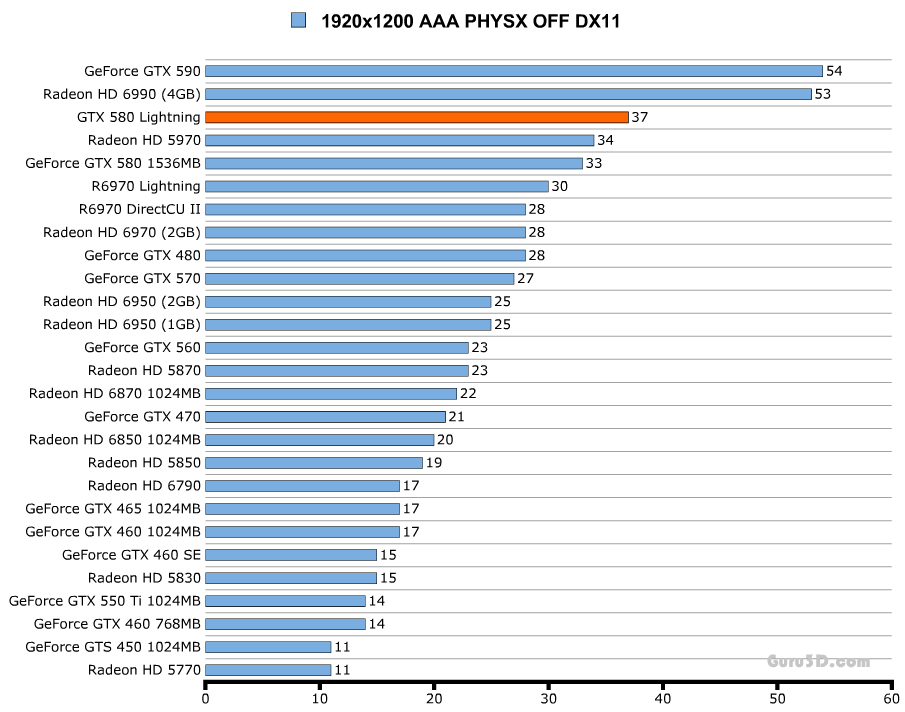

DX11: Metro 2033

|

Настройки в игре: вся графика на максимум, DX11, ААА включен, Physx выключен. |

DX11: Colin McRae Dirt 2

|

Тестирование проводилось на следующих настройках:

|

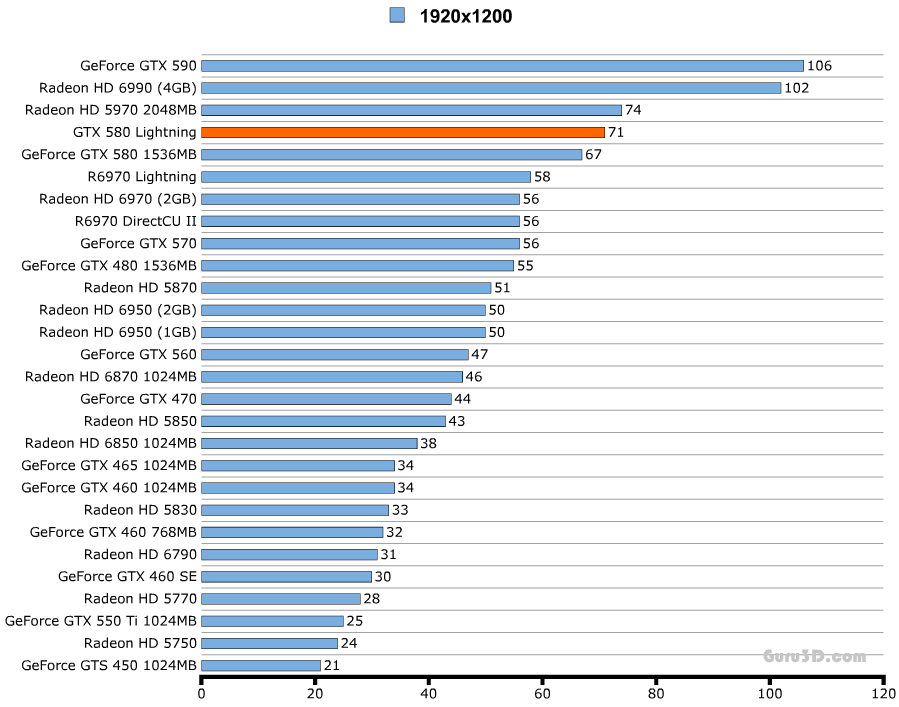

DX11: Battlefield Bad Company 2

|

Тестирование проводилось на следующих настройках:

|

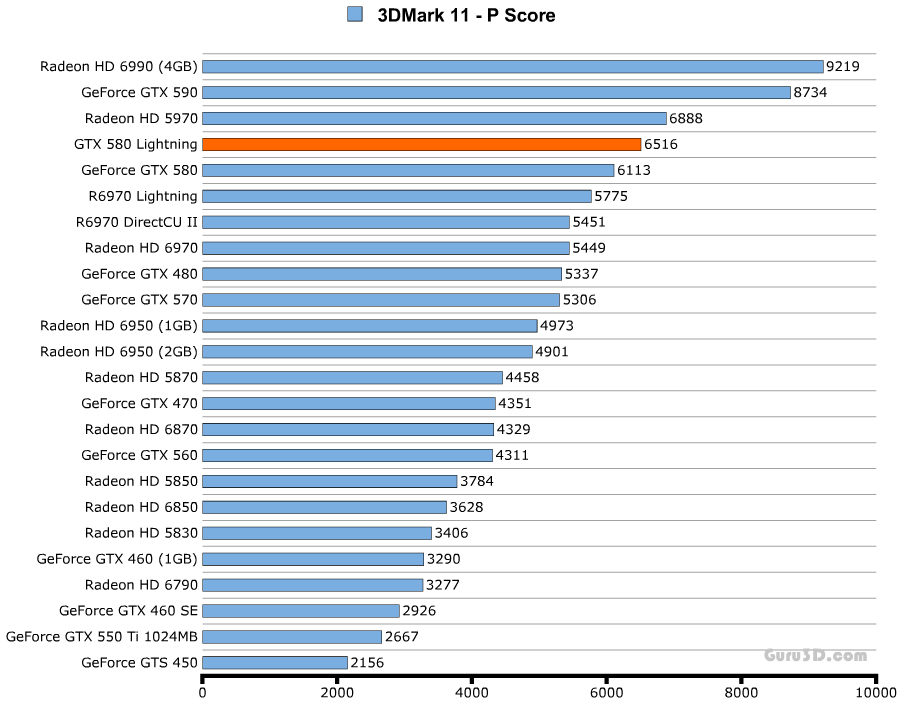

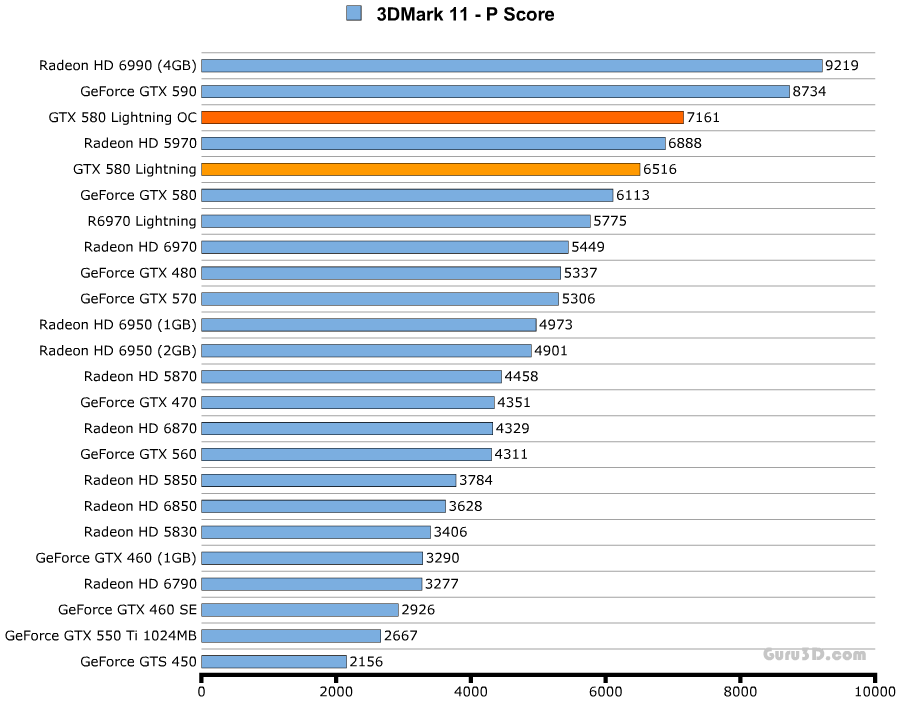

DX11: 3DMark 11

Да, это новый 3ДМарк, интересно будет посмотреть на то, как выступят в нём различные DX11 видеокарты.

Тест проходил на пресете Performance.

Результаты разгона видеокарты MSI GeForce GTX 580 Lightning

Как и в прошлый раз, сейчас мы узнаем, заслуживает ли карточка своего имени (Lightning означает "Молния"), разгон покажет что к чему ![]()

| Частоты референсной карты GeForce GTX 580 (в МГц) | Частоты MSI GeForce GTX 580 Lightning в номинале (в МГц) | Частоты MSI GeForce GTX 580 Lightning в разгоне (в МГц) |

| Ядро: 772 | 832 | 950 |

| Шейдеры: 1544 | 1664 | 1900 |

| Видеопамять: 4000 | 4200 | 4600 |

Весьма неплохой разгон для GTX 580. Как и всегда, оверклокинг осуществлялся утилитой MSI Afterburner. Автор материала не стал трогать логику управления вентиляторами, они крутились на дефолтных скоростях, однако позже (по мере работы карточки в разгоне) скорость вращения лопастей увеличилась и от того графический адаптер стал несколько шумноват (пусть и в разумных пределах). Говорится, что без поднятия напряжения на ядре, видяшка могла бы взять около 900МГц, а с поднятием "напруги" до 1.2V получился тот результат, что мы видим выше в табличке. Отмечается также, что энергопотребление в вышеуказанном разгоне возрастает на 50 ватт.

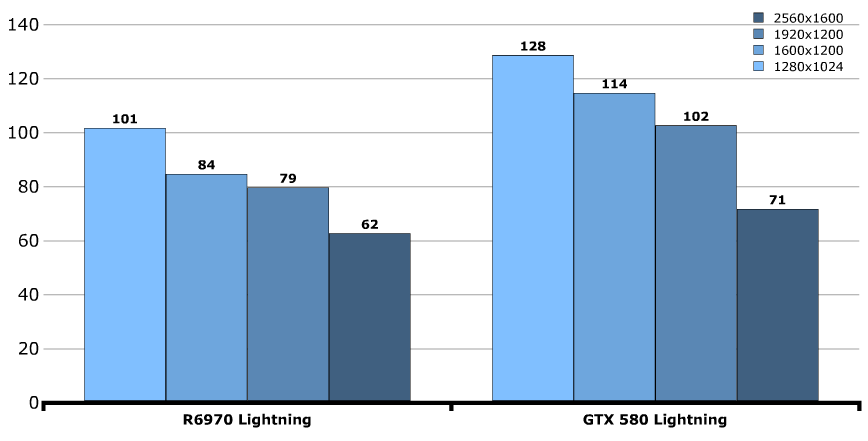

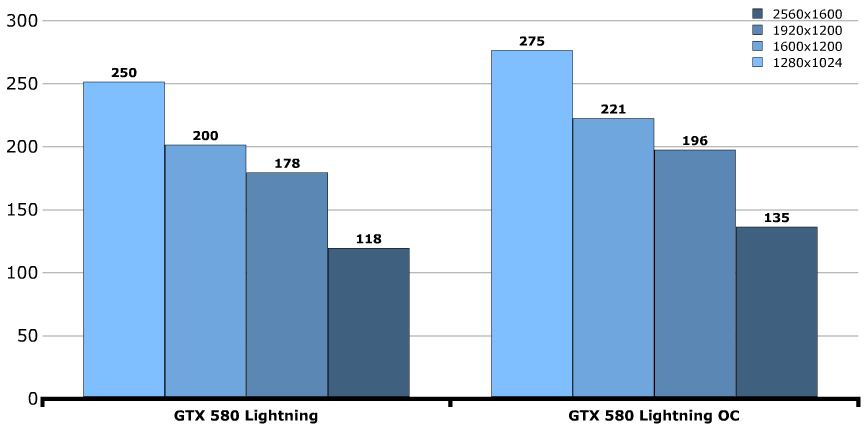

Ну а ниже, как и всегда в этой части материала, идут графики, демонстрирующие прирост производительности видеокарты от манипуляций с Afterburner. Сначала идёт игра Call of Duty: Modern Warfare 2 (4xAA, 16xAF):

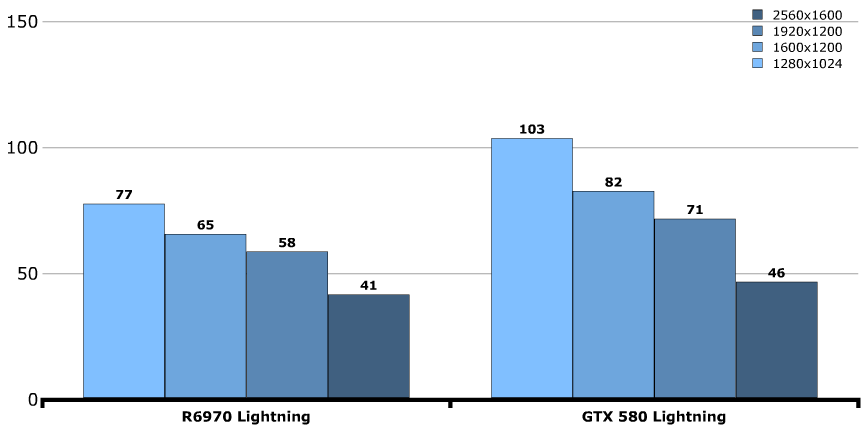

Теперь - Battlefield Bad Company 2 (8xAA, 16xAF):

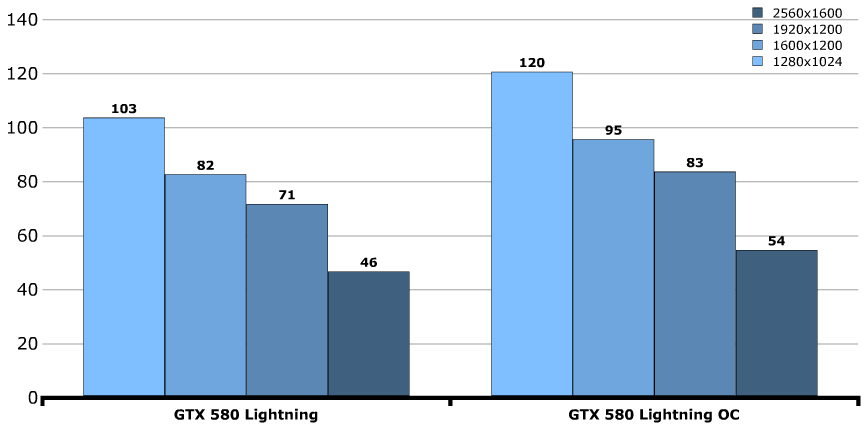

Ну и 3DMark 11, напоследок:

В играх разгон дал довольно неплохое преимущество над "стоковой" картой, а вот в "Марке".. ну на то он и Mark ![]()

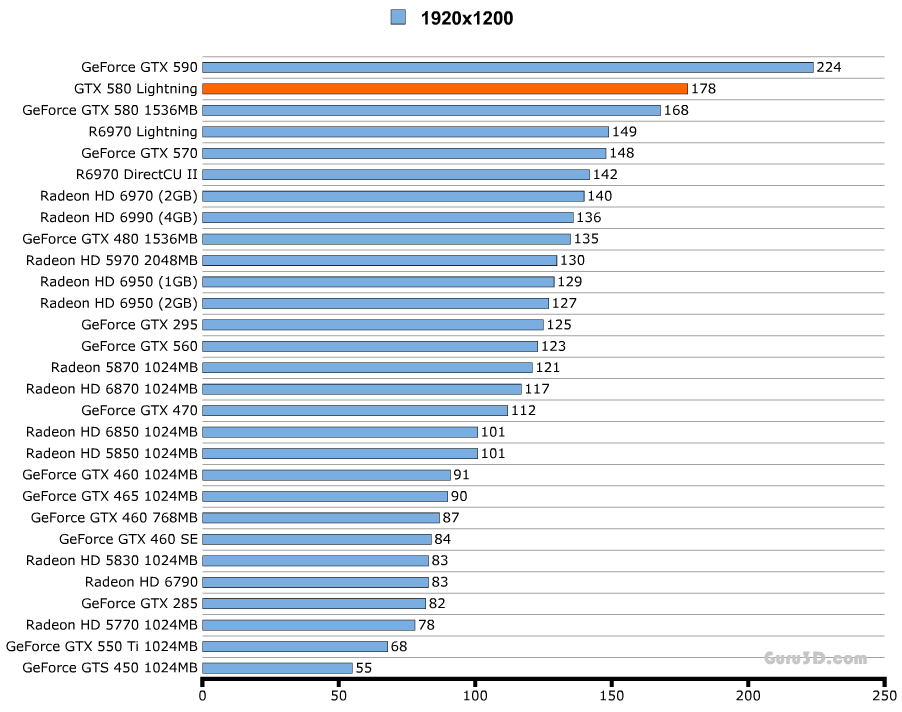

Выводы

Как и в прошлый раз, автор обзора хвалит видеоадаптер и я снова с ним согласен - у MSI получилась достойная карточка, от которой мало кто отказался бы. Гилберт пишет, что данная версия GTX 580 является самой шустрой из всех, что попадала к нему на тестирование, более того - это наиболее быстрая видеокарта с одним графическим ядром в мире.

Система охлаждения эффективная и тихая, хоть и не бесшумная - такой она и остаётся, если не разгонять видеокарту. Разгон, как таковой, тоже недурён (при удачном стечении обстоятельств и агрессивных настройках скорости вращения вентиляторов кулера вкупе с поднятием напряжения, не проблема взять и 1ГГц по ядру), плюс не стоит забывать, что есть и заводской. Пишется, что те самые компоненты "военного класса" позволяют гнать карточку с куда меньшим риском, чем референсный образец. В видеоадаптере прошито два BIOS, на случай если один из них станет недееспособным, так сказать ![]() Удобная штука для особенно безбашенных пользователей Nibitor'а.

Удобная штука для особенно безбашенных пользователей Nibitor'а.

Видяшка настолько понравилась автору материала, что получила награду, которую я раньше у Гуру3Д не видел ни разу:

p.s. Если кто ещё не видел всего разнообразия 580-х "Джифорсов", обязательно загляните на страничку постоянно обновляемой Армады.

Автор оригинальной статьи - Hilbert Hagedoorn, "перевод" - Slayer Moon, эксклюзивно для www.u-sm.ru

Статья является вольным переводом, даже скорее, пересказом обзора устройства с сайта Guru3D, она не нарушает ничьих прав, ибо все права принадлежат их авторам, а фотографии к статье - фотографам с указанного выше Интернет-ресурса

Если Вы заметите ошибки, помарки и прочее - дайте знать мне : ЛС, форум или комментарием к статье.

|

|

| < Да, ещё один обзор SSD Vertex 3 240ГБ | Обзор видеокарты MSI Radeon HD 6970 Lightning > |

|---|