Я уже писал на прошлой неделе, что в руки к журналистам с Guru3D попал интересный вариант GeForce GTX 680 от компании Gigabyte, тот самый, что оснащён кулером WindForce 3X. Предлагаю Вашему вниманию познакомиться с этим графическим адаптером, да узнать, на что же он способен.

Я уже писал на прошлой неделе, что в руки к журналистам с Guru3D попал интересный вариант GeForce GTX 680 от компании Gigabyte, тот самый, что оснащён кулером WindForce 3X. Предлагаю Вашему вниманию познакомиться с этим графическим адаптером, да узнать, на что же он способен.

Спецификации новой видеокарты от Nvidia, а также некоторых её родственниц изложены в табличке ниже:

| Gigabyte GeForce GTX 680 OC Edition | GTX 680 | GTX 580 | GTX 560 Ti | GTX 480 | |

| Потоковые процессоры | 1536 | 1536 | 512 | 384 | 480 |

| Текстурные блоки |

128 | 128 | 64 | 64 | 60 |

| ROPы | 32 | 32 | 48 | 32 | 48 |

| Частота ядра |

1072МГц | 1006МГц | 772МГц | 822МГц | 700МГц |

| Частота шейдеров |

Н/Д | Н/Д | 1544МГц | 1644МГц | 1401МГц |

| Частота Boost | 1123МГц | 1058МГц | Н/Д | Н/Д | N/A |

| Частота памяти |

6.008ГГц GDDR5 | 6.008ГГц GDDR5 | 4.008ГГц GDDR5 | 4.008ГГц GDDR5 | 3.696ГГц GDDR5 |

| Шина памяти |

256-бит | 256-бит | 384-бит | 256-бит | 384-бит |

| Объём памяти |

2ГБ | 2ГБ | 1.5ГБ | 1ГБ | 1.5ГБ |

| FP64 | 1/24 FP32 | 1/24 FP32 | 1/8 FP32 | 1/12 FP32 | 1/12 FP32 |

| TDP | 195 ватт | 195 ватт | 244 ватта | 170 ватт | 250 ватт |

| Количество транзисторов |

3.5 миллиарда | 3.5 миллиарда | 3 миллиарда | 1.95 миллиарда | 3 миллиарда |

| Тех.процесс изготовления |

TSMC 28нм | TSMC 28нм | TSMC 40нм | TSMC 40нм | TSMC 40нм |

| Стоимость, установленная при запуске решения |

~500 евро | $499 | $499 | $249 | $499 |

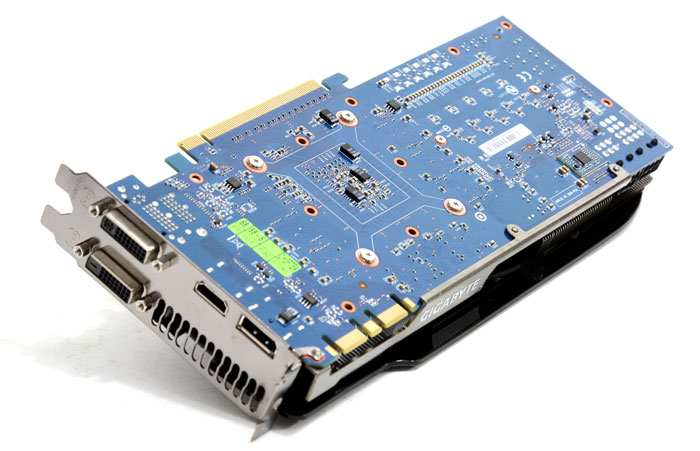

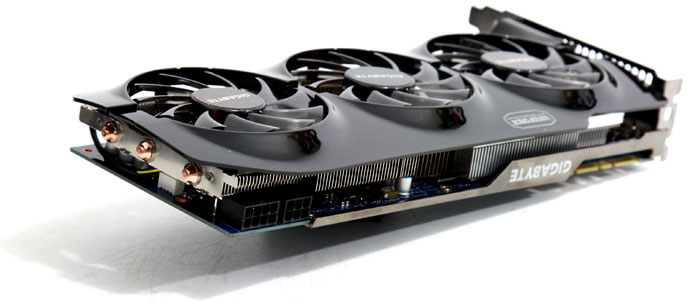

Теперь полюбуемся на видеокарту в галерее. Т.к. она ещё не поступила в продажу, на фото ниже мы не увидим её упаковки и комплекта поставки.

С виду новинка неотличима от большинства видеокарт, оснащённых кулером WindForce 3X.

Далее рассказывается то, что мы и так знаем - мол, карта оснащена 2ГБ памяти, чего вполне хватит для игры в разрешении Full HD (и ниже) на очень крутых настройках графики.

Говорится, что новинка от Gigabyte имеет 6-и фазовую (4+2) схему питания.

Длина изделия составляет 27 сантиметров, карта должна влезть в любой более-менее приличный Mid-Tower корпус.

GTX 680 от Gigabyte, ровно как и другие карточки на базе чипа GK104, поддерживает SLI (можно объединить вплоть до 4 видеокарт в высокопроизводительный тандем).

Система питания новинки изменена по сравнению с референсной. Вместо связки из 6+6-пиновых коннекторов, мы видим связку для 8+6 пиновых коннекторов БП.

Видеовыходы те же самые, что и у эталонной карточки: DisplayPort, HDMI, да пара DVI (DL).

Энергопотребление/температурный режим/уровень шума

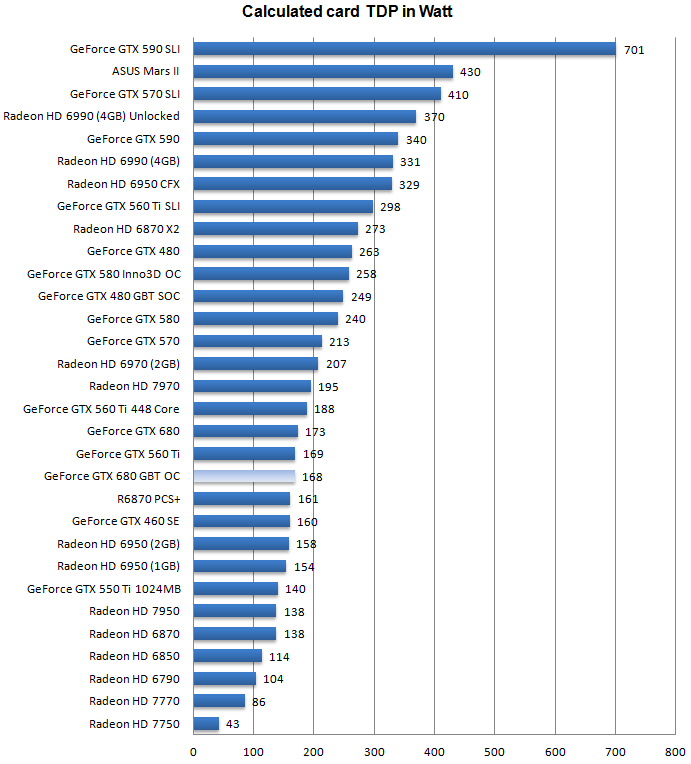

Энергопотребление видеокарты Gigabyte GeForce GTX 680 OC Edition

1. Система в режиме простоя потребляет = 142 ватта

2. Система с видеокартой в режиме полной нагрузки кушает = 300 ватт

3. Получившаяся разница = 159 ватт

4. Добавим среднее энергопотребление карты в режиме простоя ~ 10 ватт

5. И получаем энергопотребление в нагрузке = ~ 168 ватт

Поглядим, насколько хорошо / плохо выглядит Gigabyte GeForce GTX 680 OC Edition на фоне прочих карт в плане энергопотребления:

Удивительно, но новинка кушает меньше электроэнергии, чем референсная карточка GTX 680! Для продукта Gigabyte Гуру3Д рекомендуют обзавестись блоком питания мощностью не менее 550 ватт для одной карточки и 750 ватт - для двух в SLI.

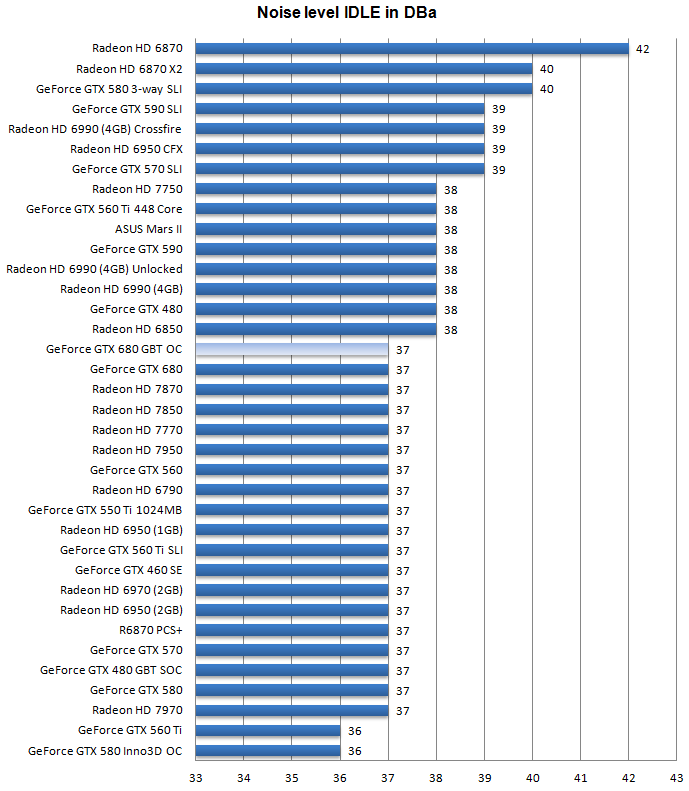

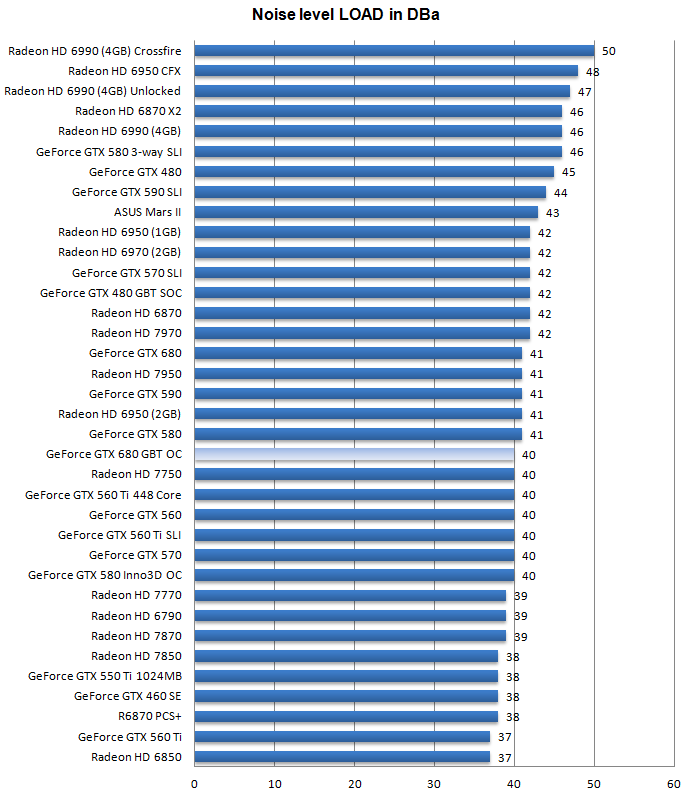

Уровень шума, издаваемый системой охлаждения видеокарты Gigabyte GeForce GTX 680 OC Edition

Посмотрим, окажется ли WindForce 3X лучше эталонной системы охлаждения по шуму или же нет:

В простое всё хорошо, а лучше сказать - вполне типично.

В нагрузке WF 3X работает на 1 децибел тише, чем референс GTX 680.

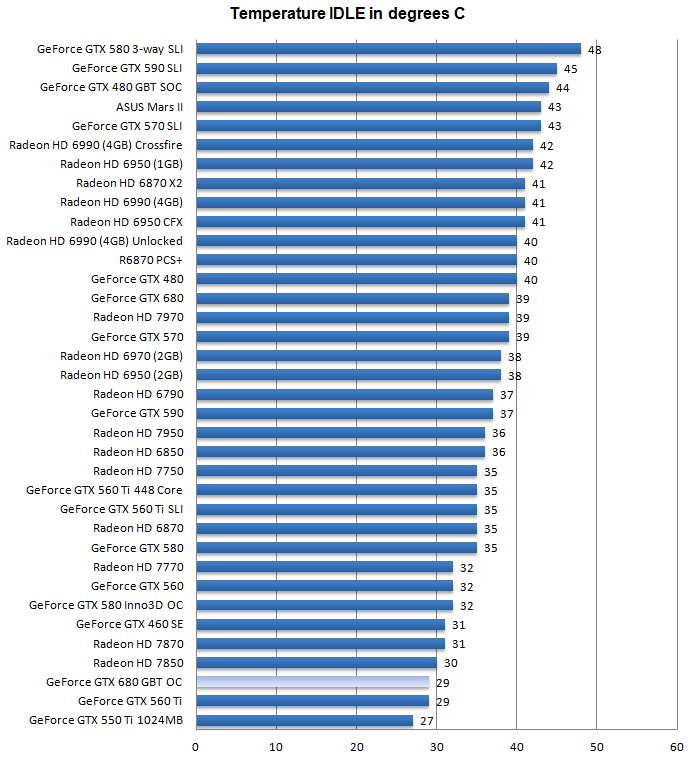

Температурный режим

Давайте поглядим на то, как греются различные видеокарты, в том числе и новинка от Gigabyte, в простое:

Впечатляющий результат, камрады - столь низкие температуры в простое дают неплохую надежду, что и в нагрузке ситуация будет не хуже.

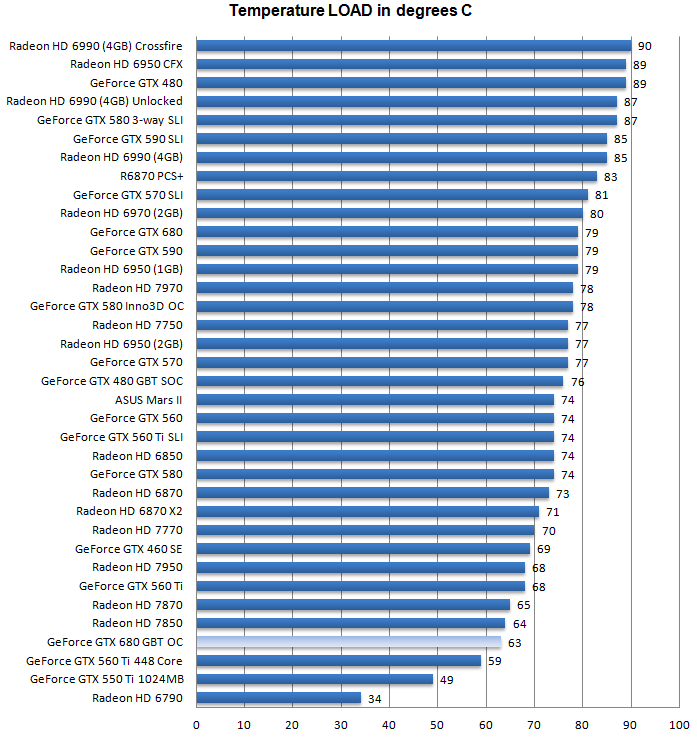

Вот это я понимаю - нереференсный кулер от Gigabyte показал, что к чему. Имея столь немалый запас по безопасным температурам, можно сбавить обороты кулера WindForce 3X и сделать карточку сильно тише референса. Я бы, по крайней мере, так и поступил бы.

Конфигурация тестового стенда и используемые игры

Материнская плата - MSI Big Bang XPower X58

Процессор - Core i7 965 @ 3750 МГц

Видеокарта - Gigabyte GeForce GTX 680 OC Edition

Оперативная память - Corsair 6144МБ (3x 2048МБ) DDR3 1500 МГц

Блок питания - 1200 ватт

Монитор - Dell 3007WFP - разрешение до 2560x1600

Операционная система - Windows 7 х64 SP1

DirectX 9/10/11 End User Runtime (самые последние версии)

AMD Catalyst (12.1/12.2)

Игры и синтетические тесты:

- Metro 2033

- Battlefield Bad Company 2

- Battlefield 3

- Far Cry 2

- Call of Duty - Modern Warfare 2

- Crysis 2 DX11 + HQ Texture pack

- Hard Reset

- Aliens vs Predator

- Lost Planet 2

- Anno 1404

- Anno 2070

- 3DMark Vantage

- 3DMark 11

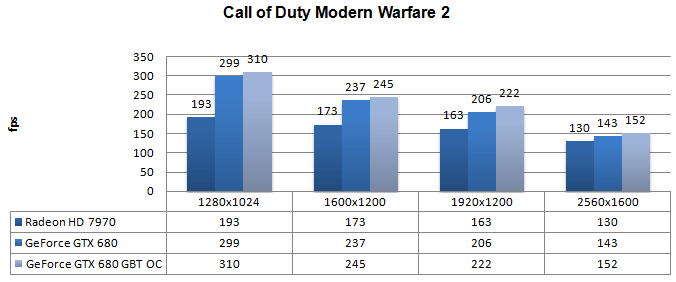

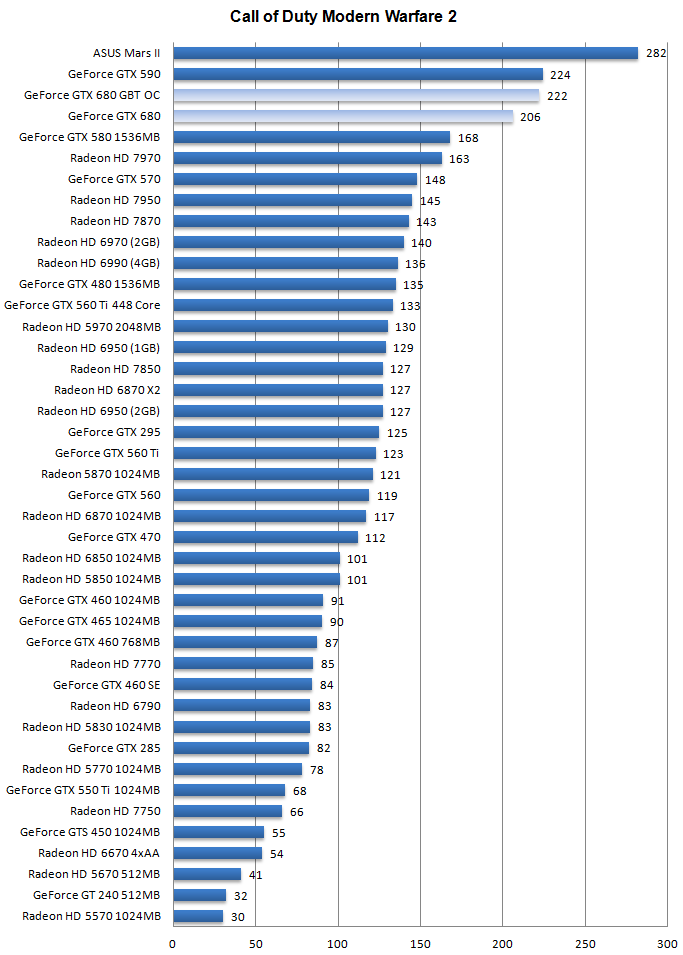

DX9: Call of Duty: Modern Warfare 2

Тестирование проводилось на следующих настройках:

- Уровень - Contingency

- 4x Антиалиасинг

- 16x Анизотропная фильтрация

- Все настройки на максимум

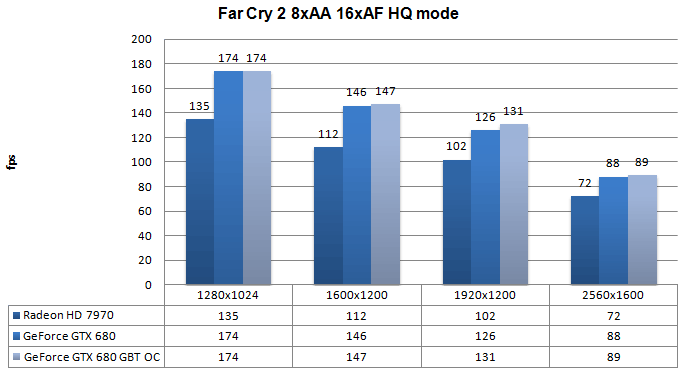

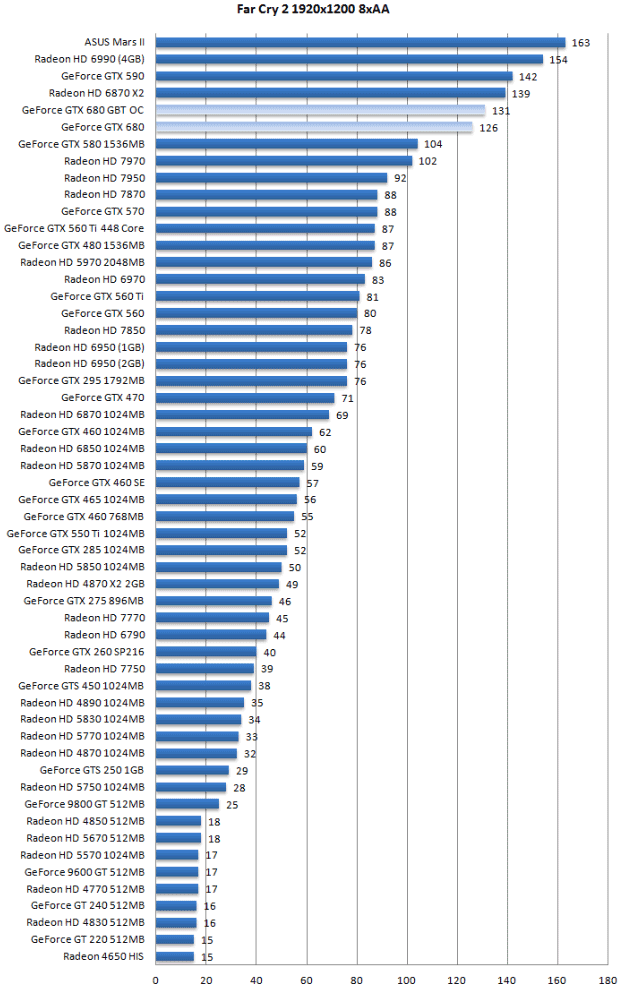

DX10: Far Cry 2

|

Тестирование проводилось на следующих настройках:

|

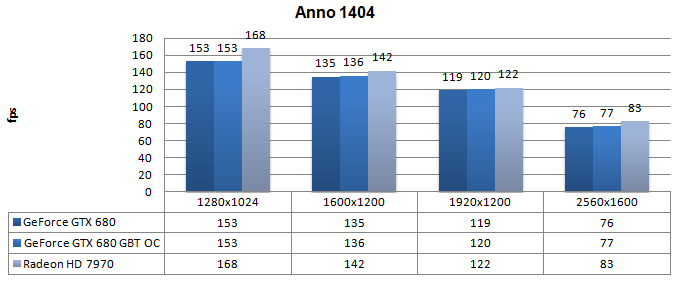

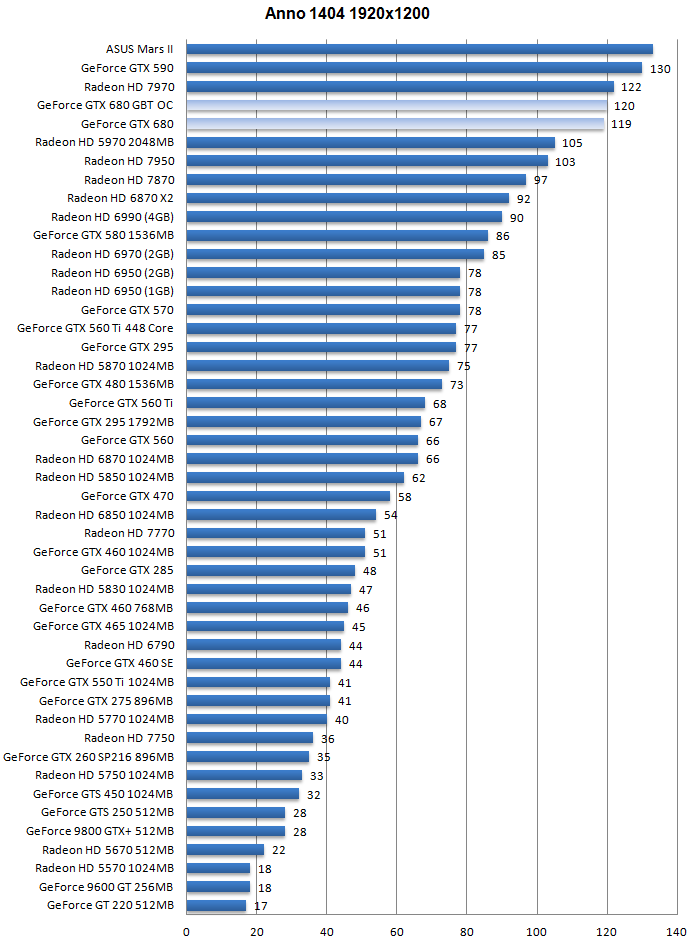

DX10: Anno 1404 - Dawn of Discovery

|

Тестирование проводилось на следующих настройках:

|

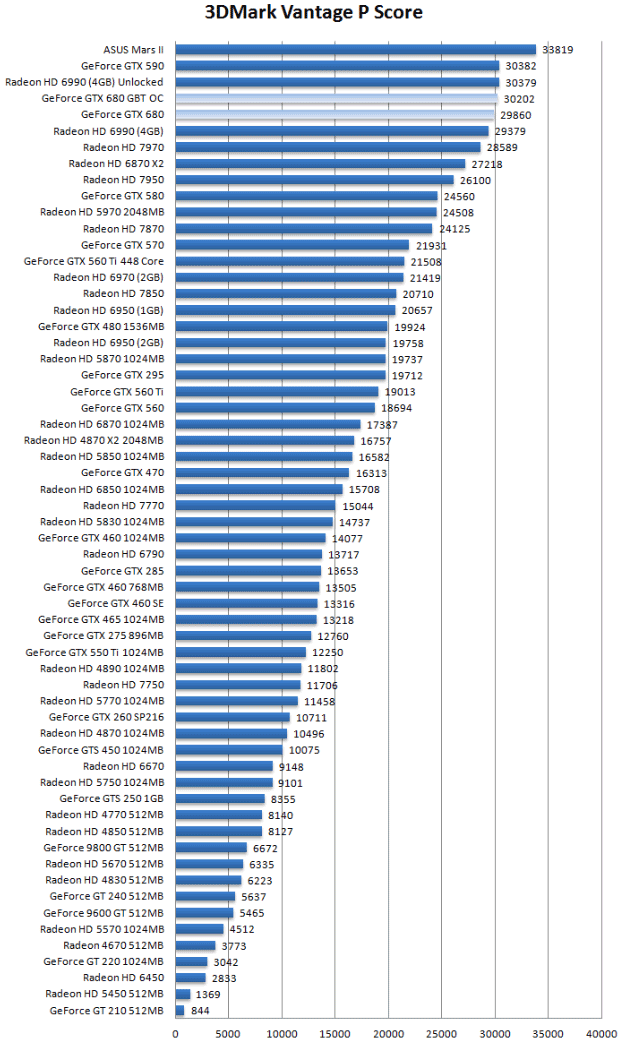

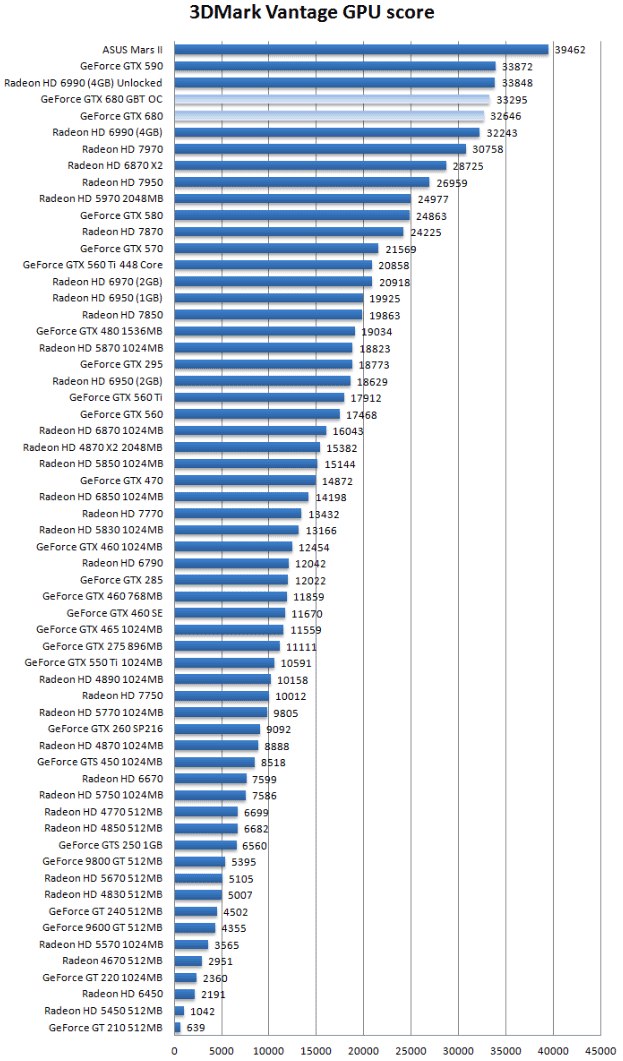

DX10: 3DMark Vantage

Как ясно из таблицы - тестирование в Вантаже происходило на пресете Performance.

Ранее, P-тестированием всё и ограничивалось, но теперь (уже в течении довольно-таки длительного периода времени) Гилберт проводит ещё и тест чисто по GPU, как наиболее правильный по его мнению:

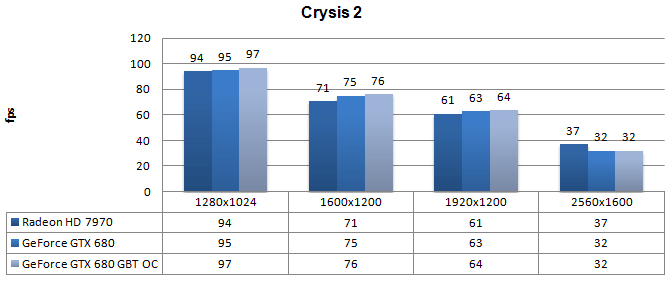

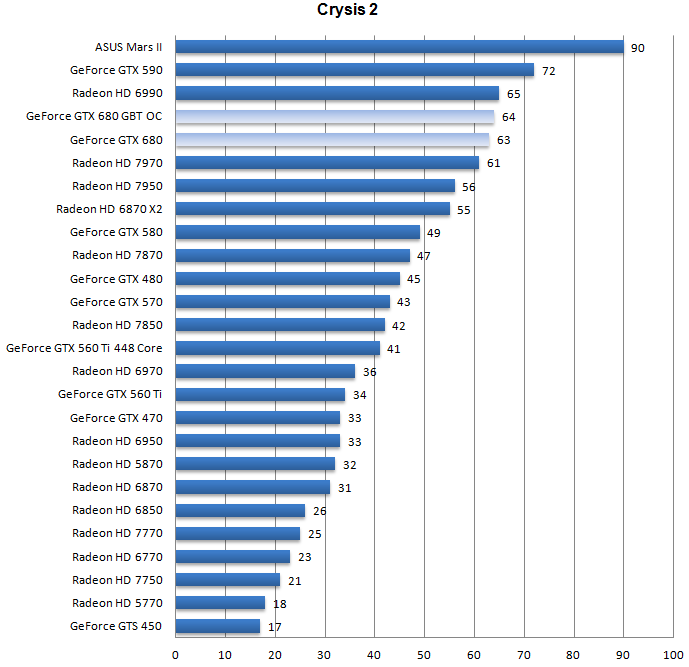

DX11: Crysis 2 + текстуры высокого разрешения

Игра тестировалась с установленным DX11 патчем и набором текстур высокого разрешения. Про пользу от инсталляции этих полезных вещей Вы можете почитать вот тут.

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

Вот какое гонялось Time Demo:

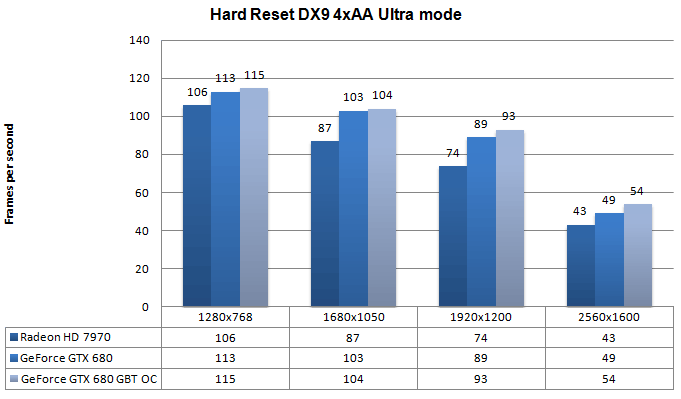

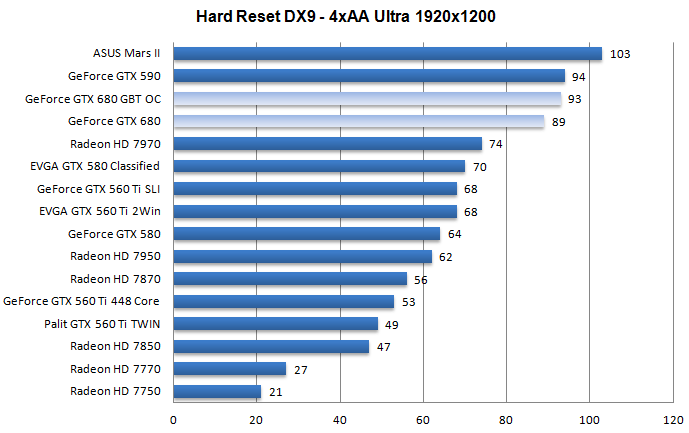

DX9: Hard Reset

|

Тестирование проводилось на следующих настройках:

|

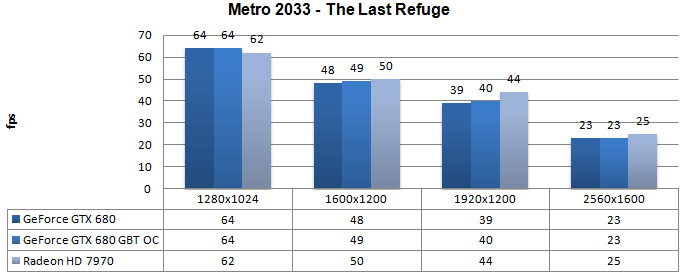

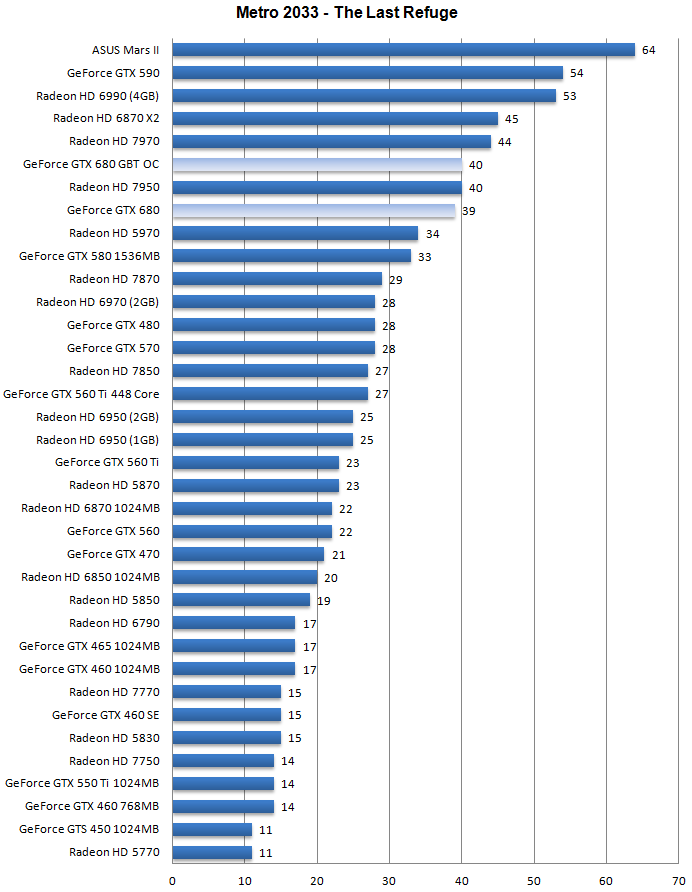

DX11: Metro 2033

|

Настройки в игре: вся графика на максимум, DX11, ААА включен, Physx выключен. |

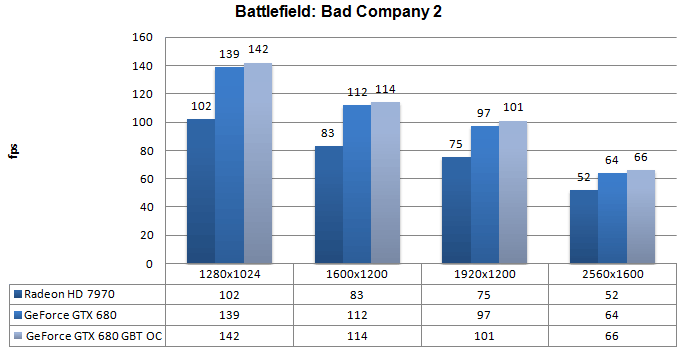

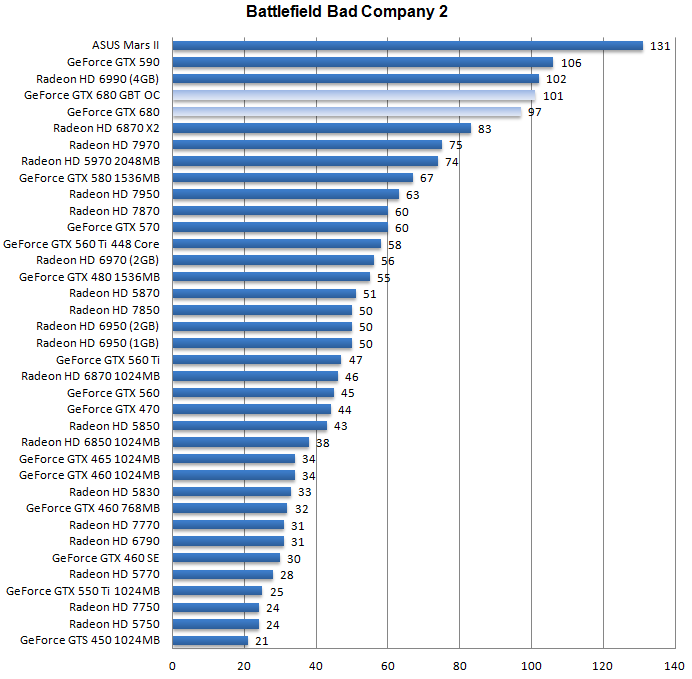

DX11: Battlefield Bad Company 2

|

Тестирование проводилось на следующих настройках:

|

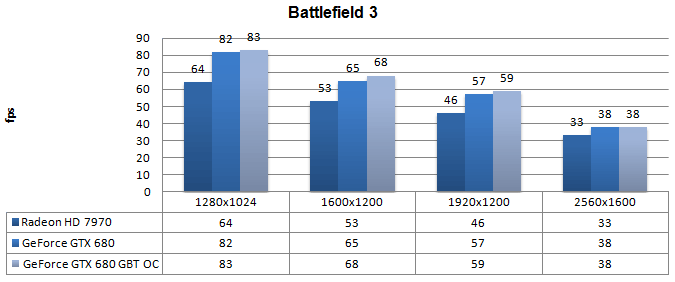

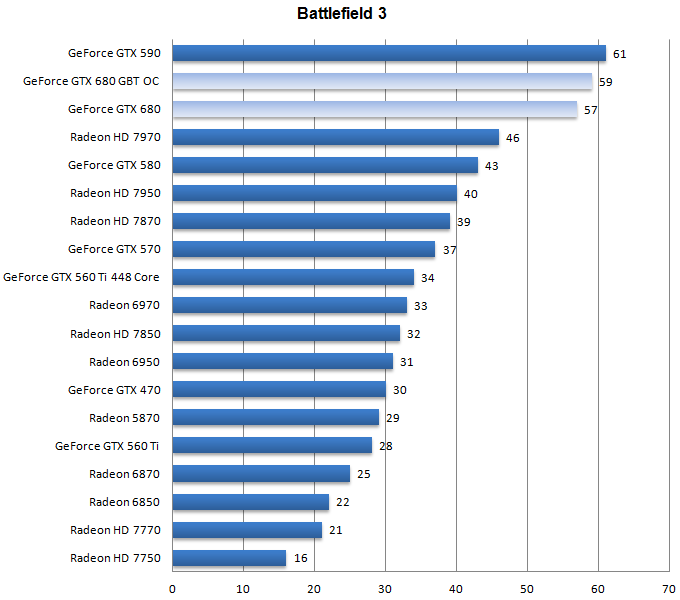

DX11: Battlefield 3

|

Тестирование проводилось на следующих настройках:

|

Используемое TimeDemo:

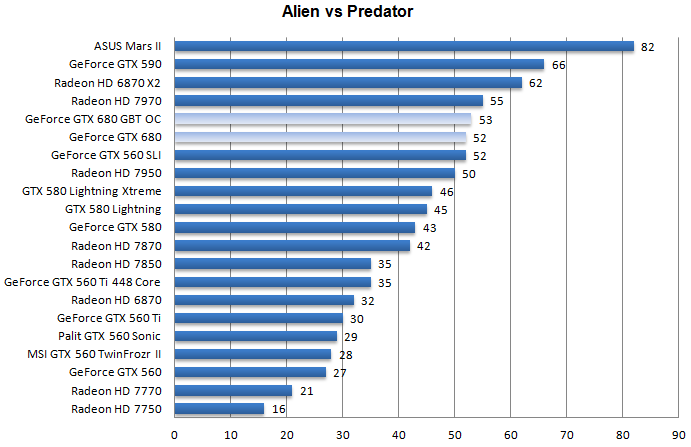

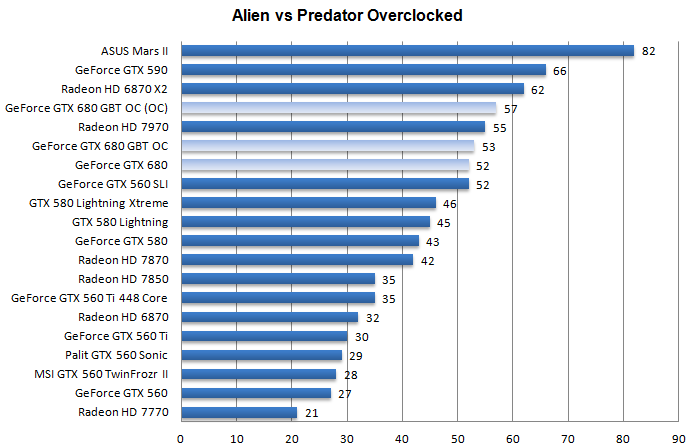

DX11: Aliens Versus Predator

|

Тестирование проводилось на следующих настройках:

|

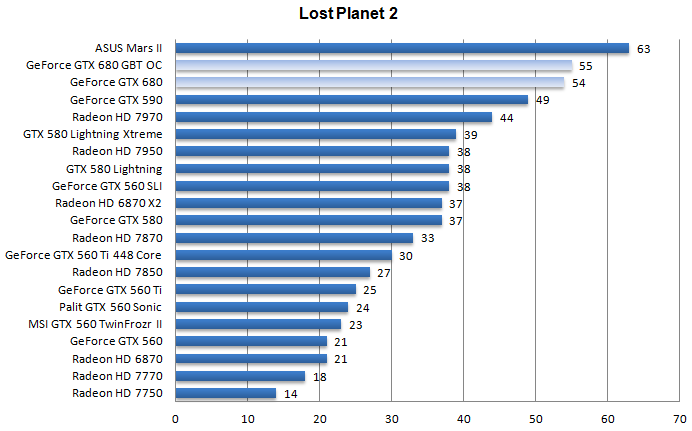

DX11: Lost Planet 2

|

Тестирование проводилось на следующих настройках:

|

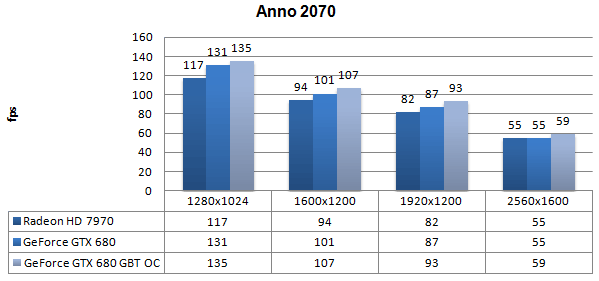

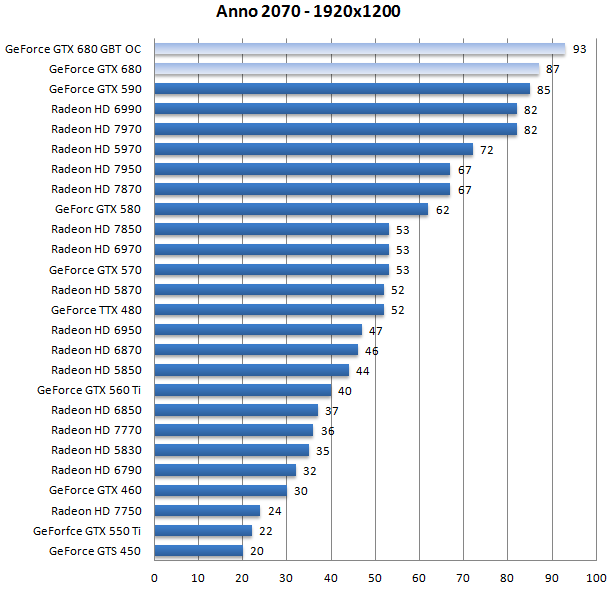

DX11: Anno 2070

|

Тестирование проводилось на следующих настройках:

|

Сводный график производительности различных решений в игре:

А вот видео из этой игры, записанное Guru3D:

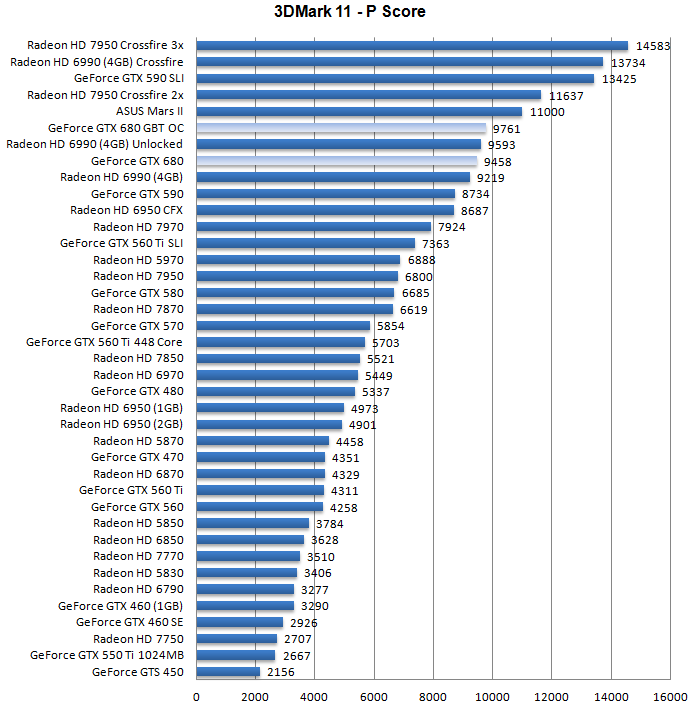

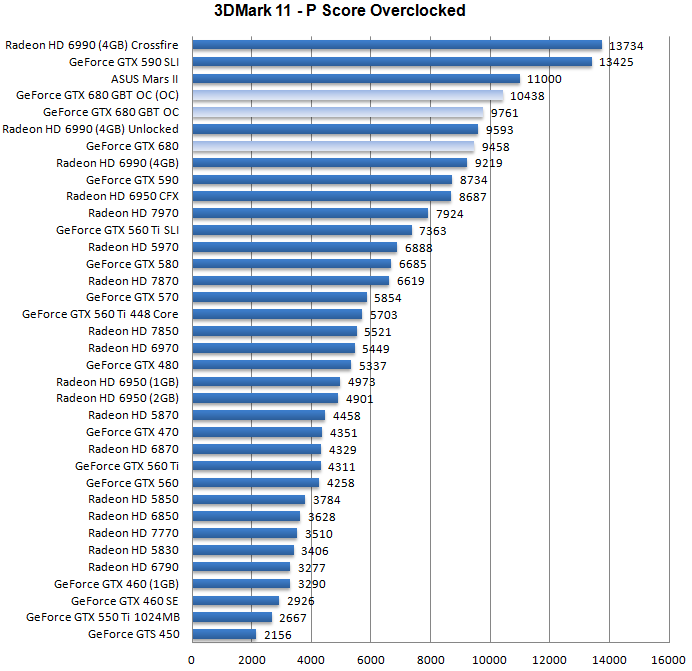

DX11: 3DMark 11

Последний из доступных 3ДМарк'ов, всегда интересно посмотреть на то, как выступят в нём различные DX11 видеокарты.

Тест проходил на пресете Performance.

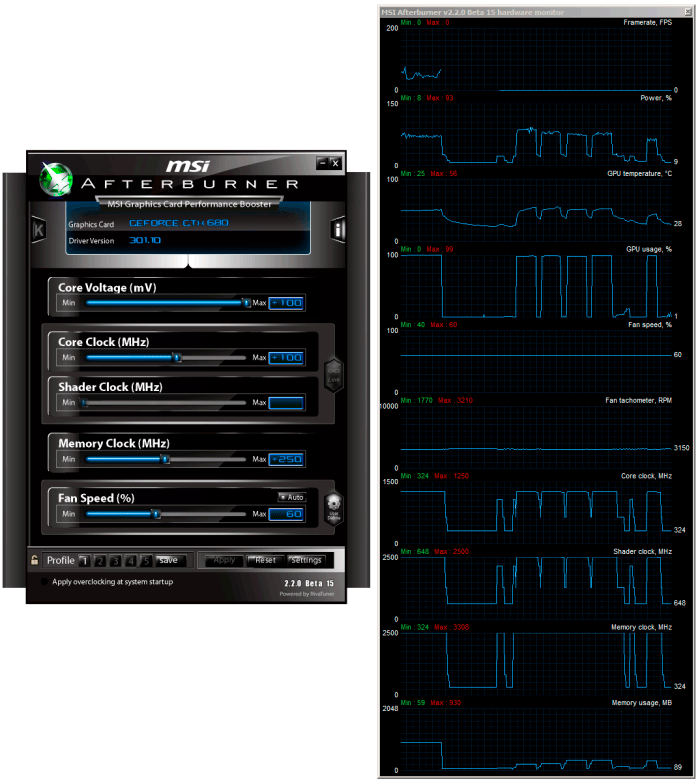

Результаты разгона видеокарты Gigabyte GeForce GTX 680 OC Edition

Интересно, сможет ли, благодаря изменённой подсистеме питания, продукт Gigabyte выступить лучше эталонного GTX 680 в разгоне (его результат был равен 1264\6634МГц) или нет?

| Частоты референсной карты GeForce GTX 680 (в МГц) | Частоты Gigabyte GeForce GTX 680 OC Edition в номинале (в МГц) | Частоты Gigabyte GeForce GTX 680 OC Edition в разгоне (в МГц) |

| Ядро: 1006 | 1071 | 1171 |

| Boost: 1058 | 1123 | 1250 |

| Видеопамять: 6000 | 6000 | 6612 |

Разгоняли видеокарту с помощью утилиты MSI Afterburner, автор оригинального материала советует последнюю (Beta 15) версию:

С небольшим (100мВ) поднятием напряжения на ядре, карточка смогла стабильно функционировать на частоте, указанной в табличке выше. Память также удалось погнать - на 250МГц. Кулер для разгона пришлось зафиксировать на 60% скорости, так что шумел он значительно громче, чем при тестировании в номинальном режиме работы видеокарты.

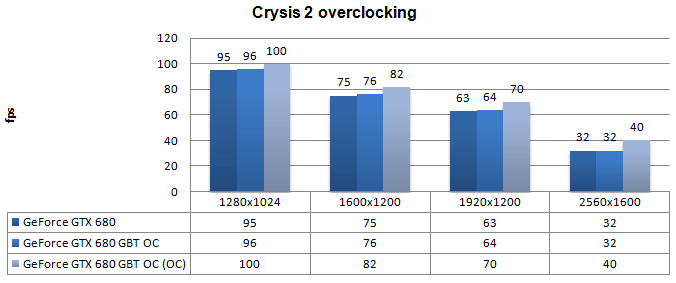

Разумеется, раз карточку погнали, то неплохо бы посмотреть на то, как она в таком состоянии выступит. Традиционно, тест проводится в следующих приложениях: Crysis 2, 3DMark 11 и Aliens vs Predator. Смотрим результаты:

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

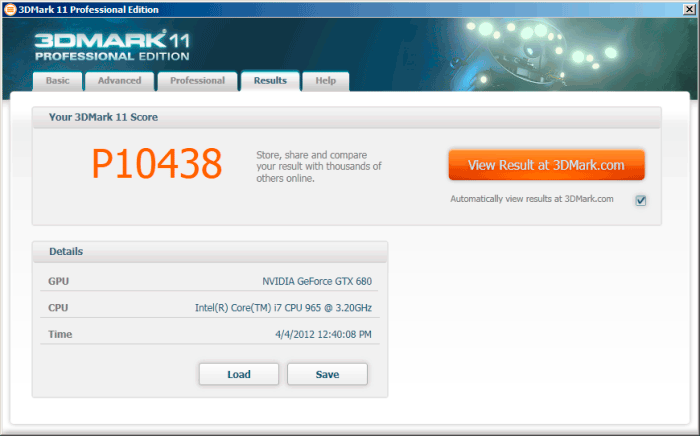

А вот результат в 3DMark 11:

Aliens vs Predator замыкает список тестов:

Тестирование проводилось на следующих настройках:

- DirectX 11 (Full)

- 4x Антиалиасинг

- 16х Анизотропная фильтрация

- SSAO включено

- Все настройки на максимум

Выводы

Выводы в оригинальном материале начинаются ровно таким же образом, как в прошлом обзоре/тесте GeForce GTX 680, потому я их пропускаю, дабы не повторяться.

Как и должно быть у карты с нереференсной системой охлаждения (но как, увы, бывает далеко не всегда), ситуация в тесте с уровнем шума и температурами у продукта Gigabyte обстоит лучше, чем у продукта Nvidia в первозданном его виде. Сравните температуру в простое и в нагрузке у референса (40 и 80 градусов по Цельсию) и у GeForce GTX 680 OC Edition с кулером WindForce 3X (30 и 65°) и вопросов далее просто не возникнет. В плане шума новинка не сильно тише референса, всего на 1 децибел.

У продукта тайваньского вендора имеется и заводской разгон, хоть и скромный. Подсистема питания переработана, но толку от этого в плане разгона нет, карточка достигла 1250МГц по ядру, ревьювер надеялся, что она сможет показать больше. Зато энергопотребление ниже, чем у референсной GTX 680 (даже с учётом того самого заводского разгона).

В общем и целом, сайт Guru3D рекомендует видеокарту Gigabyte GeForce GTX 680 OC Edition к приобретению (если её можно будет хоть где-то приобрести в ближайшее время, ибо пока что с GTX 680 дефицит по всему миру), награждая классическим штампом:

p.s. Обязательно посмотрите "Армаду" по GTX 680, она постоянно пополняется новыми видеокартами этого семейства.

Автор оригинальной статьи - Hilbert Hagedoorn, "перевод" - Slayer Moon, эксклюзивно для www.u-sm.ru

Статья является вольным переводом, даже скорее, пересказом обзора устройства с сайта Guru3D, она не нарушает ничьих прав, ибо все права принадлежат их авторам, а фотографии к статье - фотографам с указанного выше Интернет-ресурса

Если Вы заметите ошибки, помарки и прочее - дайте мне знать: Ctrl+Enter (Орфус).

|

|

| < Тестирование пары GeForce GTX 680 в SLI в режиме Surround на три монитора (5760х1080) | Обзор и тестирование видеокарты HIS Radeon HD 7870 IceQ Turbo > |

|---|