На днях мы увидели, как ведёт себя видеокарта GeForce GTX 680 в одиночном режиме и в SLI, теперь ознакомимся с результатами тестов, в которых приняла участие эта разогнанная несколько больше обычного видяшка на базе GK104, оригинальный материал располагается на сайте Guru3D.

На днях мы увидели, как ведёт себя видеокарта GeForce GTX 680 в одиночном режиме и в SLI, теперь ознакомимся с результатами тестов, в которых приняла участие эта разогнанная несколько больше обычного видяшка на базе GK104, оригинальный материал располагается на сайте Guru3D.

Спецификации новой видеокарты от Nvidia, а также некоторых её родственниц изложены в табличке ниже:

| GTX 680 | GTX 580 | GTX 560 Ti | GTX 480 | |

| Потоковые процессоры | 1536 | 512 | 384 | 480 |

| Текстурные блоки |

128 | 64 | 64 | 60 |

| ROPы | 32 | 48 | 32 | 48 |

| Частота ядра |

1006МГц | 772МГц | 822МГц | 700МГц |

| Частота шейдеров |

Н/Д | 1544МГц | 1644МГц | 1401МГц |

| Частота Boost | 1058МГц | Н/Д | Н/Д | N/A |

| Частота памяти |

6.008ГГц GDDR5 | 4.008ГГц GDDR5 | 4.008ГГц GDDR5 | 3.696ГГц GDDR5 |

| Шина памяти |

256-бит | 384-бит | 256-бит | 384-бит |

| Объём памяти |

2ГБ | 1.5ГБ | 1ГБ | 1.5ГБ |

| FP64 | 1/24 FP32 | 1/8 FP32 | 1/12 FP32 | 1/12 FP32 |

| TDP | 195 ватт | 244 ватта | 170 ватт | 250 ватт |

| Количество транзисторов |

3.5 миллиарда | 3 миллиарда | 1.95 миллиарда | 3 миллиарда |

| Тех.процесс изготовления |

TSMC 28нм | TSMC 40нм | TSMC 40нм | TSMC 40нм |

| Стоимость, установленная при запуске решения |

$499 | $499 | $249 | $499 |

Прежде чем приступить к просмотру результатов тестов разогнанной GTX 680, нам предлагают посмотреть, до каких, собственно, частот карточка погналась вообще:

| Частоты референсной карты GeForce GTX 680 (в МГц) | Частоты GeForce GTX 680 в номинале (в МГц) | Частоты GeForce GTX 680 в разгоне (в МГц) |

| Ядро: 1006 | 1006 | ~1300 |

| Видеопамять: 6000 | 6000 | 7128 |

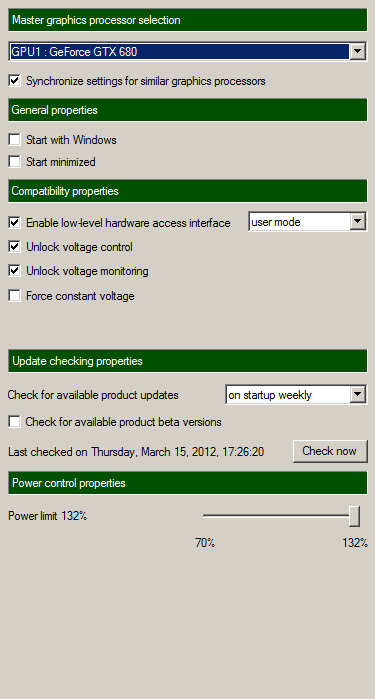

Вновь, как и в прошлый раз, частоты карты поднимали с помощью утилиты MSI Afterburner:

В опциях Afterburner нужно повысить TDP карточки, как показано на скриншоте выше - до 132%. Это не позволит функции Dynamic Boost понижать частоты каждый раз, когда карточка будет превышать лимит по TDP.

Снова нам сообщают, что возможности изменения напряжения на графическом ядре видеокарты во время написания материала не было (хотя утилита EVGA Precision X позволяла поднимать "напругу" до 1.15 вольт, но особой роли это не сыграло), потому разгон в табличке выше получен без игр с "вольтажом".

Как можно увидеть на скриншоте выше, ядро работало на частоте в 1300МГц +/- 25МГц, а память - на 7128МГц, при этом карточка функционировала абсолютно стабильно.

Энергопотребление/температурный режим/уровень шума

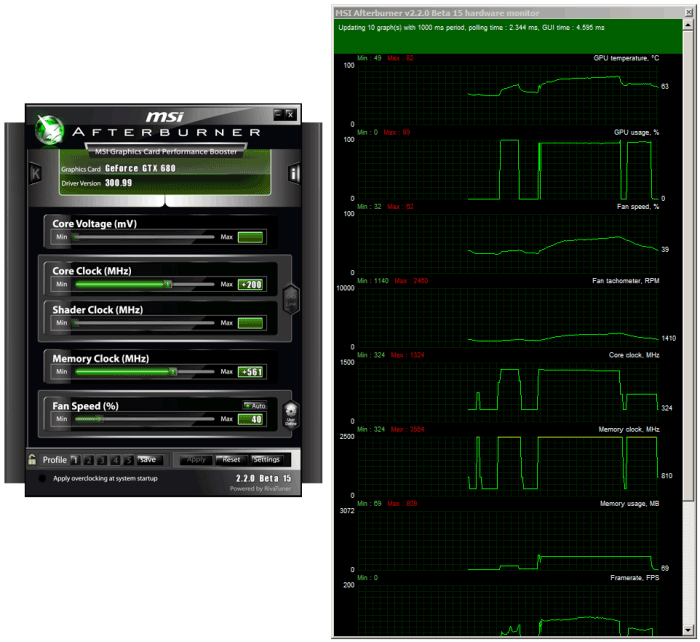

Энергопотребление видеокарты GeForce GTX 680 без разгона

1. Система в режиме простоя потребляет = 144 ватта

2. Система с видеокартой в режиме полной нагрузки кушает = 307 ватт

3. Получившаяся разница = 163 ватта

4. Добавим среднее энергопотребление карты в режиме простоя ~ 10 ватт

5. И получаем энергопотребление в нагрузке = ~ 173 ватта

Энергопотребление видеокарты GeForce GTX 680 с разгоном без поднятия напряжения

1. Система в режиме простоя потребляет = 145 ватт

2. Система с видеокартой в режиме полной нагрузки кушает = 344 ватта

3. Получившаяся разница = 199 ватт

4. Добавим среднее энергопотребление карты в режиме простоя ~ 10 ватт

5. И получаем энергопотребление в нагрузке = ~ 209 ватт

Традиционно, предлагаю посмотреть на график энергопотребления различных видеокарт, среди которых, само-собой, имеется и основанный на графическом ядре GK104 видеоадаптер от Nvidia в обоих режимах работы:

В оригинальном материале этого нет, но я на всякий случай напомню, что Гуру3Д рекомендуют обзавестись блоком питания мощностью не менее 550 ватт для одной карточки и 750 ватт - для двух GTX 680 в SLI.

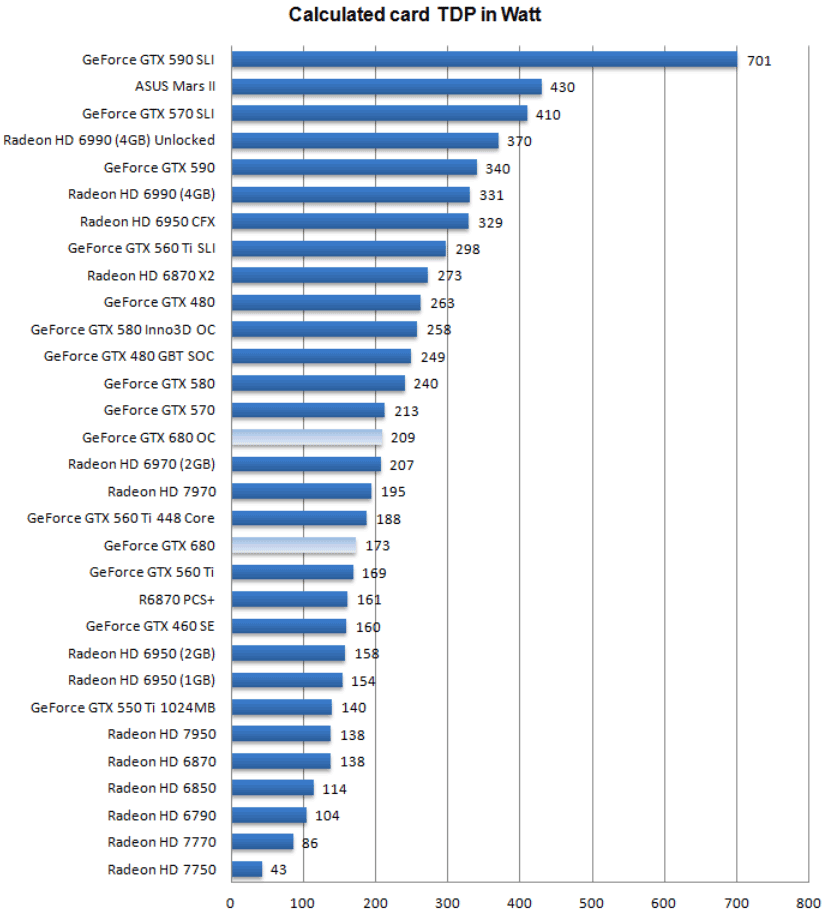

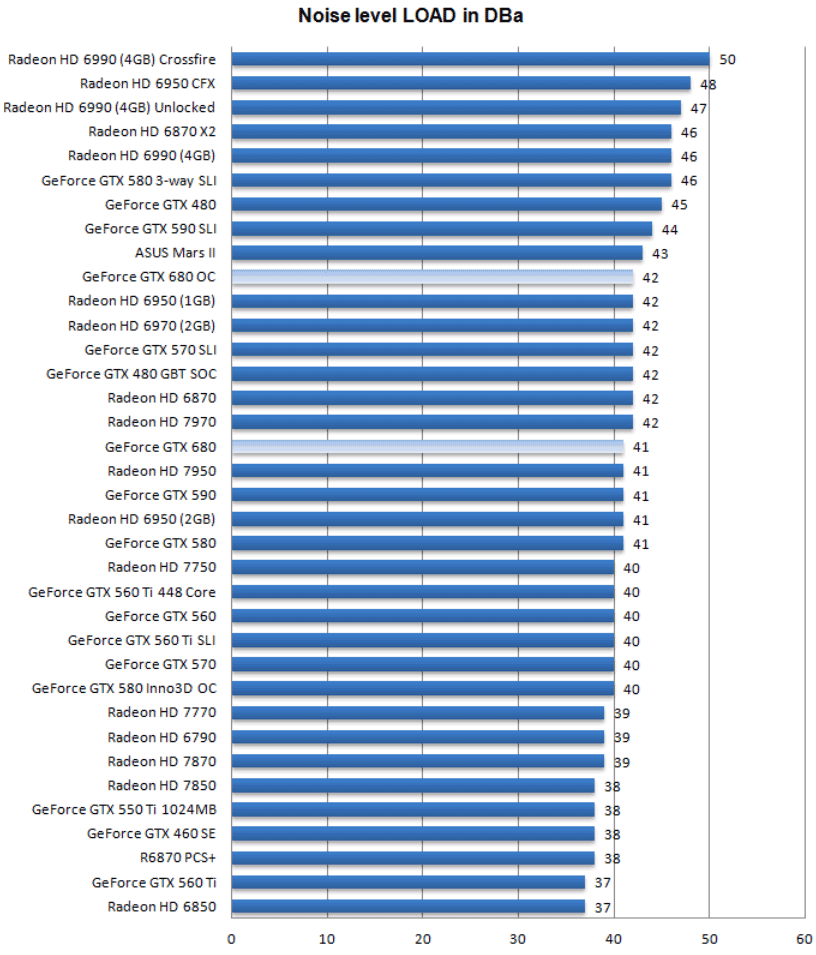

Уровень шума, издаваемый системами охлаждения видеокарт GeForce GTX 680 (Kepler)

Посмотрим, увеличился ли шум от системы охлаждения видеокарты GeForce GTX 680 в разгоне:

В простое ситуация не изменилась, это вполне объяснимо.

Разница между разогнанной и не разогнанной картой GTX 680 по уровню шуму составила один децибел, разумеется громче работает разогнанная видеокарта.

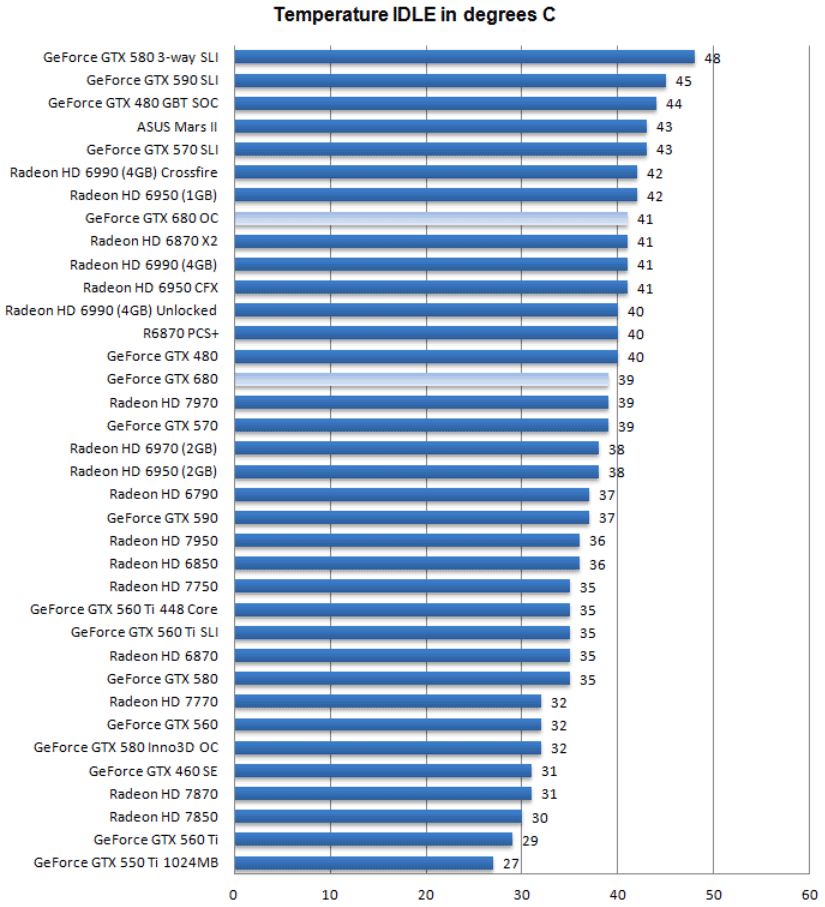

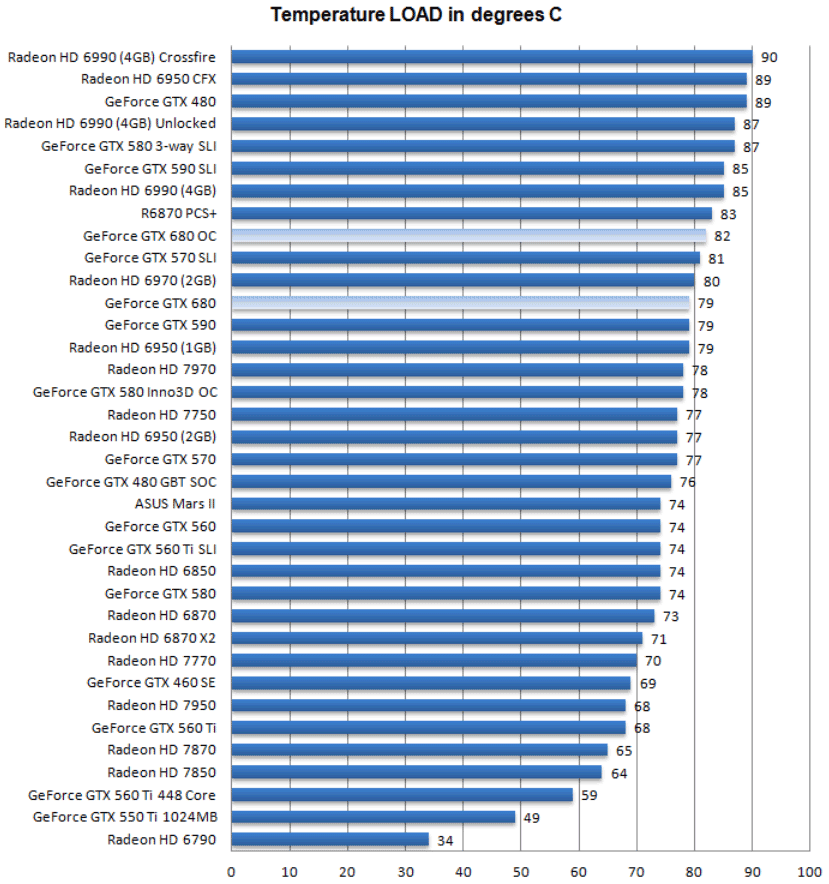

Температурный режим

Поглядим, увеличились ли в разгоне рабочие температуры последнего доступного изделия компании мистера Хуанга, находящегося в простое:

Разница составила 2 градуса по Цельсию.

В нагрузке ситуация чуть хуже, но всё ещё не критическая (что не удивительно, ибо разгон без увеличения напряжения вряд ли сможет сильно раскочегарить карту) - 3 градуса разницы.

Конфигурация тестового стенда и используемые игры

Материнская плата - MSI Big Bang XPower X58

Процессор - Core i7 965 @ 3750 МГц

Видеокарта - GeForce GTX 680 (Kepler)

Оперативная память - Corsair 6144МБ (3x 2048МБ) DDR3 1500 МГц

Блок питания - 1200 ватт

Монитор - Dell 3007WFP - разрешение до 2560x1600

Операционная система - Windows 7 х64 SP1

DirectX 9/10/11 End User Runtime (самые последние версии)

NVIDIA GeForce 309.99

AMD Catalyst (12.1/12.2)

Игры и синтетические тесты:

- Metro 2033

- Battlefield Bad Company 2

- Battlefield 3

- Crysis 2 DX11 + HQ Texture pack

- Hard Reset

- Aliens vs Predator

- Lost Planet 2

- Anno 2070

- 3DMark Vantage

- 3DMark 11

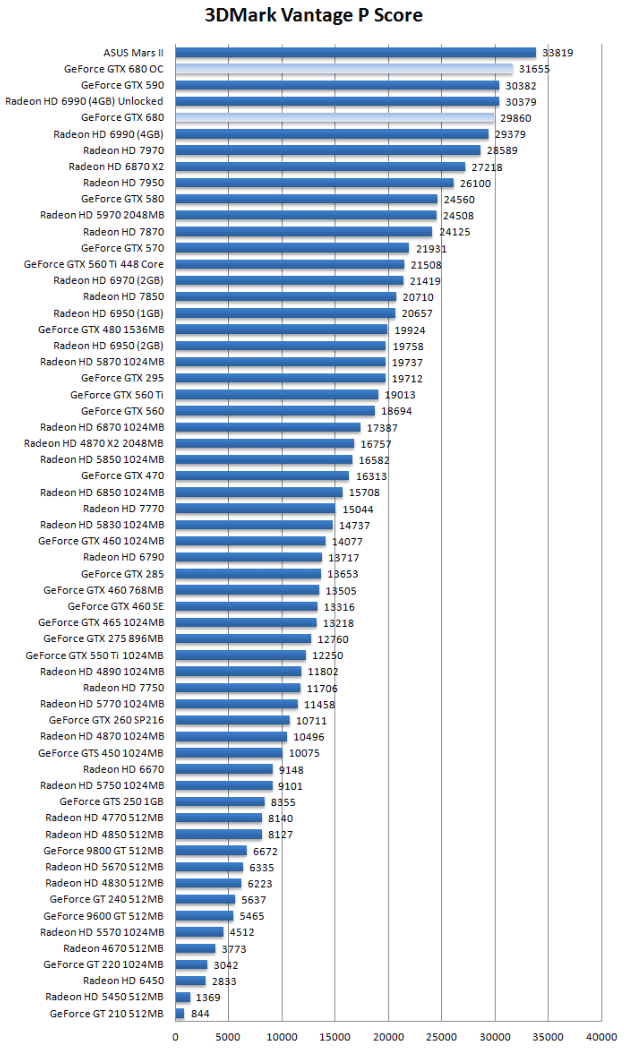

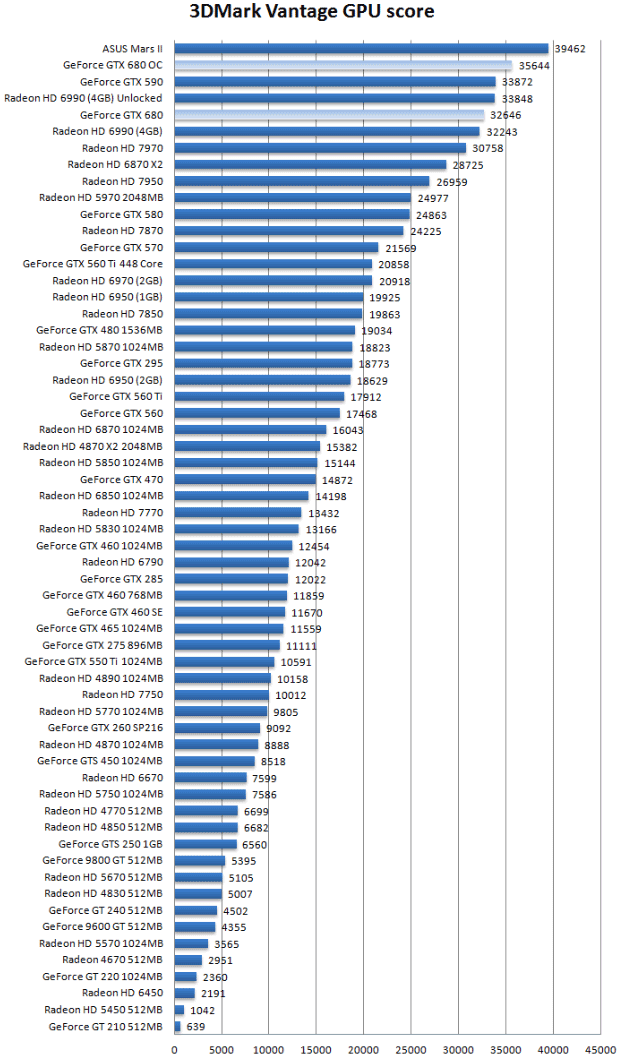

DX10: 3DMark Vantage

Как ясно из таблицы - тестирование в Вантаже происходило на пресете Performance.

Ранее, P-тестированием всё и ограничивалось, но теперь (уже в течении довольно-таки длительного периода времени) Гилберт проводит ещё и тест чисто по GPU, как наиболее правильный по его мнению:

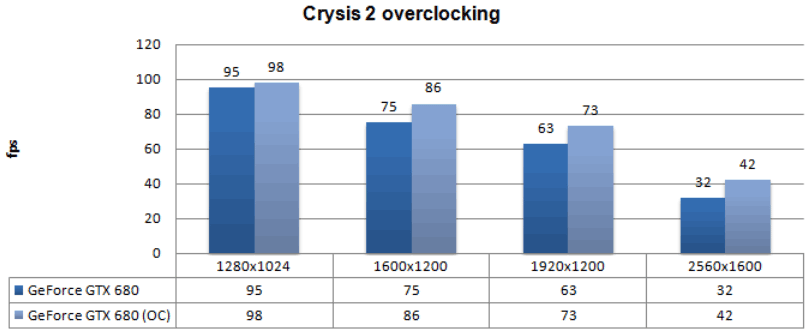

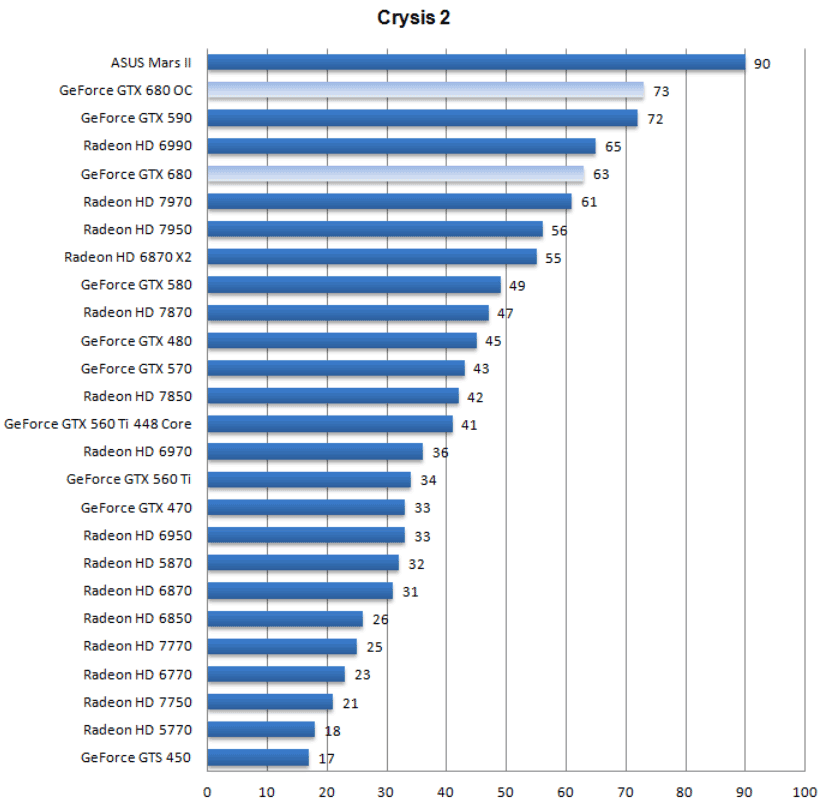

DX11: Crysis 2 + текстуры высокого разрешения

Игра тестировалась с установленным DX11 патчем и набором текстур высокого разрешения. Про пользу от инсталляции этих полезных вещей Вы можете почитать вот тут.

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

Вот какое гонялось Time Demo:

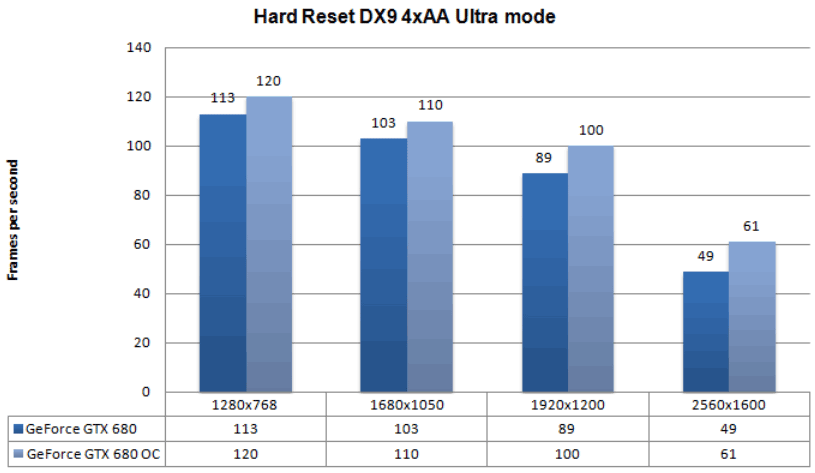

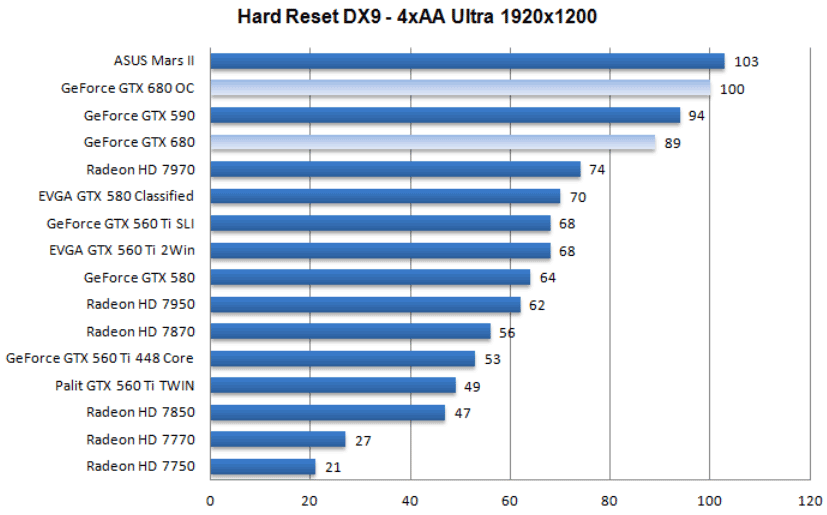

DX9: Hard Reset

|

Тестирование проводилось на следующих настройках:

|

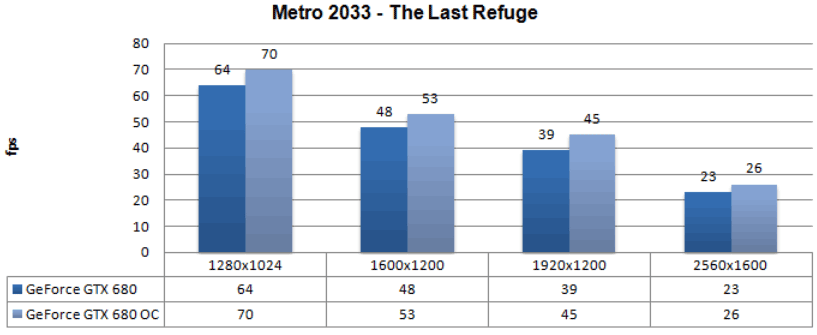

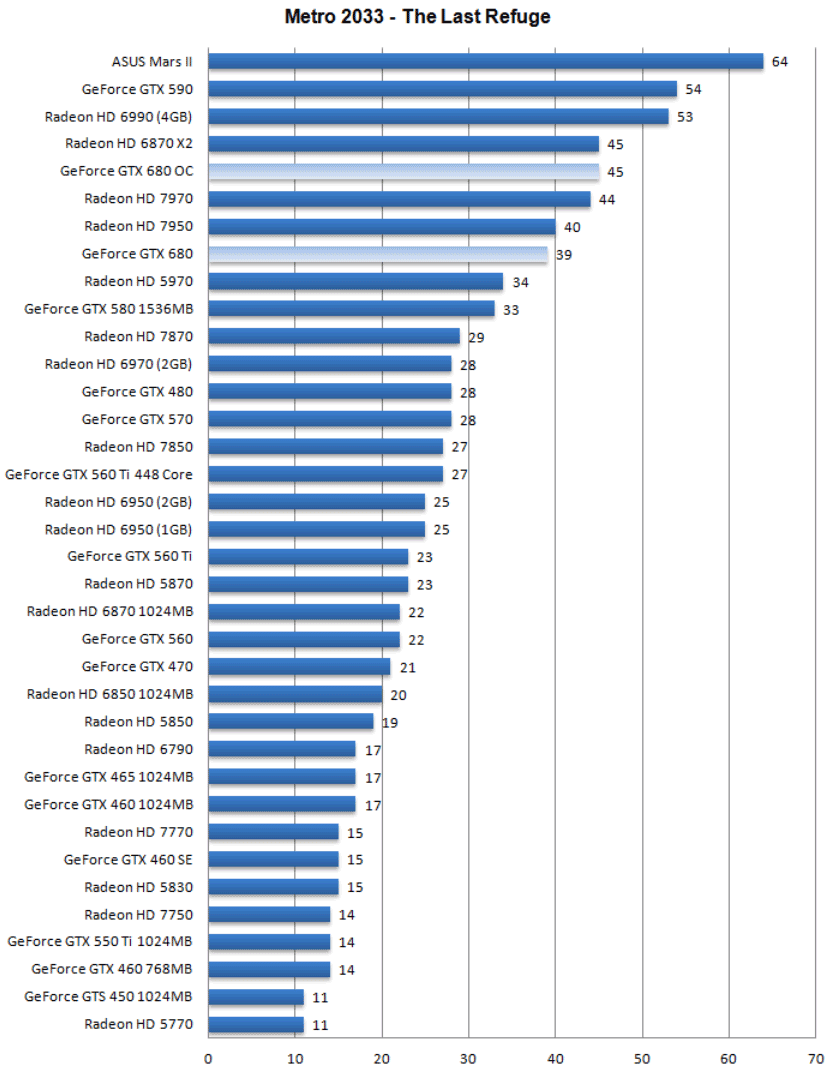

DX11: Metro 2033

|

Настройки в игре: вся графика на максимум, DX11, ААА включен, Physx выключен. |

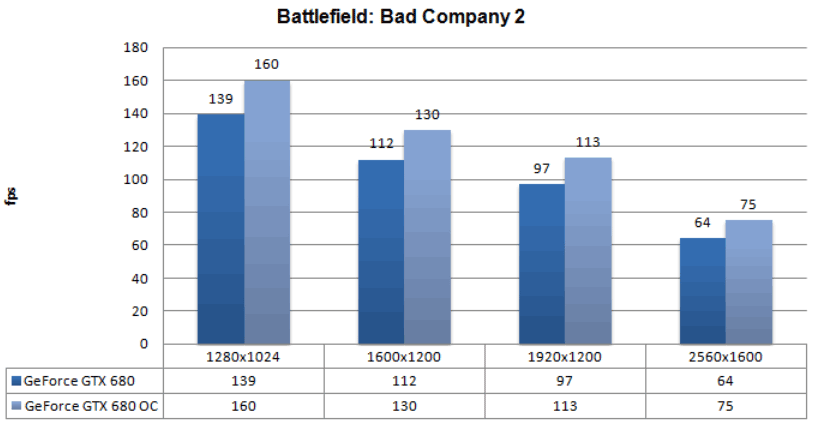

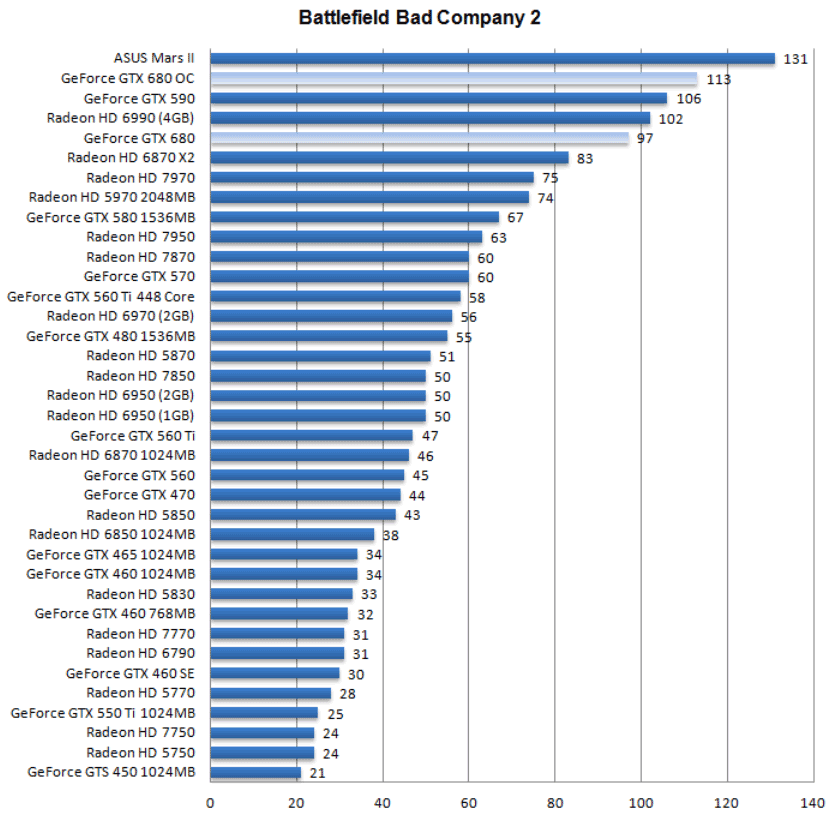

DX11: Battlefield Bad Company 2

|

Тестирование проводилось на следующих настройках:

|

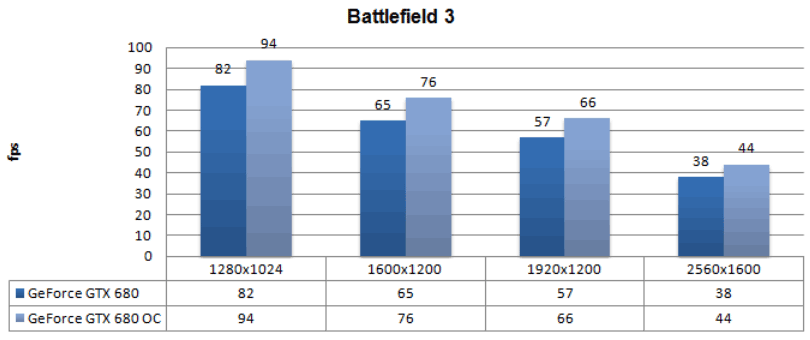

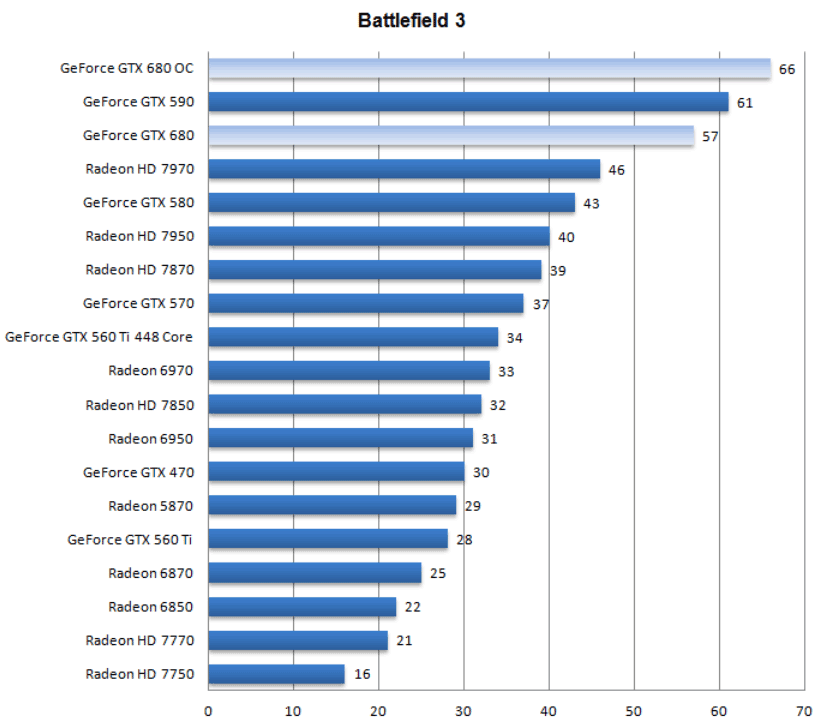

DX11: Battlefield 3

|

Тестирование проводилось на следующих настройках:

|

Используемое TimeDemo:

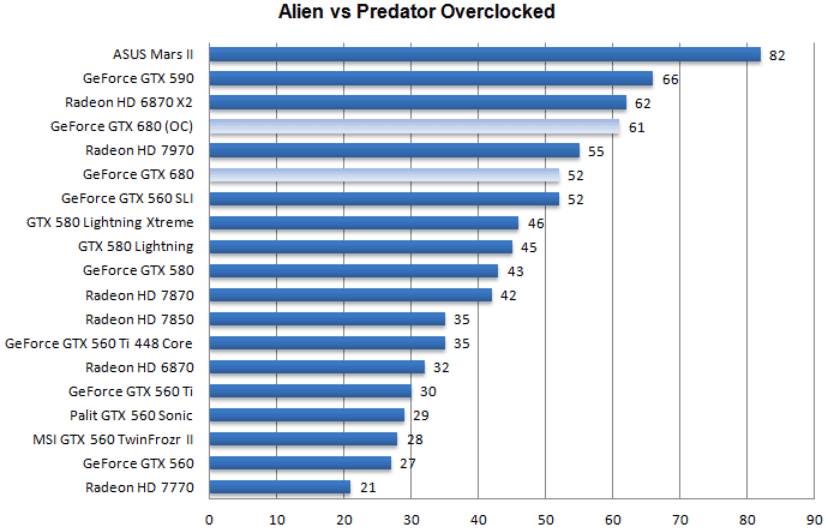

DX11: Aliens Versus Predator

|

Тестирование проводилось на следующих настройках:

|

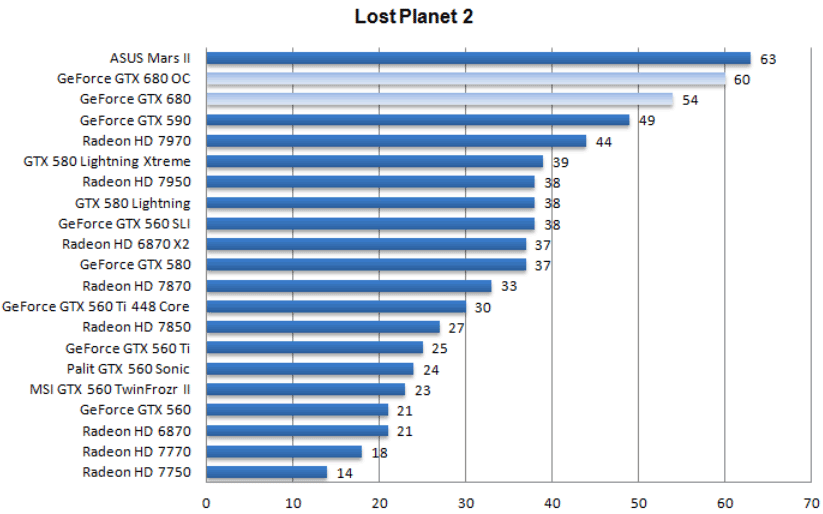

DX11: Lost Planet 2

|

Тестирование проводилось на следующих настройках:

|

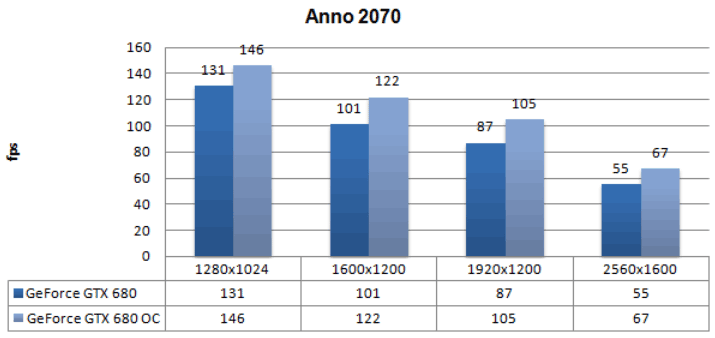

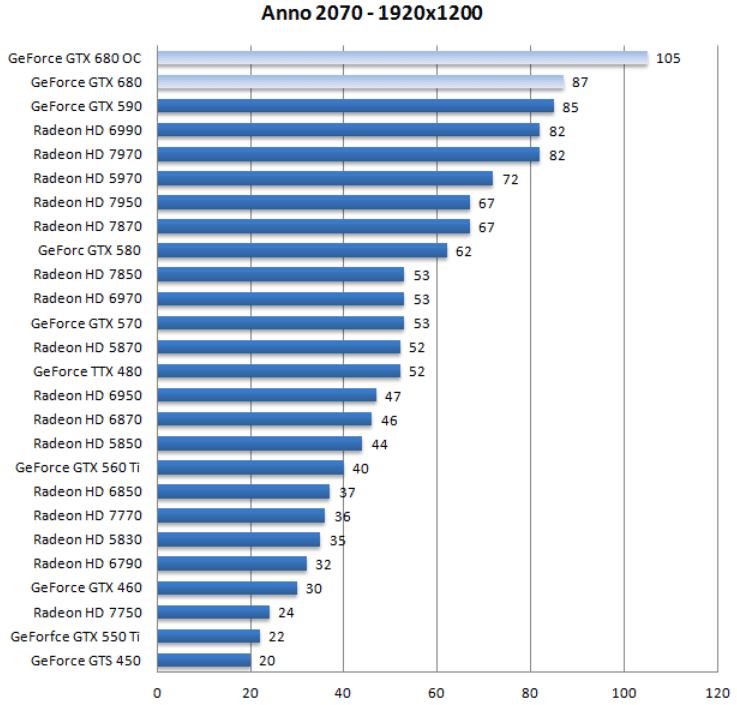

DX11: Anno 2070

|

Тестирование проводилось на следующих настройках:

|

Сводный график производительности различных решений в игре:

А вот видео из этой игры, записанное Guru3D:

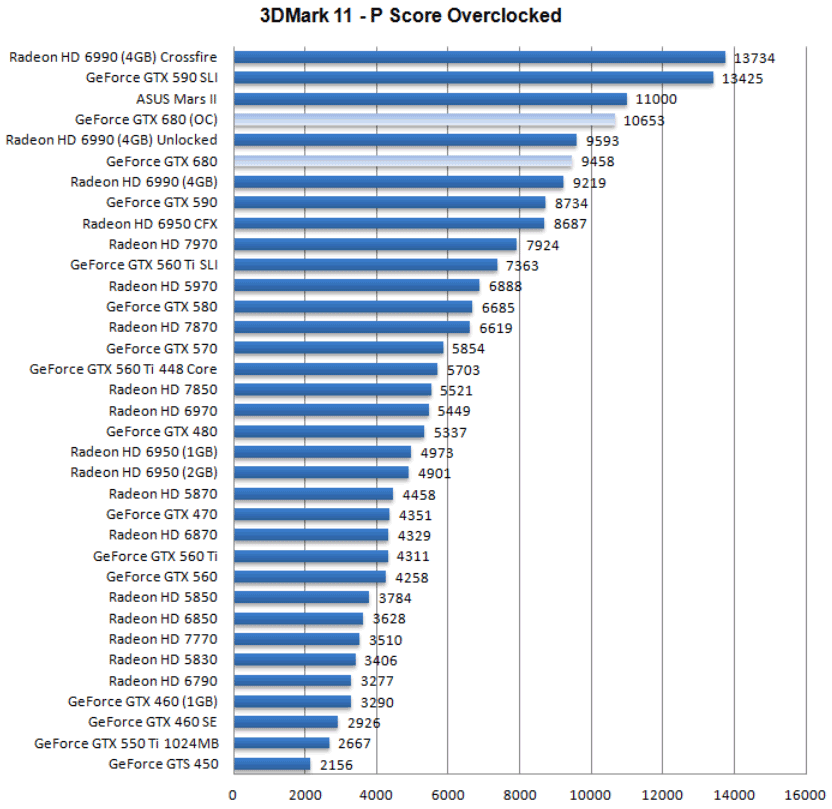

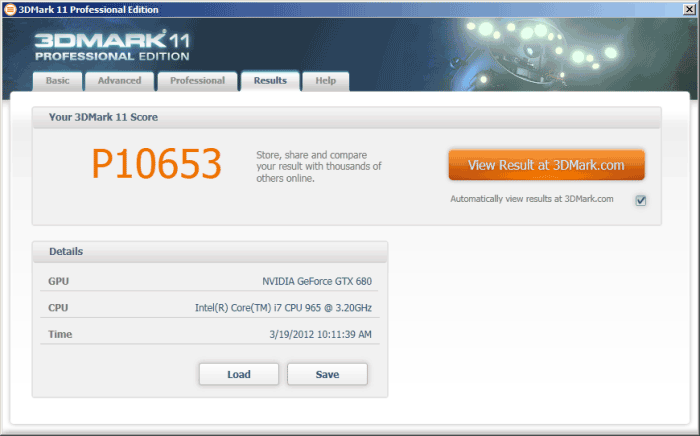

DX11: 3DMark 11

Последний из доступных 3ДМарк'ов, всегда интересно посмотреть на то, как выступят в нём различные DX11 видеокарты.

Тест проходил на пресете Performance.

Выводы

Автор оригинального материала сразу отвечает на вопрос, который мог назреть ещё до прочтения данного материала - а зачем было тестировать карту в разгоне, когда в прошлом обзоре это уже было сделано? Дело в том, что в прошлый раз ревьювер ограничился полностью безопасным разгоном до 1200-1250МГц, а в этот дело дошло до 1300-1325МГц. Отмечается, что при частотах свыше 1350МГц карточка вела себя нестабильно, так что если необходим более крутой разгон, надо ждать способа повышения напряжения на графическом ядре видяхи (и запастись крутой СО).

"Фича" динамического изменения тактовой частоты графического ядра (Dynamic Boost) играла, как говорится, на оба фронта - то она выдавала больше 1300МГц, то меньше, причём последнее - значительно сильнее, к примеру один раз был момент, когда частота снижалась до 736МГц - каково? А чтобы частоту поднять хотя бы до номинального уровня, пришлось перезагружать систему.

В целом, разгон без поднятия напряжения не сулит значительного увеличения температурных показателей и уровня шума карты, всё в рамках приличий (если такое вообще можно сказать об эталонном кулере), потому если кому-то повезёт приобрести GTX 680 с нереференсным кулером высокого качества, оверклокинг будет приносить одни лишь плюсы (если забыть об увеличившемся энергопотреблении карточки).

Автор оригинального материала называет рост производительности от разгона вполне значительным, плюс выражает мнение, что было бы здорово посмотреть на успехи GTX 680, разогнанной до 1400МГц (и выше) с поднятием напряжения.

Итого - GeForce GTX 680 является впечатляющим продуктом во многих аспектах, разгон - не исключение. Приобрести 20% рост производительности и при этом не получить ревущий атомный реактор (речь о том, что в разгоне карточка шумит и греется не сильно больше не разогнанной) в корпусе ПК очень даже привлекательная перспектива.

p.s. Обязательно посмотрите "Армаду" по GTX 680, она постоянно пополняется новыми видеокартами этого семейства.

Автор оригинальной статьи - Hilbert Hagedoorn, "перевод" - Slayer Moon, эксклюзивно для www.u-sm.ru

Статья является вольным переводом, даже скорее, пересказом обзора устройства с сайта Guru3D, она не нарушает ничьих прав, ибо все права принадлежат их авторам, а фотографии к статье - фотографам с указанного выше Интернет-ресурса

Если Вы заметите ошибки, помарки и прочее - дайте мне знать: Ctrl+Enter (Орфус).

|

|

| < Обзор видеокарты HIS Radeon HD 7770 iCooler | Одна карта - хорошо, а две - лучше. Обзор и тестирование пары ASUS GeForce GTX 680 в SLI > |

|---|