Раз уж релиз GTX 680 состоялся, я не мог пройти мимо этого важного события и не осветить его на страницах сего сайта должным образом. Представляю Вашему вниманию пересказ материала видеокарты на базе GK104 с ресурса Guru3D.

Раз уж релиз GTX 680 состоялся, я не мог пройти мимо этого важного события и не осветить его на страницах сего сайта должным образом. Представляю Вашему вниманию пересказ материала видеокарты на базе GK104 с ресурса Guru3D.

Спецификации новой видеокарты от Nvidia, а также некоторых её родственниц изложены в табличке ниже:

| GTX 680 | GTX 580 | GTX 560 Ti | GTX 480 | |

| Потоковые процессоры | 1536 | 512 | 384 | 480 |

| Текстурные блоки |

128 | 64 | 64 | 60 |

| ROPы | 32 | 48 | 32 | 48 |

| Частота ядра |

1006МГц | 772МГц | 822МГц | 700МГц |

| Частота шейдеров |

Н/Д | 1544МГц | 1644МГц | 1401МГц |

| Частота Boost | 1058МГц | Н/Д | Н/Д | N/A |

| Частота памяти |

6.008ГГц GDDR5 | 4.008ГГц GDDR5 | 4.008ГГц GDDR5 | 3.696ГГц GDDR5 |

| Шина памяти |

256-бит | 384-бит | 256-бит | 384-бит |

| Объём памяти |

2ГБ | 1.5ГБ | 1ГБ | 1.5ГБ |

| FP64 | 1/24 FP32 | 1/8 FP32 | 1/12 FP32 | 1/12 FP32 |

| TDP | 195 ватт | 244 ватта | 170 ватт | 250 ватт |

| Количество транзисторов |

3.5 миллиарда | 3 миллиарда | 1.95 миллиарда | 3 миллиарда |

| Тех.процесс изготовления |

TSMC 28нм | TSMC 40нм | TSMC 40нм | TSMC 40нм |

| Стоимость, установленная при запуске решения |

$499 | $499 | $249 | $499 |

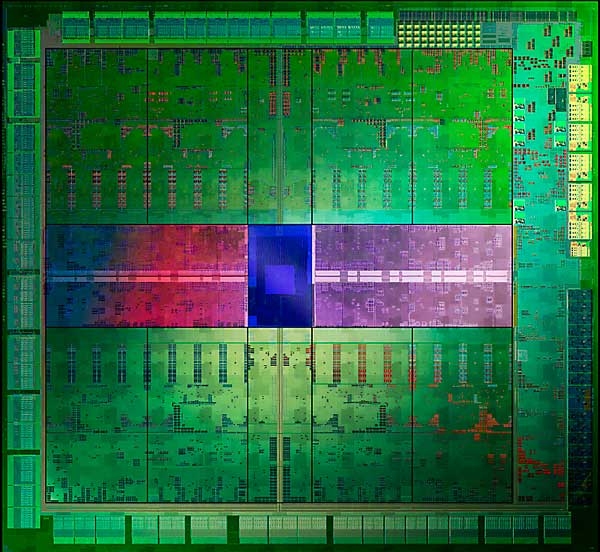

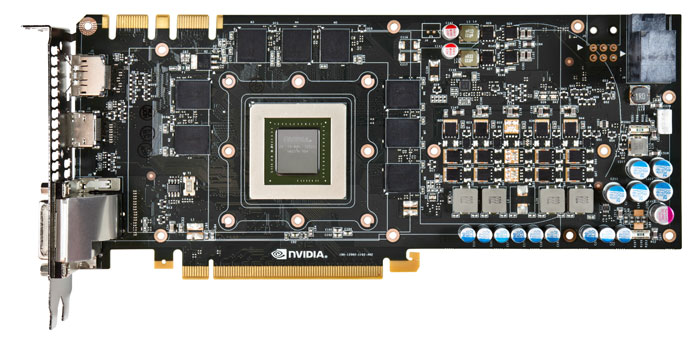

Далее приводится следующий снимок:

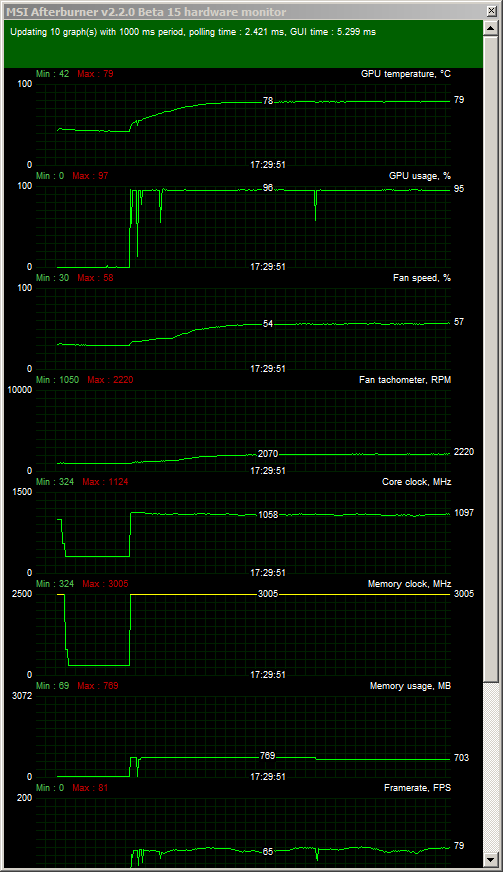

Позже рассказывается обо всех изменениях в архитектуре новинки, из которых стоит обратить внимание на описываемую ранее в новостных материалах возможность новых GeForce увеличивать тактовую частоту ядра при сохранении типичного показателя TDP, вот как это выглядит на графике с MSI Afterburner:

Как видно, карточка при игровой нагрузке подняла тактовую частоту ядра со стандартных 1006/1058 до 1124МГц, по крайней мере такие данные приводит автор оригинального материала.

Ещё интересным (но лично для меня не особо применимым) новшеством стала возможность одновременного вывода изображения на 4 монитора одновременно, выглядит такой сетап следующим образом:

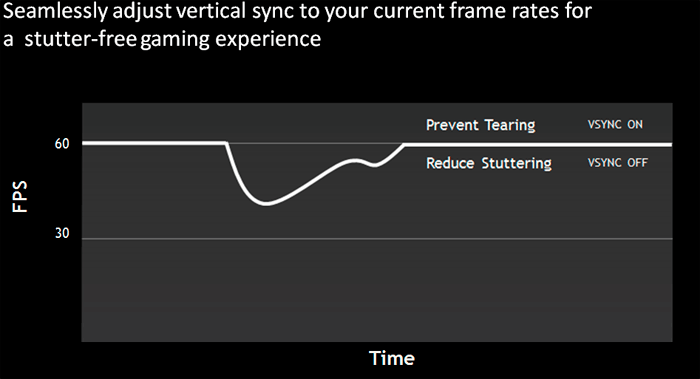

Нам также рассказали о технологии адаптивной вертикальной синхронизации (Adaptive Vsync), которая позволит картинке на мониторе идти максимально гладко, даже если количество кадров в игре превосходит вертикальную синхронизацию дисплея (к примеру, в игре 120FPS, а монитор выдаёт не более 60Гц). К этому делу приведён следующий слайд:

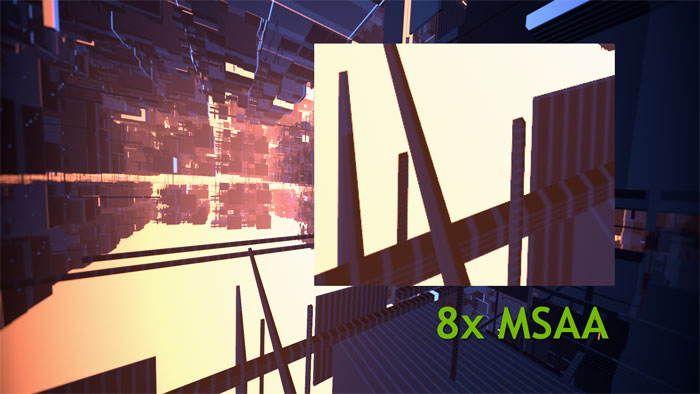

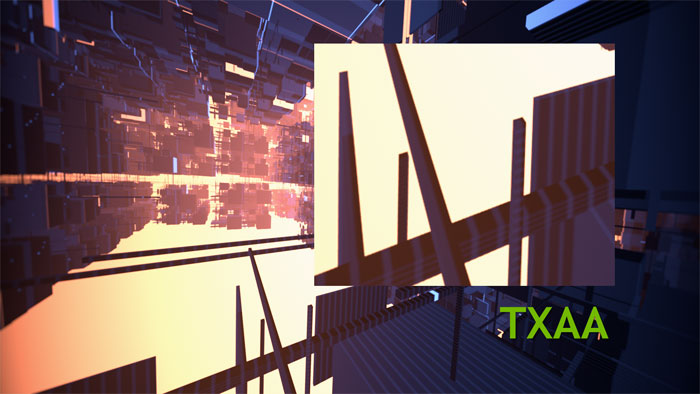

Не забыли нам поведать и о новом методе антиалиасинга (сглаживания), именуемом TXAA. Его отличительной особенностью стало высокое качество картинки при небольшом (по сравнению с MSAA) падении общей производительности.

Приведены следующие данные: TXAA 1 по уровню качества картинки выглядит лучше чем MSAA 8х, при том, что по нагрузке соответствует MSAA 2х. А ещё более качественный метод сглаживания TXAA 2 по нагрузке равен MSAA 4x. Вот для примера два слайда:

Ещё одной полезной "фичей" стало добавление NVENC, аппаратного энкодера видео в H.264. Теперь с помощью видеокарты GTX 680 можно кодировать видео в разрешении до 4096x4096, само-собой в разы быстрее, чем если бы эту задачу возложил бы на свои плечи один лишь процессор.

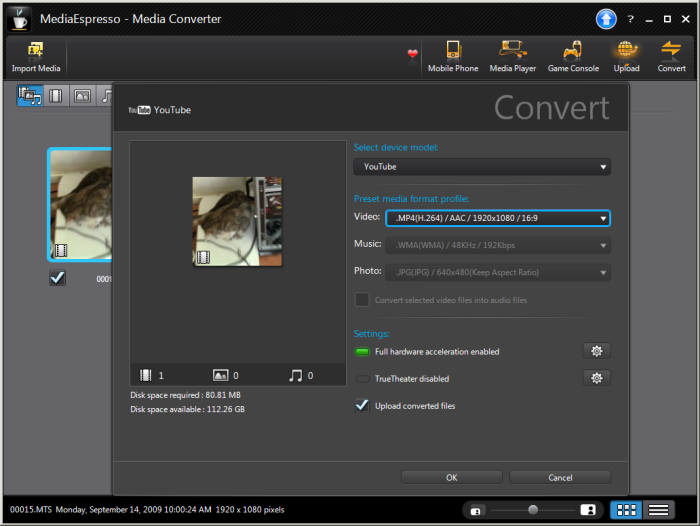

Вот скриншот из MediaEspresso, что поддерживает новую возможность основанной на Kepler карточки:

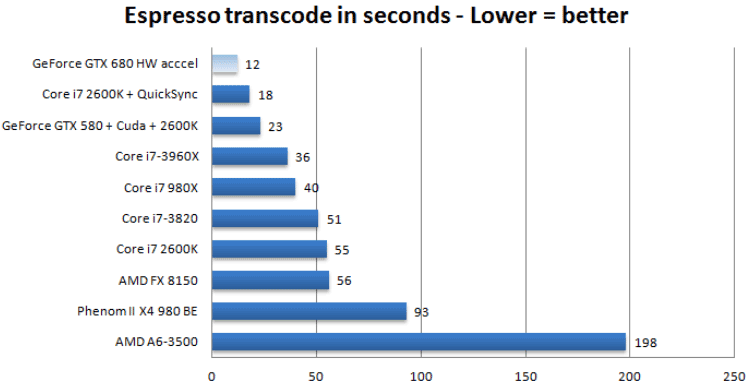

Ниже приведён график, на котором можно увидеть, насколько аппаратное кодирование видео с помощью GTX 680 в H.264 быстрее процессорного:

Чем меньше секунд затрачивается на процесс кодирования видео, тем лучше. Результат впечатляет, ведь GTX 680 справился с той же задачей в 2 раза быстрее, чем GTX 580 (с помощью CUDA кодирования) и в 3 раза быстрее, чем шестиядерный процессор Core i7-3960X.

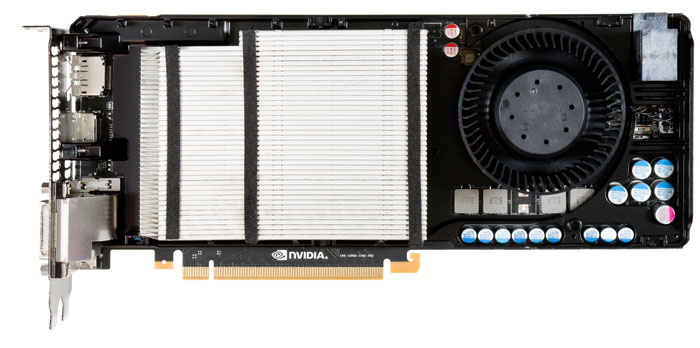

Фотогалерея GeForce GTX 680 (Kepler)

Перед нами референсный образец GeForce GTX 680. В таком же виде в настоящее время представлено подавляющее большинство видеокарт на базе графического ядра GK104, посмотреть их можно в Армаде.

Нам говорят, что карточка обладает 2ГБ видеопамяти, чего должно хватить на любые нужды в разрешении Full HD. Если планируются извращения, наподобие игры на трёх мониторах, лучше подождать 4ГБ вариант GTX 680.

Печатная плата имеет 4-х фазовую систему питания ядра и двух фазовую для памяти, новинка использует PCIe 3.0 x16 для подключения, но прекрасно чувствует себя и на PCIe 2.0 x16.

Уж не знаю почему, но ревьюверу нравится внешний вид карточки, якобы она будет хорошо смотреться в тех шасси, что имеют прозрачное окно в боковой стенке. А по мне так ничего особенного - референс, одним словом.

Сообщается, что до трёх (хотя на деле, вроде как, до четырёх) видеокарт GTX 680 можно объединить в SLI.

Энергопотребление решения находится на уровне 195 ватт, питается карточка от пары 6-и пиновых коннекторов БП. Guru3D рекомендуют 550 ваттный БП для системы с такой видеокартой.

В плане видеовыходов у GTX 680 имеется вот что: пара DL DVI, один HDMI 1.4a и один DisplayPort.

На GeForce GTX 680 мы видим новый кулер, что снабжён некой системой поглощения акустического шума (я и сам в это не верю, беспокоиться не стоит), в нём три теплотрубки (проходящие сквозь алюминиевые пластины радиатора) и один вентилятор так называемого турбинного типа. Нам советуют не забывать об организации прилично вентилируемой системы (имеется в виду грамотное снабжение корпуса компьютера вентиляторами).

Полюбуемся печатной платой изделия и приступим к тестам.

Энергопотребление/температурный режим/уровень шума

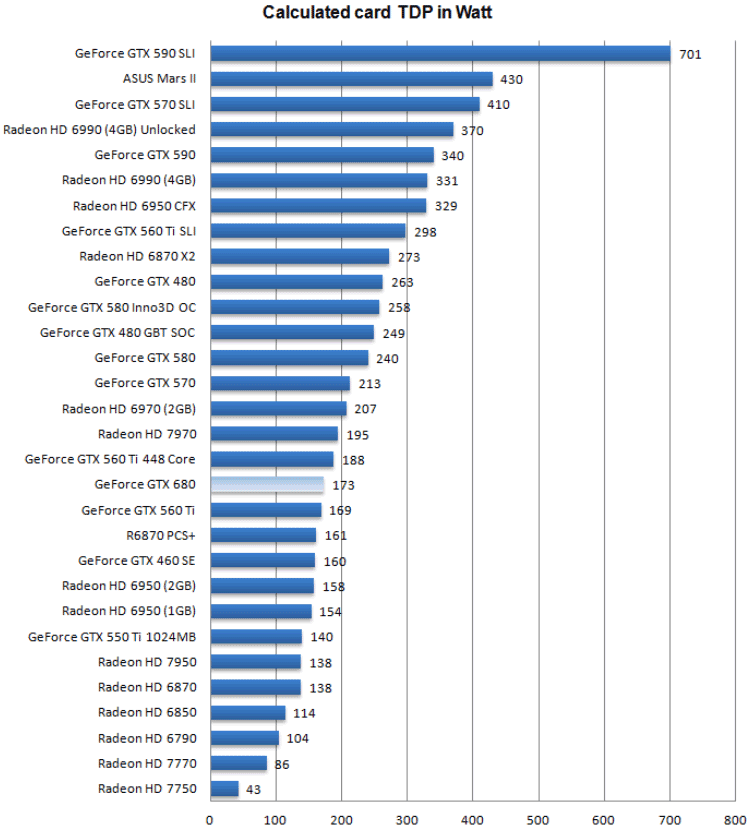

Энергопотребление видеокарты GeForce GTX 680 (Kepler)

1. Система в режиме простоя потребляет = 144 ватта

2. Система с видеокартой в режиме полной нагрузки кушает = 307 ватт

3. Получившаяся разница = 163 ватта

4. Добавим среднее энергопотребление карты в режиме простоя ~ 10 ватт

5. И получаем энергопотребление в нагрузке = ~ 173 ватта

Традиционно, предлагаю посмотреть на график энергопотребления различных видеокарт, среди которых, само-собой, имеется и основанный на графическом ядре GK104 видеоадаптер от Nvidia:

Для GeForce GTX 680 Гуру3Д рекомендуют обзавестись блоком питания мощностью не менее 550 ватт для одной карточки и 750 ватт - для двух в SLI.

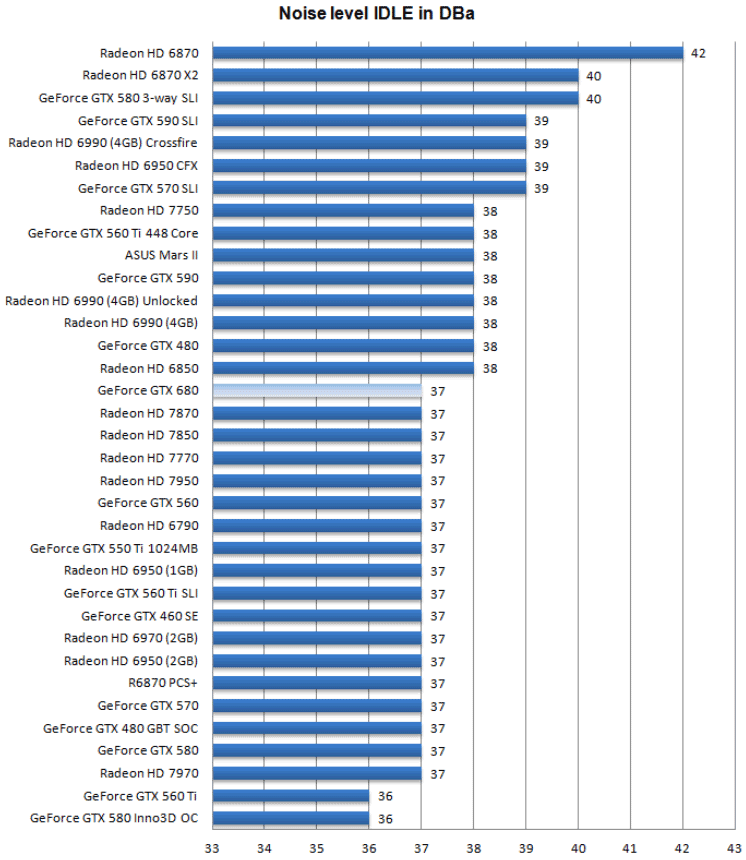

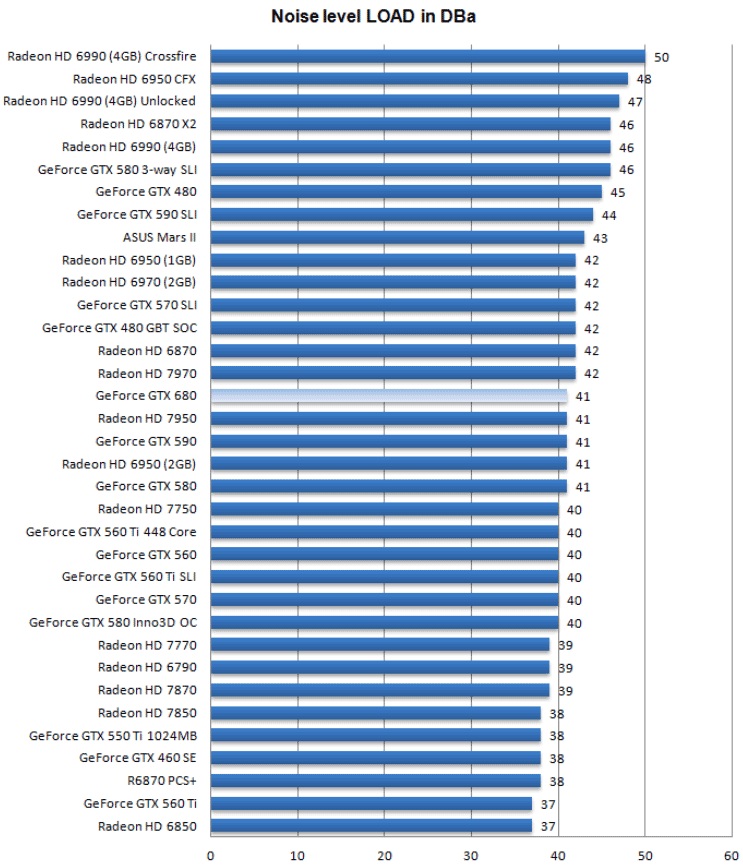

Уровень шума, издаваемый системой охлаждения видеокарты GeForce GTX 680 (Kepler)

Поглядим, как сильно шумит система охлаждения GeForce GTX 680 (Kepler):

Уровень шума в простое такой же как у многих решений этого же класса.

В нагрузке уровень шума высоковат, впрочем иного результат от референса подобной конструкции я и не ожидал.

Температурный режим

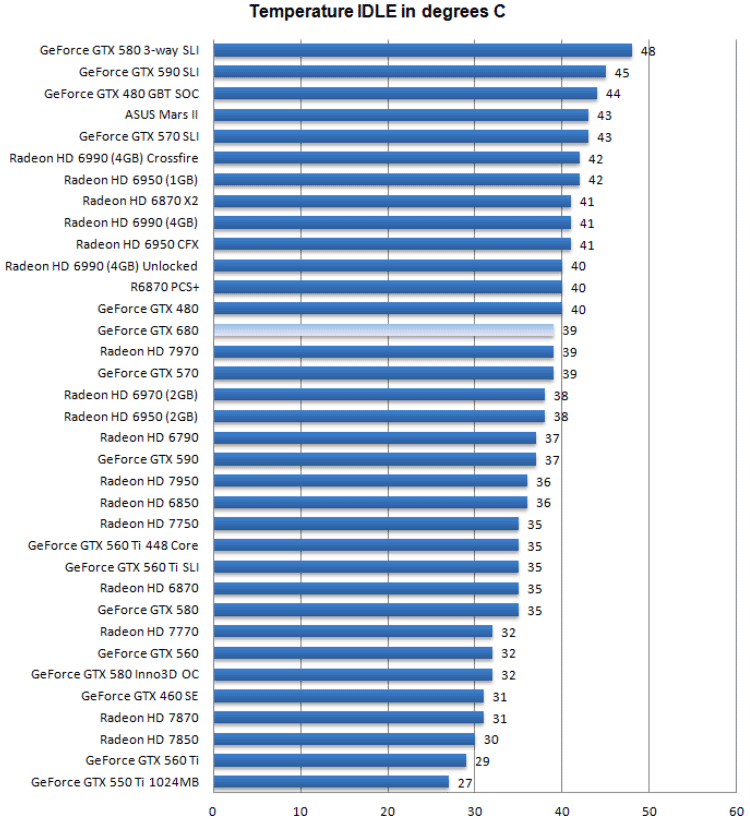

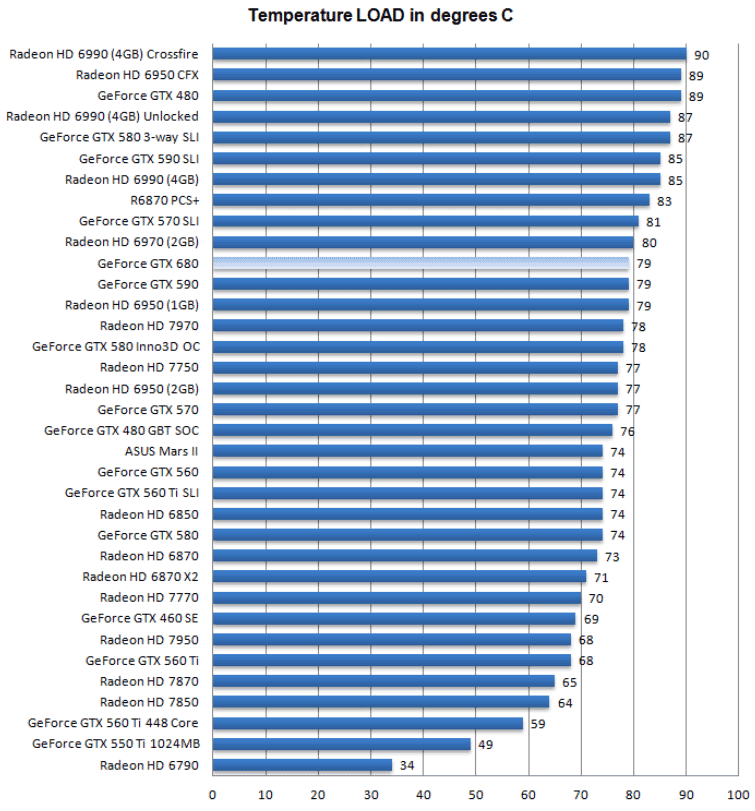

Давайте поглядим на то, как греются различные видеокарты, в том числе и гордость мистера Хуанга, GeForce GTX 680, в простое:

Температура в простое на 4 градуса выше, чем у эталонной GTX 580, но всё равно не особо высокая.

В нагрузке мы видим ту же самую картину. Общее положение дел в плане температур, у GTX 680, можно назвать удовлетворительным.

Конфигурация тестового стенда и используемые игры

Материнская плата - MSI Big Bang XPower X58

Процессор - Core i7 965 @ 3750 МГц

Видеокарта - GeForce GTX 680 (Kepler)

Оперативная память - Corsair 6144МБ (3x 2048МБ) DDR3 1500 МГц

Блок питания - 1200 ватт

Монитор - Dell 3007WFP - разрешение до 2560x1600

Операционная система - Windows 7 х64 SP1

DirectX 9/10/11 End User Runtime (самые последние версии)

NVIDIA GeForce 309.99

AMD Catalyst (12.1/12.2)

Игры и синтетические тесты:

- Metro 2033

- Battlefield Bad Company 2

- Battlefield 3

- Far Cry 2

- Call of Duty - Modern Warfare 2

- Crysis 2 DX11 + HQ Texture pack

- Hard Reset

- Aliens vs Predator

- Lost Planet 2

- Anno 1404

- Anno 2070

- 3DMark Vantage

- 3DMark 11

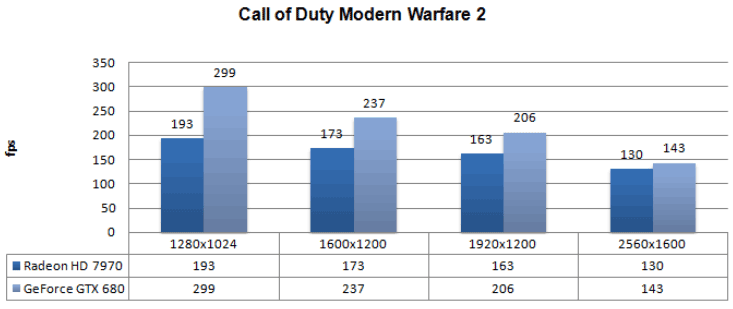

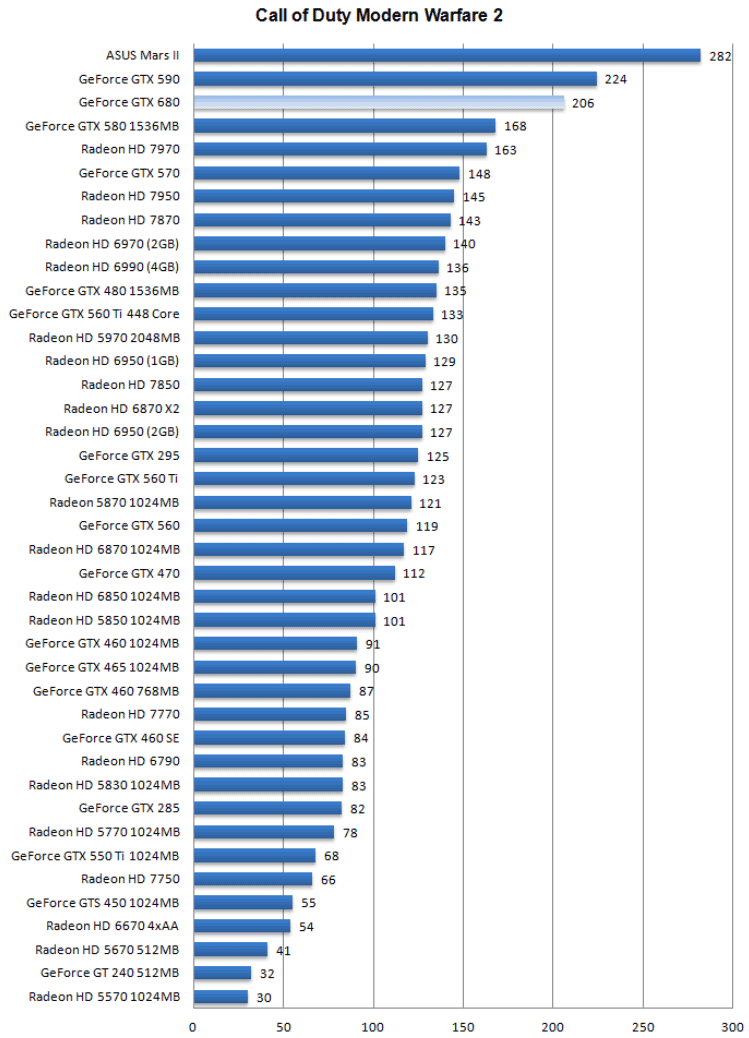

DX9: Call of Duty: Modern Warfare 2

Тестирование проводилось на следующих настройках:

- Уровень - Contingency

- 4x Антиалиасинг

- 16x Анизотропная фильтрация

- Все настройки на максимум

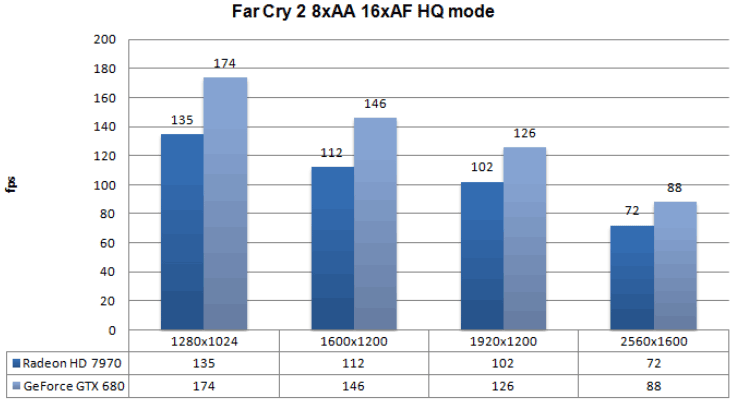

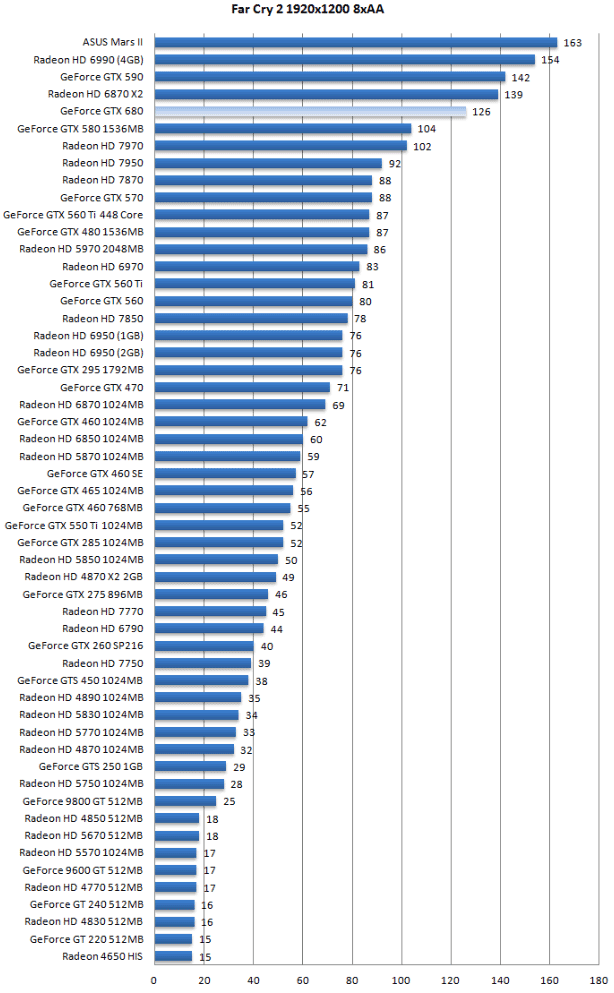

DX10: Far Cry 2

|

Тестирование проводилось на следующих настройках:

|

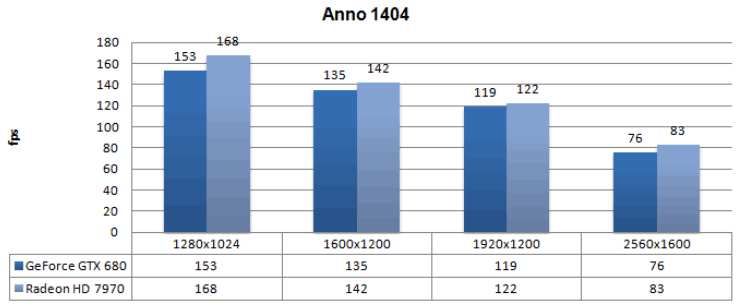

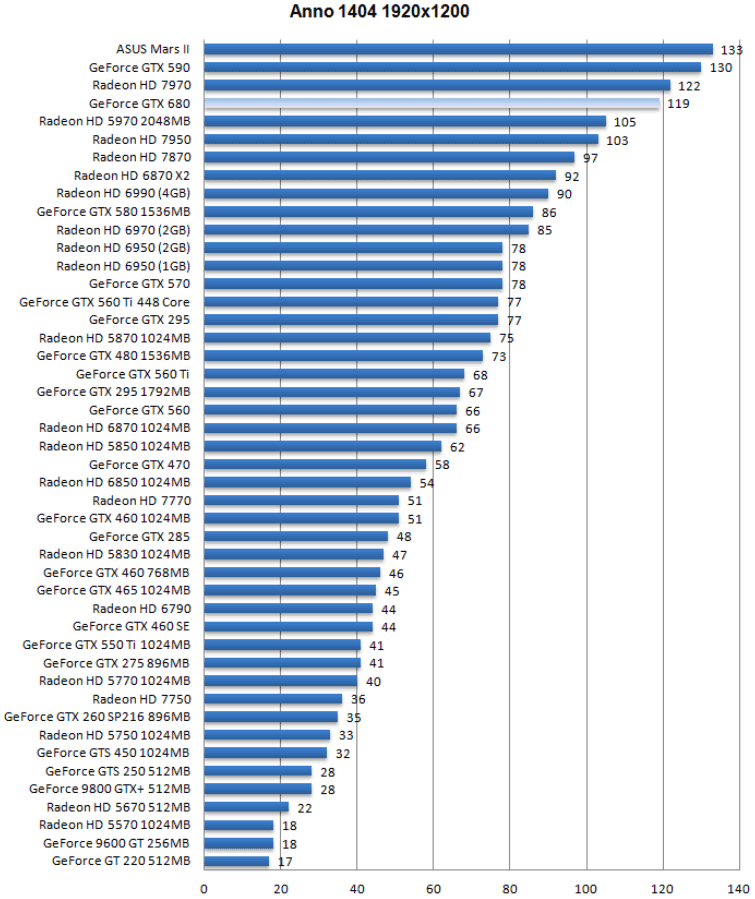

DX10: Anno 1404 - Dawn of Discovery

|

Тестирование проводилось на следующих настройках:

|

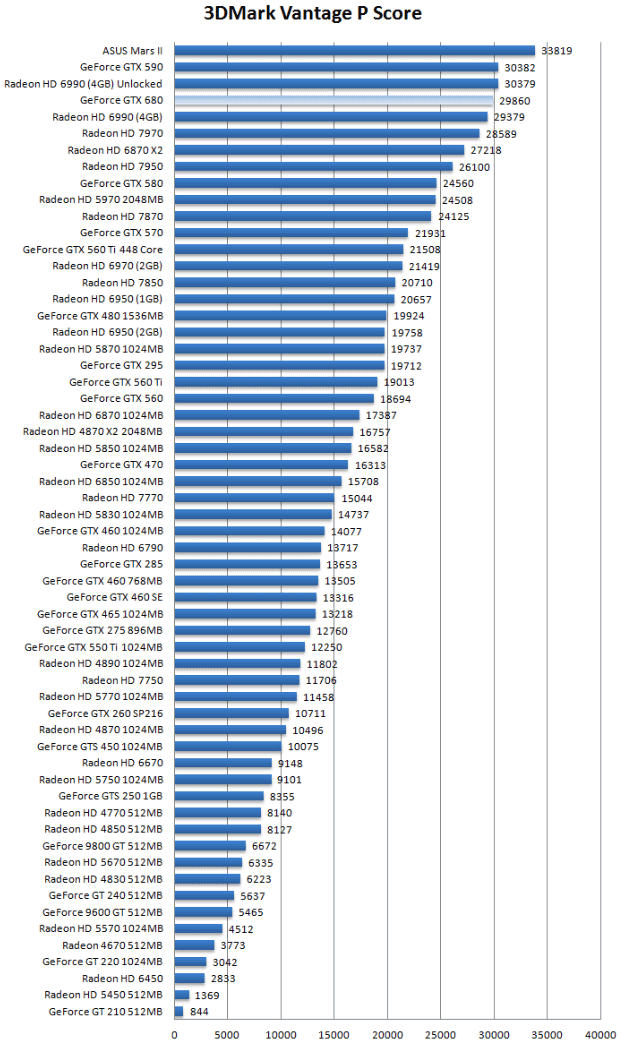

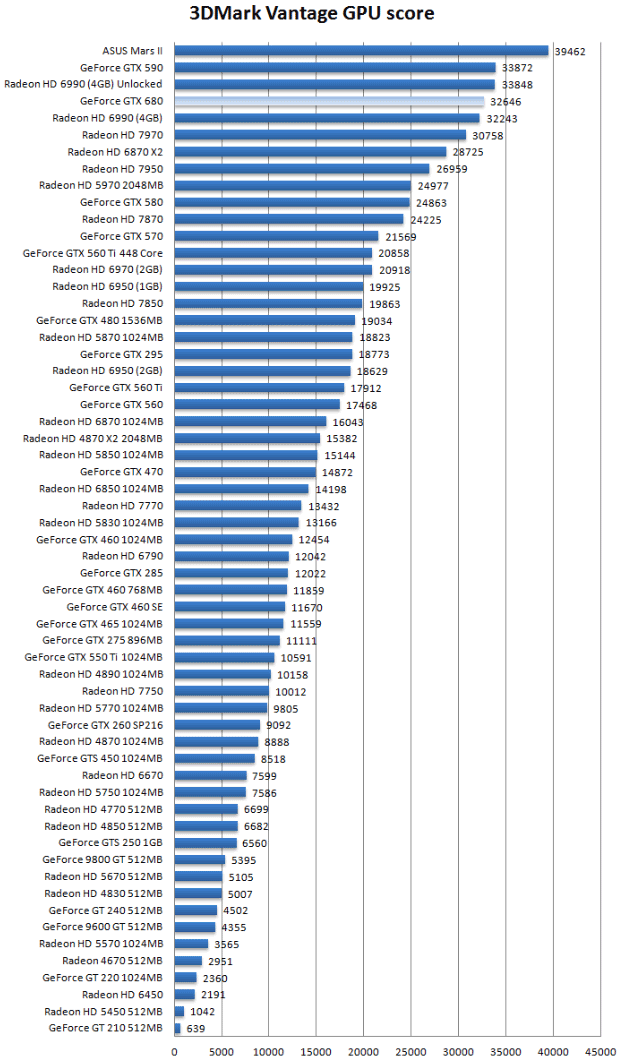

DX10: 3DMark Vantage

Как ясно из таблицы - тестирование в Вантаже происходило на пресете Performance.

Ранее, P-тестированием всё и ограничивалось, но теперь (уже в течении довольно-таки длительного периода времени) Гилберт проводит ещё и тест чисто по GPU, как наиболее правильный по его мнению:

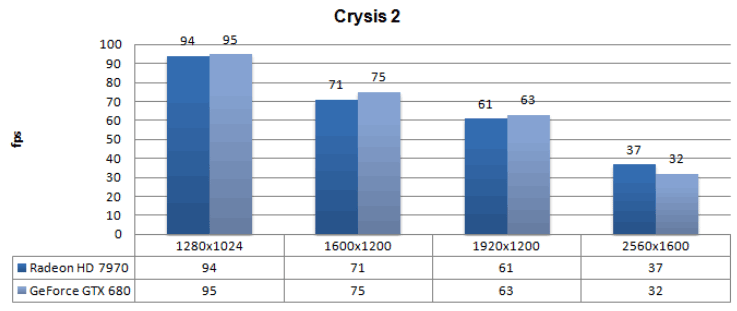

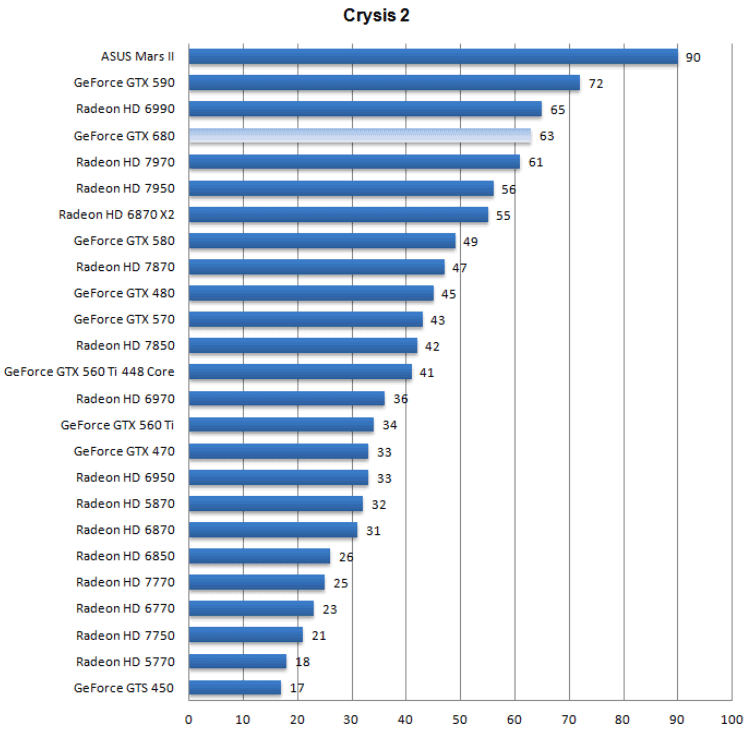

DX11: Crysis 2 + текстуры высокого разрешения

Игра тестировалась с установленным DX11 патчем и набором текстур высокого разрешения. Про пользу от инсталляции этих полезных вещей Вы можете почитать вот тут.

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

Вот какое гонялось Time Demo:

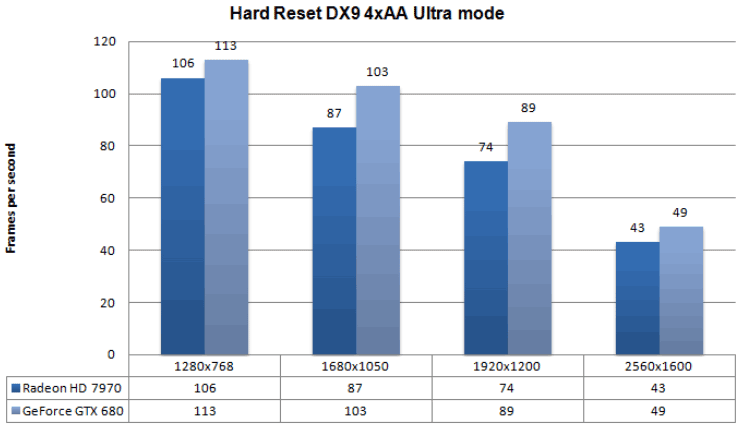

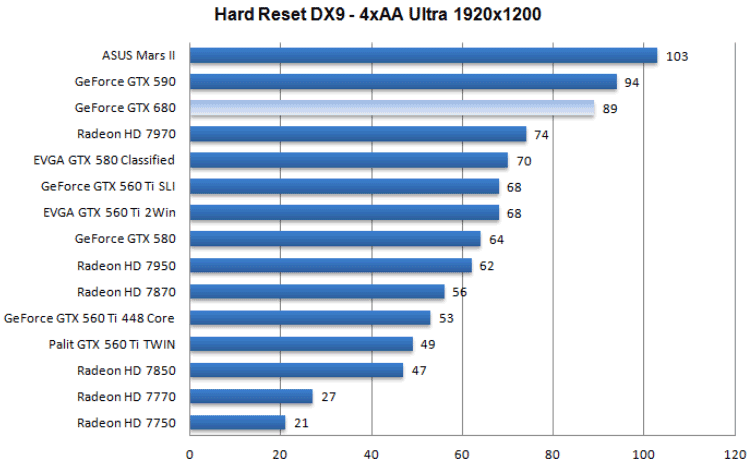

DX9: Hard Reset

|

Тестирование проводилось на следующих настройках:

|

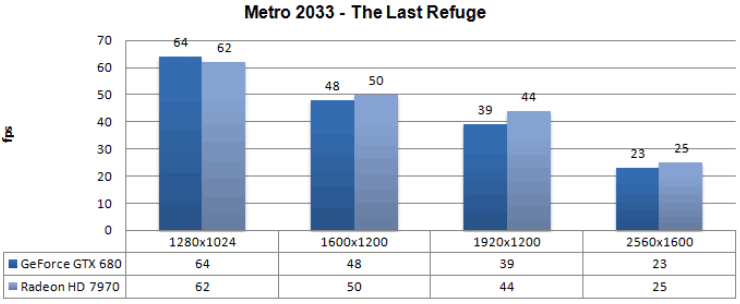

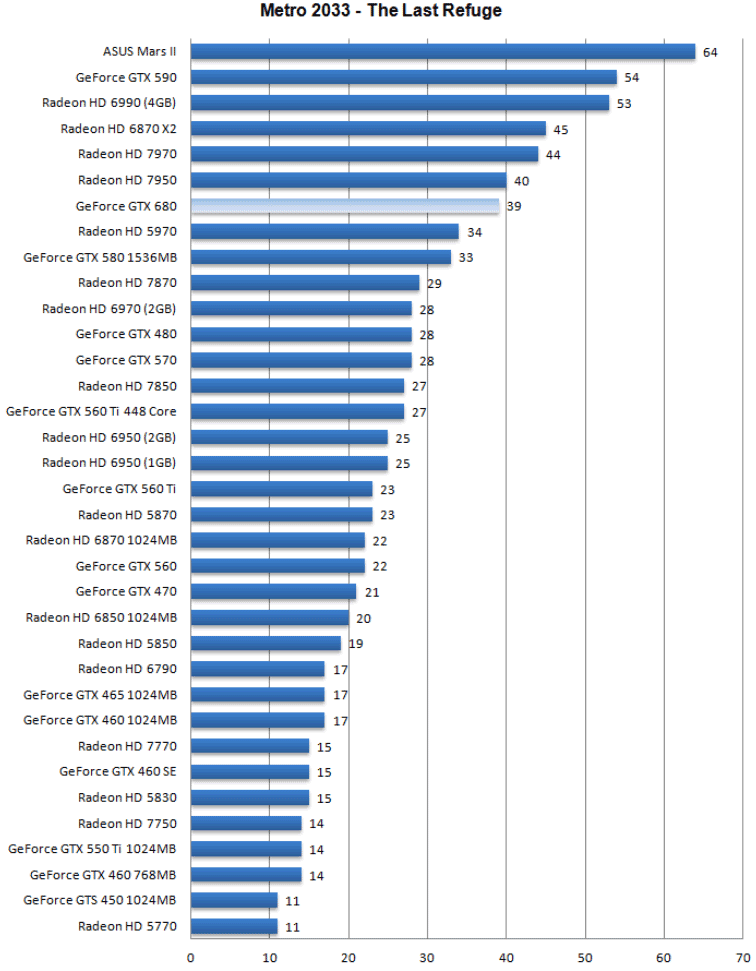

DX11: Metro 2033

|

Настройки в игре: вся графика на максимум, DX11, ААА включен, Physx выключен. |

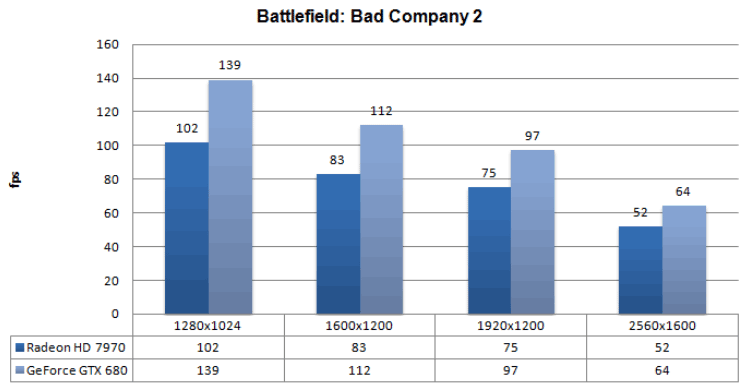

DX11: Battlefield Bad Company 2

|

Тестирование проводилось на следующих настройках:

|

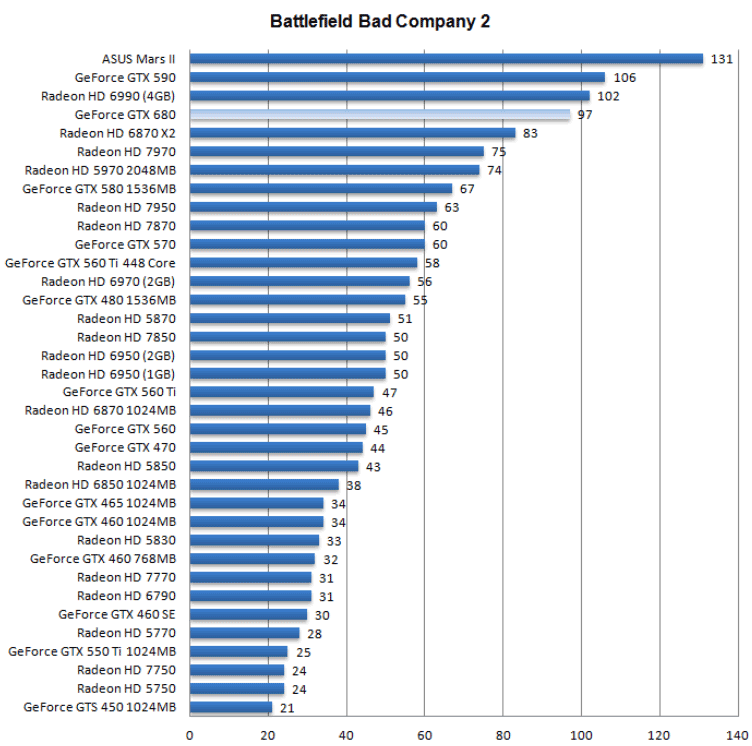

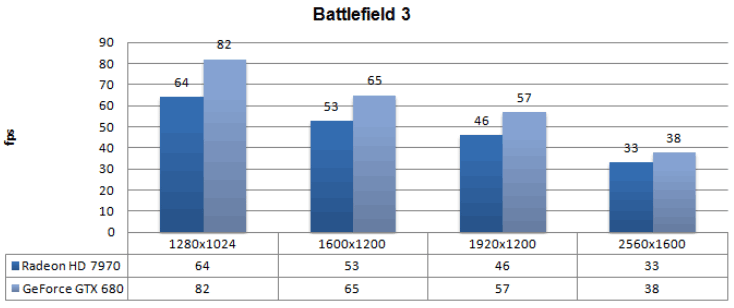

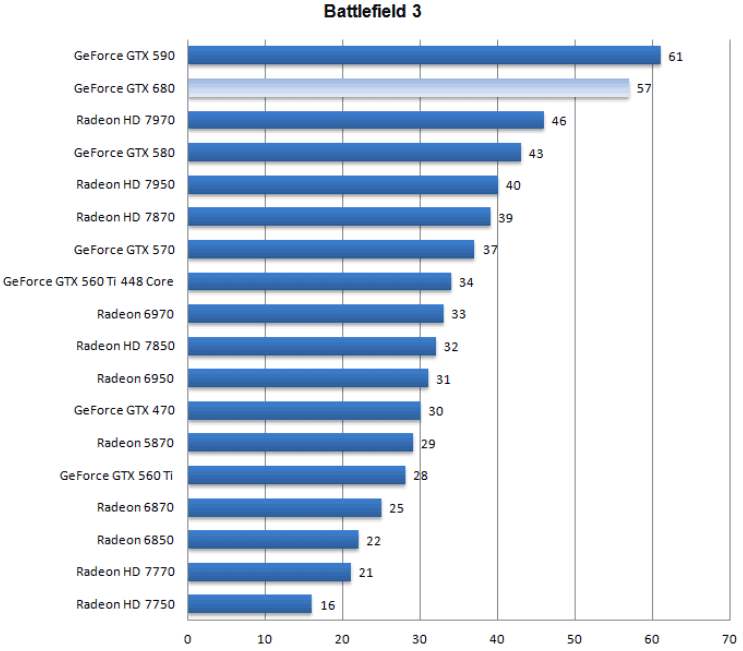

DX11: Battlefield 3

|

Тестирование проводилось на следующих настройках:

|

Используемое TimeDemo:

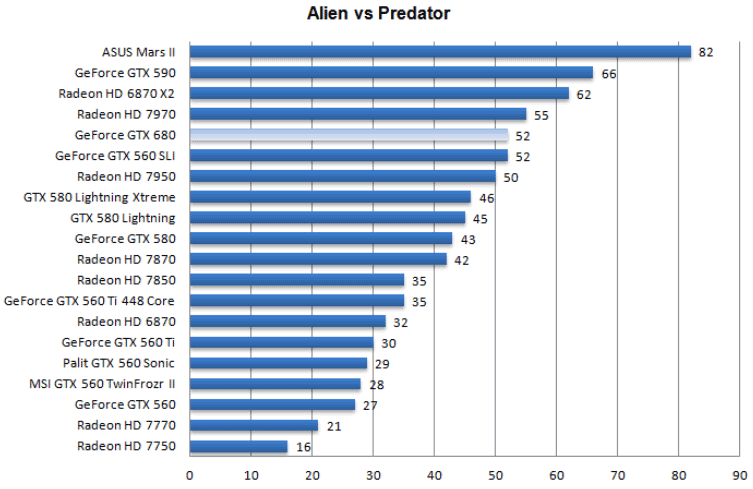

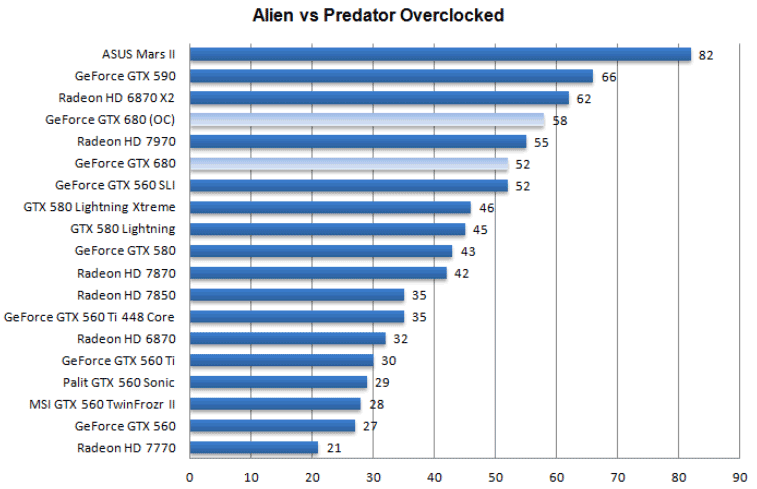

DX11: Aliens Versus Predator

|

Тестирование проводилось на следующих настройках:

|

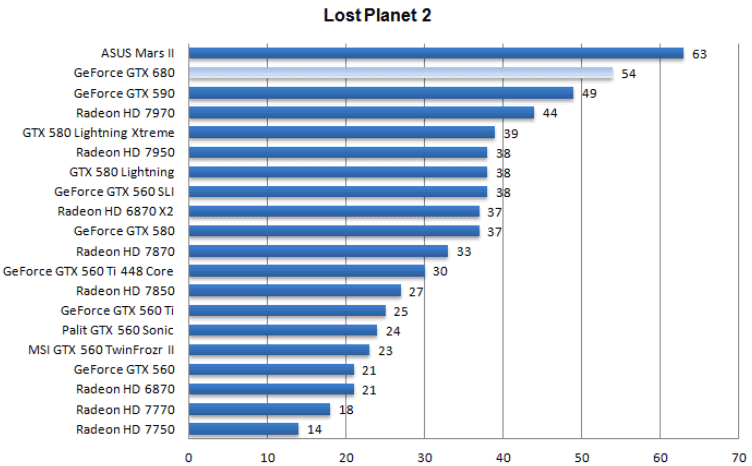

DX11: Lost Planet 2

|

Тестирование проводилось на следующих настройках:

|

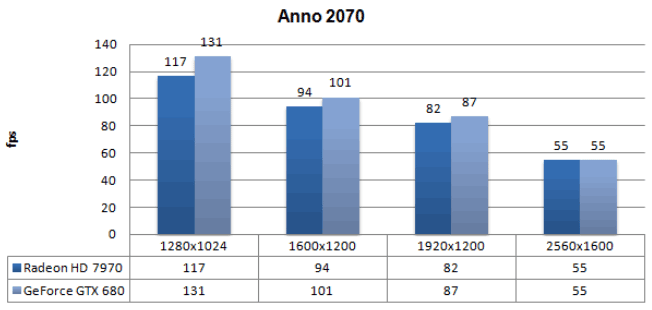

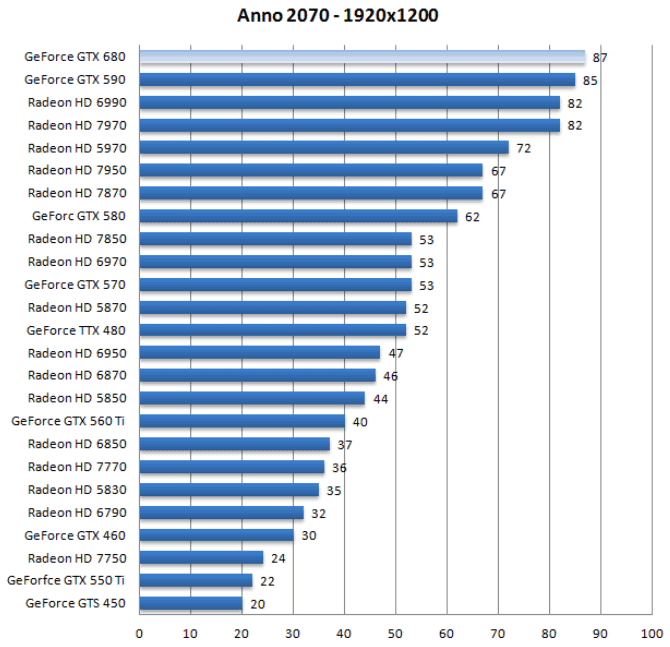

DX11: Anno 2070

|

Тестирование проводилось на следующих настройках:

|

Сводный график производительности различных решений в игре:

А вот видео из этой игры, записанное Guru3D:

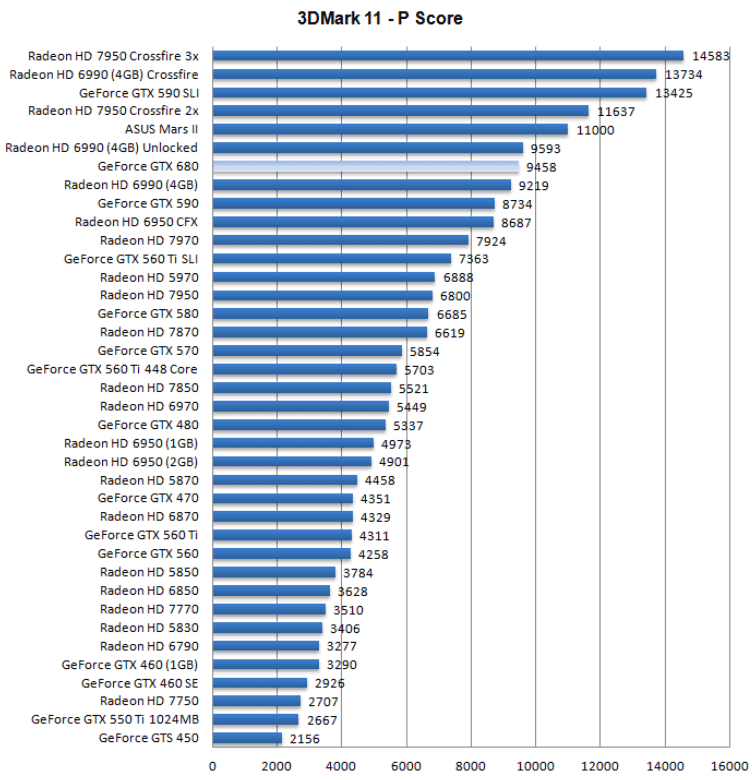

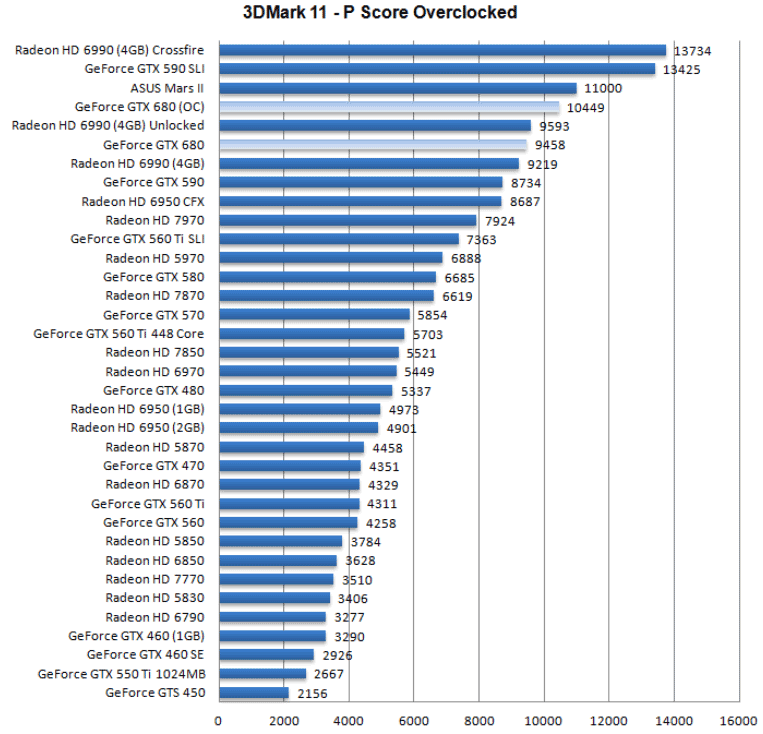

DX11: 3DMark 11

Последний из доступных 3ДМарк'ов, всегда интересно посмотреть на то, как выступят в нём различные DX11 видеокарты.

Тест проходил на пресете Performance.

Результаты разгона видеокарты GeForce GTX 680 (Kepler)

Вот тут мы наверняка увидим что-то интересное, Kepler должен себя показать в разгоне неплохо, если верить тем сплетням, что распространялись фанбоями Nvidia ещё до релиза GTX 680.

| Частоты референсной карты GeForce GTX 680 (в МГц) | Частоты GeForce GTX 680 в номинале (в МГц) | Частоты GeForce GTX 680 в разгоне (в МГц) |

| Ядро: 1006 | 1006 | 1264 |

| Boost: 1058 | 1058 | 1264 |

| Видеопамять: 6000 | 6000 | 6634 |

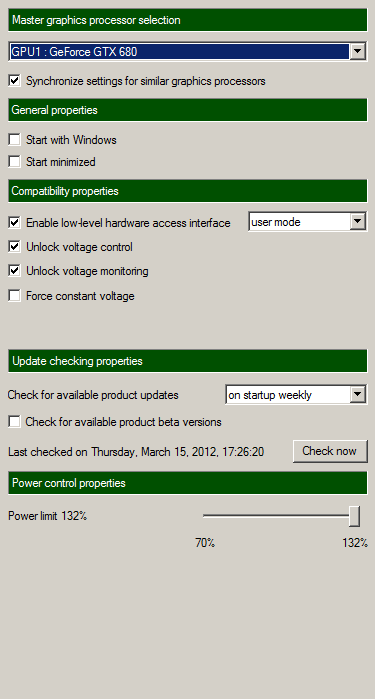

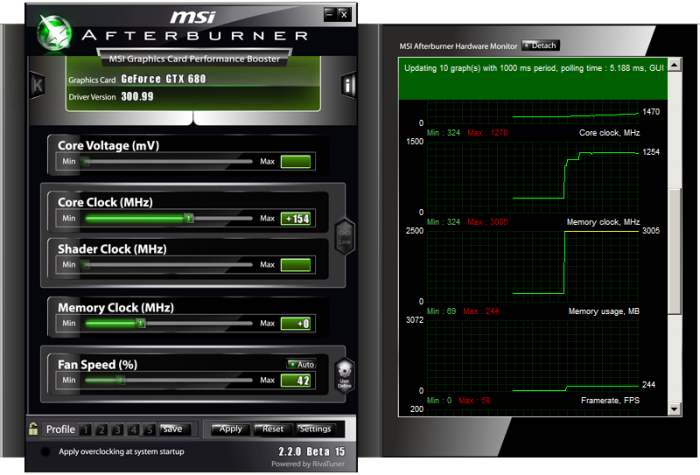

Разгоняли видеокарту с помощью утилиты MSI Afterburner:

В опциях Afterburner нужно повысить TDP карточки, как показано на скриншоте выше - до 132%. Это не позволит функции Dynamic Boost понижать частоты каждый раз, когда карточка будет превышать лимит по TDP. Нам также сообщают, что возможности изменения напряжения на графическом ядре видеокарты во время написания материала не было, потому разгон в табличке выше получен без игр с "вольтажом".

На скриншоте выше показано прибавление 154МГц к базовой тактовой частоте, т.е. частота ядра стала равной 1264МГц. Память удалось погнать до 6634МГц, однако при всём при этом система охлаждения видеокарты стала работать быстрее и потому шум от изделия повысился до 42-43дБ.

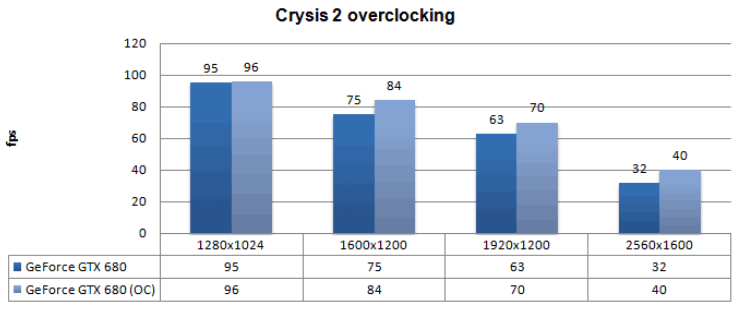

Теперь поглядим на небольшое тестирование разогнанной видеокарты. Традиционно, тест проводится в следующих приложениях: Crysis 2, 3DMark 11 и Aliens vs Predator. Смотрим результаты:

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

А вот результат в 3DMark 11:

Aliens vs Predator замыкает список тестов:

Тестирование проводилось на следующих настройках:

- DirectX 11 (Full)

- 4x Антиалиасинг

- 16х Анизотропная фильтрация

- SSAO включено

- Все настройки на максимум

Выводы

У ревьювера нашлось одно слово, чтобы описать впечатления от GTX 680 - "интересно". В плане производительности новинка удалась и в большинстве случаев бьёт более дорогую HD 7970, где-то - бьёт сильно (выигрывает с большим преимуществом), а где-то - слабо (преимущество минимально).

Несмотря на свою выдающуюся производительность, GTX 680 не является продуктом ТОП уровня, ближе к концу года (а по другим данным - в конце 3-го квартала) свет увидит решение на базе GK110, что опередит GK104 по всем параметрам.

Технология динамического изменения частоты ядра называется ревьювером довольно странной, хотя ничего плохого в том, что карточка начинает работать быстрее в тех ситуациях, когда TDP это позволяет, нет. Забавно, что заявленная частота в режиме Boost (1058МГц) на деле получается и выше, в ходе исследований она наблюдалась и в районе 1100МГц. В общем и целом, новая технология называется полезной, ибо работает она исправно.

Разгон видеокарты вполне удачен, результат в 1250МГц по ядру нельзя назвать средним и уж тем более слабым. Также порадовало заявленное энергопотребление новинки в 195 ватт, хотя в ходе тестов ревьювер намерил лишь 173 ватта, что радует ещё больше.

В плане температур не всё так гладко, как хотелось бы. Хотя тут винить нужно не саму видеокарту, а её систему охлаждения, назвать которую можно малоэффективной. Карточка не слабо шумит в работе, да и температура в районе 80 градусов по Цельсию, хоть и считается далёкой от критической, всё же ой как немала.

Подытожим материал, камрады. У Nvidia вышла крайне сильная карточка, особенно учитывая её неТОПовый статус. Она достаточно быстра, чтобы бороться на равных и побеждать HD 7970, она позволяет выводить изображение на 3-4 монитора одновременно, плюс обладает неплохим разгоном и относительно привлекательным ценником. Новый режим сглаживания TXAA порадует игроков невысоким падением производительности при серьёзном качестве картинки, а возможности NVENC облегчат жизнь тех, кому часто приходится кодировать видео в H.264.

В общем и целом, сайт Guru3D рекомендует видеокарту GeForce GTX 680 к приобретению, награждая классическим штампом:

p.s. Обязательно посмотрите "Армаду" по GTX 680, она постоянно пополняется новыми видеокартами этого семейства.

Автор оригинальной статьи - Hilbert Hagedoorn, "перевод" - Slayer Moon, эксклюзивно для www.u-sm.ru

Статья является вольным переводом, даже скорее, пересказом обзора устройства с сайта Guru3D, она не нарушает ничьих прав, ибо все права принадлежат их авторам, а фотографии к статье - фотографам с указанного выше Интернет-ресурса

Если Вы заметите ошибки, помарки и прочее - дайте мне знать: Ctrl+Enter (Орфус).

|

|

| < Одна карта - хорошо, а две - лучше. Обзор и тестирование пары ASUS GeForce GTX 680 в SLI | Небольшое тестирование мобильной графики Nvidia GeForce GT640M > |

|---|