Как и обещал, представляю вашему вниманию, уважаемые читатели, материал с Guru3D, посвящённый самой мощной на сегодняшний день видеокарте от Nvidia, речь о GeForce GTX 690. Давайте узнаем, на что способно двуглавое чудовище!

Как и обещал, представляю вашему вниманию, уважаемые читатели, материал с Guru3D, посвящённый самой мощной на сегодняшний день видеокарте от Nvidia, речь о GeForce GTX 690. Давайте узнаем, на что способно двуглавое чудовище!

Спецификации новой видеокарты от Nvidia, а также некоторых её родственниц изложены в табличке ниже:

| GTX 690 | GTX 680 | GTX 580 | |

| Потоковые процессоры | 2 х 1536 | 1536 | 512 |

| Текстурные блоки |

2 х 128 | 128 | 64 |

| ROPы | 2 х 32 | 32 | 48 |

| Частота ядра |

915МГц | 1006МГц | 772МГц |

| Частота шейдеров |

Н/Д | Н/Д | 1544МГц |

| Частота Boost | 1019МГц | 1058МГц | Н/Д |

| Частота памяти |

6.008ГГц GDDR5 | 6.008ГГц GDDR5 | 4.008ГГц GDDR5 |

| Шина памяти |

2 х 256-бит | 256-бит | 384-бит |

| Объём памяти |

2 х 2ГБ | 2ГБ | 1.5ГБ |

| FP64 | 1/24 FP32 | 1/24 FP32 | 1/8 FP32 |

| TDP | 300 ватт | 195 ватт | 244 ватта |

| Количество транзисторов |

2 х 3.5 миллиарда | 3.5 миллиарда | 3 миллиарда |

| Тех.процесс изготовления |

TSMC 28нм | TSMC 28нм | TSMC 40нм |

| Стоимость, установленная при запуске решения |

$999 | $499 | $499 |

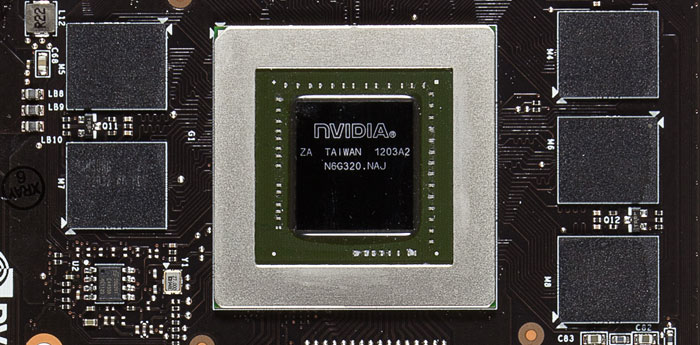

На фото выше показан чип GK104, хорошо известный нам по GTX 680, но в видеокарте GTX 690 таких чипов две штуки.

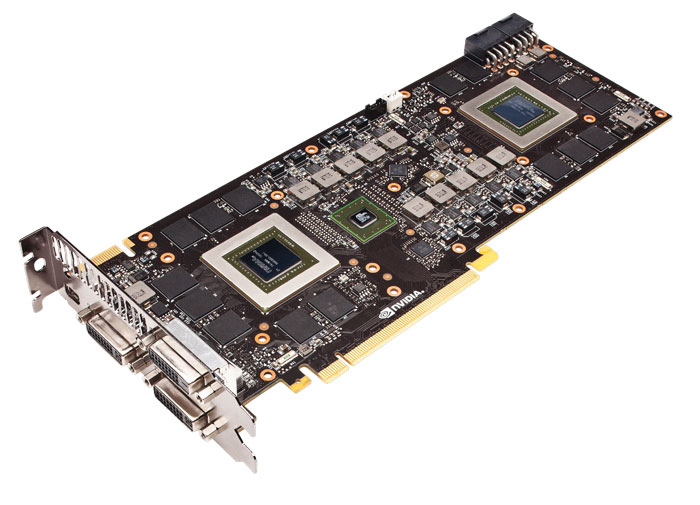

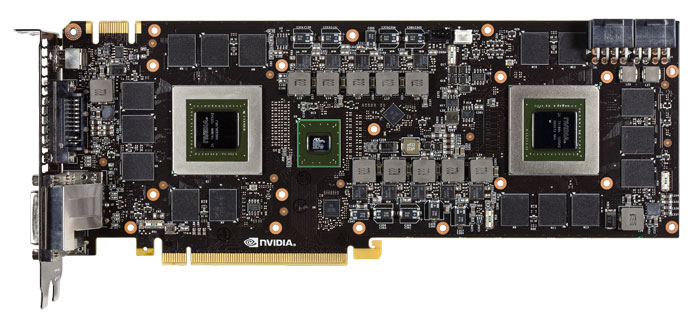

Полюбуемся печатной платой изделия Nvidia:

Фотогалерея GeForce GTX 690

Знаменитые фото коробки... нет, вернее сказать - ящика, в котором Nvidia выслала ревьюверам GTX 690. На ломике написано "использовать против зомби или...". Кстати, ломик обозревателям высылался за неделю до главной посылки.

Ящик вскрыт, видеокарта явила миру свой лик.

Длина видеокарты составляет 28 сантиметров, примерно как GTX 580, но длинее GTX 680.

На фото выше виден один SLI коннектор, а значит в тандем можно объединить две таких видеокарты. В итоге получится quad-SLI, который Nvidia никогда особенно не рекомендовала к использованию, по крайней мере так сказано в материале с Guru3D.

Выбор видеовыходов довольно необычный - три DVI (dual-link) и один mini-Display Port.

Система охлаждения видеокарты выглядит внушительно, но сможет ли она справиться с двумя чипами GK104?

Часть кожуха карты покрыта плексиглас стеклом, через который мы видим радиатор, обе его части.

Задняя сторона видеокарты. В отличие от GTX 680, на ней полно всяких выступающих частей, которые лучше постараться ненароком не сковырнуть.

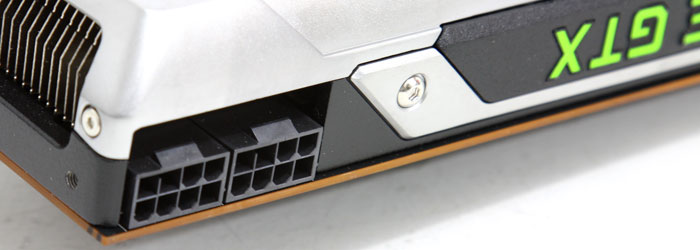

Для питания карточка использует два 8-и пиновых коннектора от блока питания. Оба графических ядра питаются по 10-и фазовой схеме.

Кулер состоит из вентилятора и двух радиаторов на основе испарительной камеры.

На фото выше видны графические чипы GK104, чип PLX, чипы памяти, регуляторы питания, резисторы и всё в таком духе.

Видеокарта стоимостью 999 долларов США установлена на материнскую плату и готова показать, кто есть who.

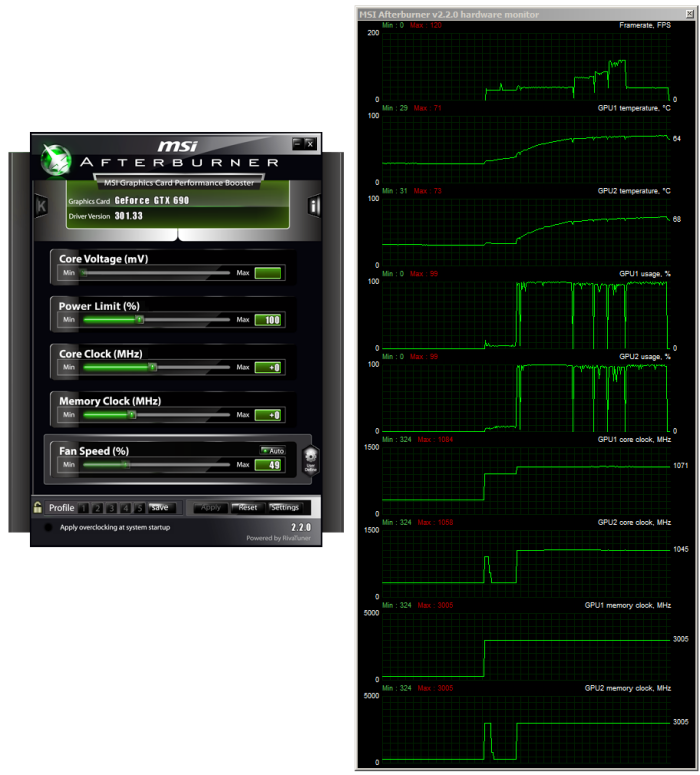

Но прежде нам показывают новинку глазами утилиты для разгона и мониторинга видеокарт MSI Afterburner:

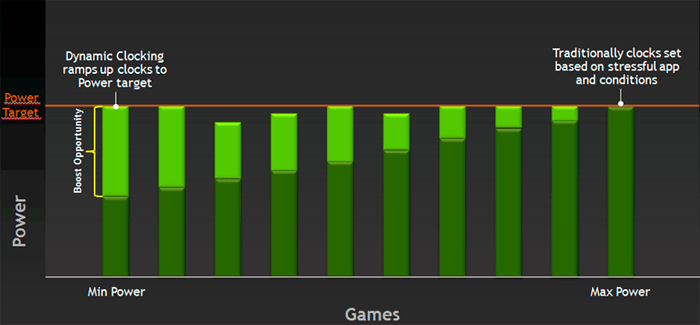

Говорится, что в стресс-тесте (не сказано, каком конкретно), базовые частоты 915/1019МГц вырастают до ~1100МГЦ отметки.

Фото настроек драйверов GeForce:

Говорится, что настраивать ничего не надо, ибо всё сразу настроено корректно.

Энергопотребление/температурный режим/уровень шума

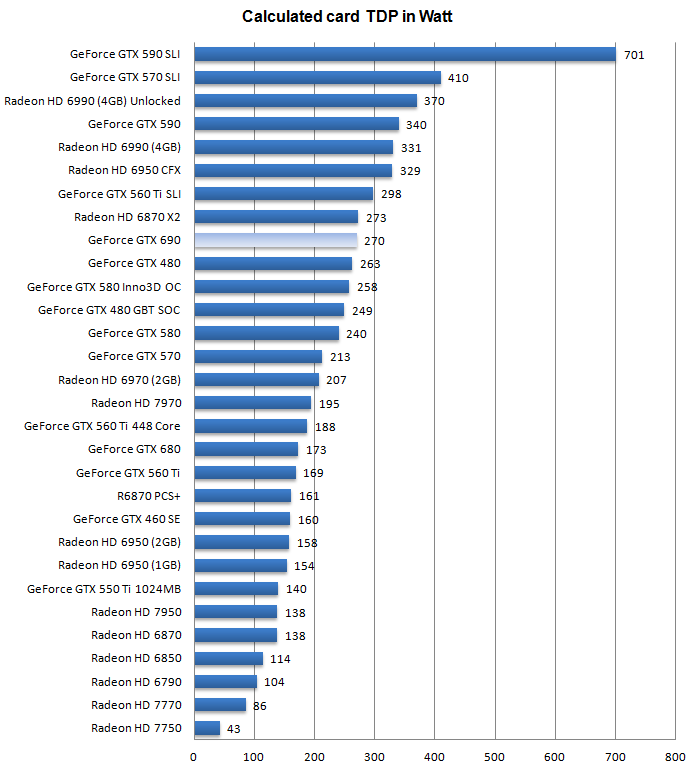

Энергопотребление видеокарты GeForce GTX 690

1. Система в режиме простоя потребляет = 150 ватт

2. Система с видеокартой в режиме полной нагрузки кушает = 400 ватт

3. Получившаяся разница = 250 ватт

4. Добавим среднее энергопотребление карты в режиме простоя ~ 20 ватт

5. И получаем энергопотребление в нагрузке = ~ 270 ватт

Поглядим, насколько хорошо / плохо выглядит GeForce GTX 690 на фоне прочих карт в плане энергопотребления:

Сравните потребление данного "двуглавого" решения и GTX 590. Вот это я понимаю - хорошо проделанная работа над изделием. Для GTX 690 Гуру3Д рекомендуют обзавестись блоком питания мощностью не менее 750 ватт для одной карточки и 950 ватт - для двух в SLI.

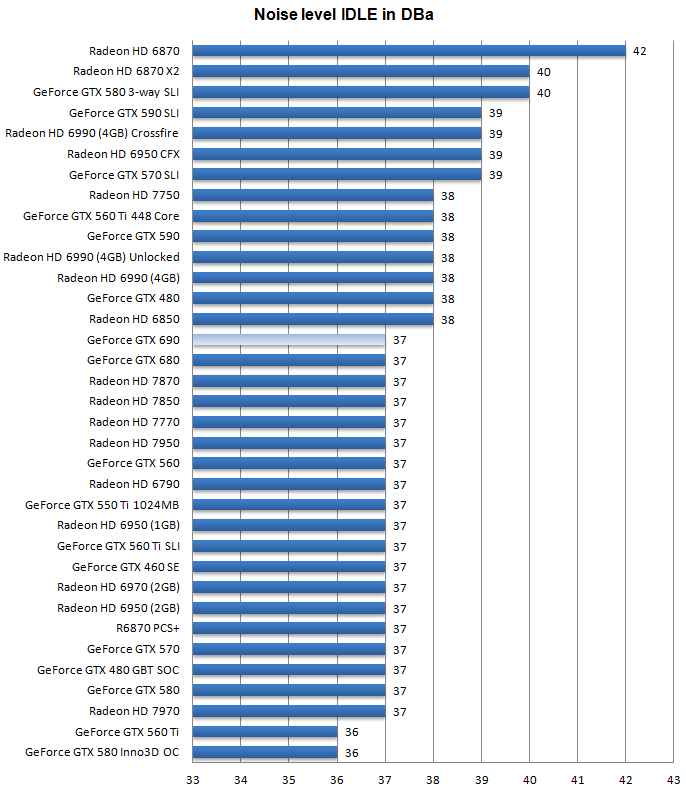

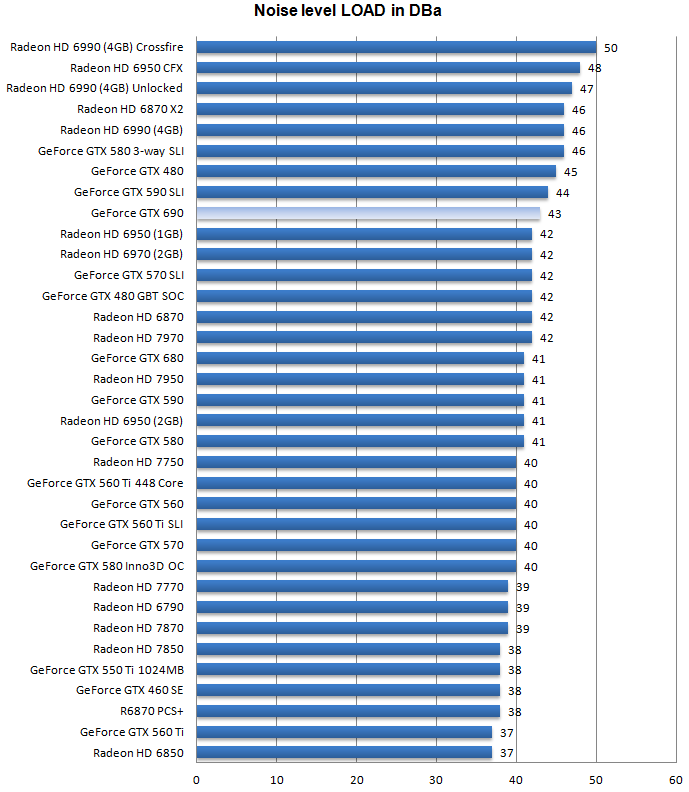

Уровень шума, издаваемый системой охлаждения видеокарты GeForce GTX 690

У "двуглавых" видеокарт всегда проблемы с шумом, посмотрим как дела с этим обстоят у GeForce GTX 690:

В простое всё хорошо, на уровне GTX 680.

А вот тут GeForce GTX 690 работает на 2 децибела громче, чем GTX 680. Нужно сказать, это далеко не худший результат. С другой стороны, более горячая и прожорливая GTX 590 на 2 децибела тише.

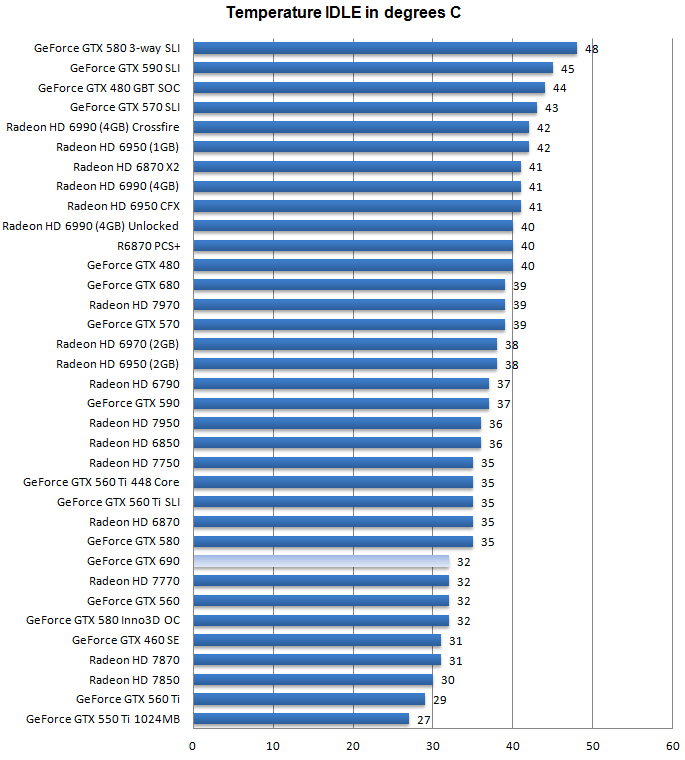

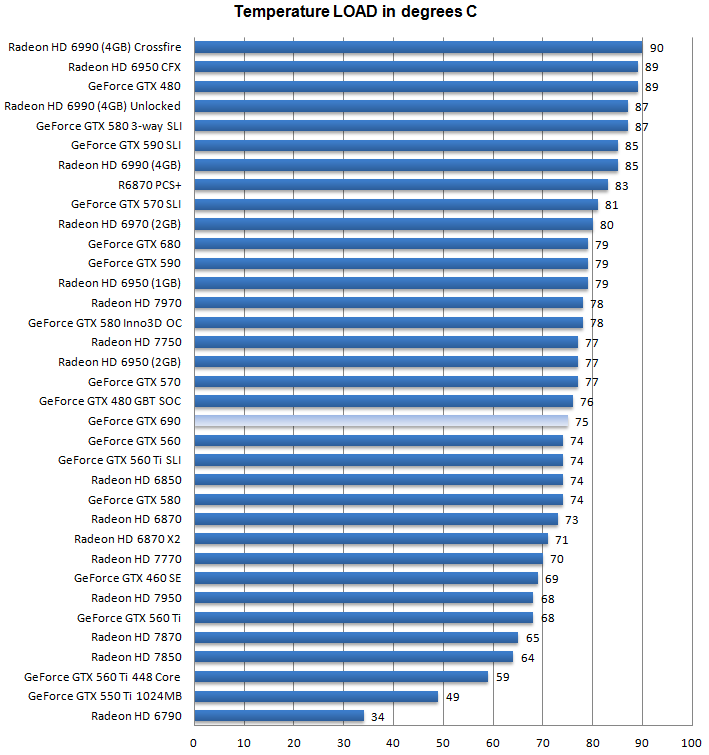

Температурный режим

Крайне важно узнать рабочие температуры GeForce GTX 690, давайте это сделаем:

Удивительно низкие температуры в простое, даже ниже, чем у GTX 680. Ну а как дела пойдут, когда карточку нагрузят игрой?

Ну ничего себе - и тут температура ядер ниже, чем у GTX 680. Вполне приличный кулер, для референсного продукта.

Конфигурация тестового стенда и используемые игры

Материнская плата - MSI Big Bang XPower X58

Процессор - Core i7 965 @ 3750 МГц

Видеокарта - GeForce GTX 690

Оперативная память - Corsair 6144МБ (3x 2048МБ) DDR3 1500 МГц

Блок питания - 1200 ватт

Монитор - Dell 3007WFP - разрешение до 2560x1600

Операционная система - Windows 7 х64 SP1

DirectX 9/10/11 End User Runtime (самые последние версии)

NVIDIA GeForce 301.хх

AMD Catalyst (12.1/12.2)

Игры и синтетические тесты:

- Metro 2033

- Battlefield Bad Company 2

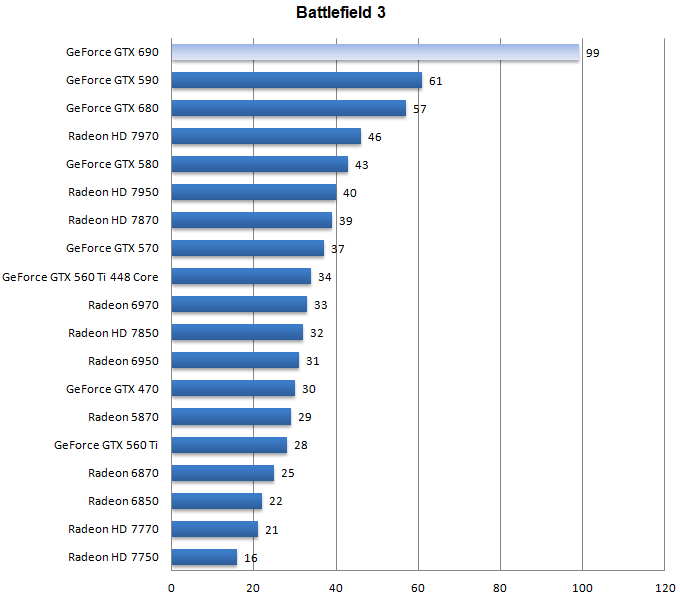

- Battlefield 3

- Far Cry 2

- Call of Duty - Modern Warfare 2

- Crysis 2 DX11 + HQ Texture pack

- Hard Reset

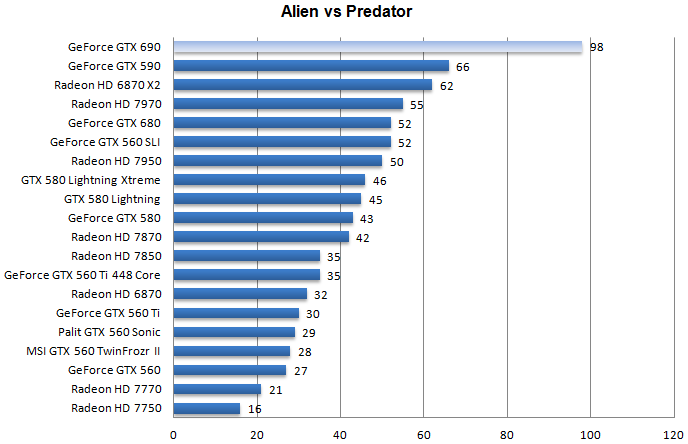

- Aliens vs Predator

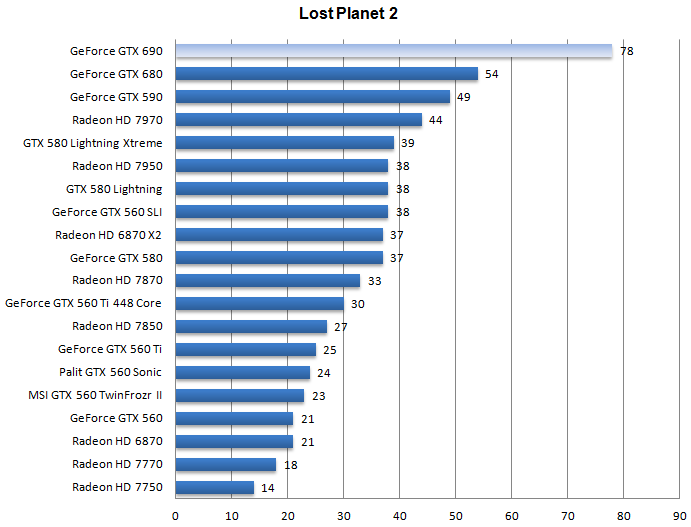

- Lost Planet 2

- Anno 1404

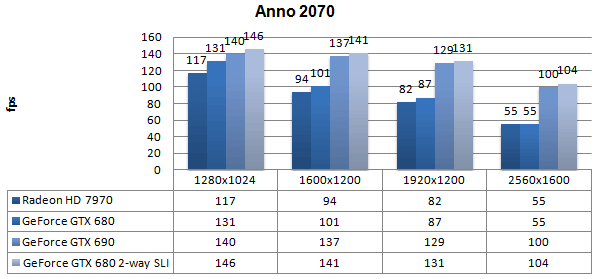

- Anno 2070

- 3DMark Vantage

- 3DMark 11

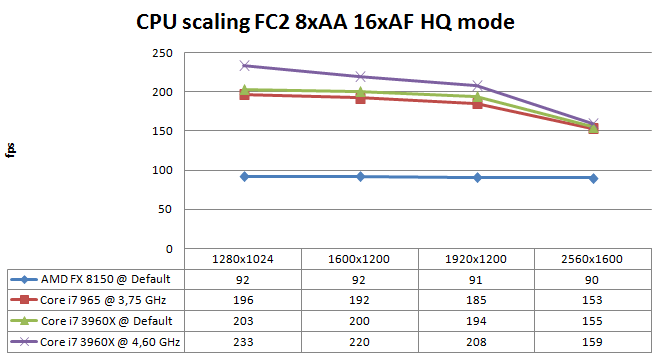

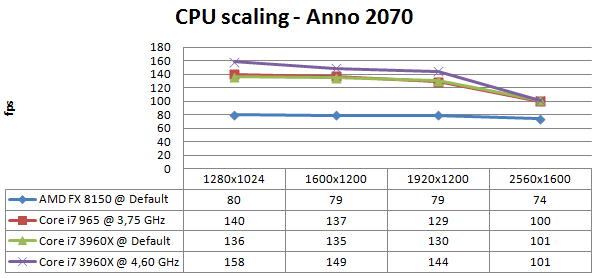

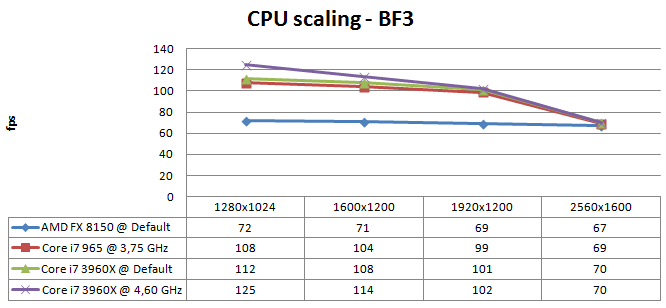

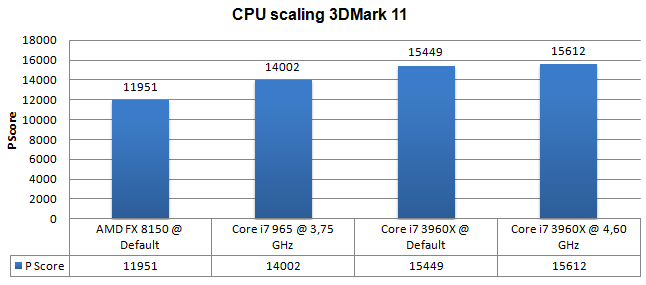

Процессорозависимость GeForce GTX 690

Нечто новое в тестах от Guru3D, камрады. Нам предлагают узнать, какой процессор сможет наилучшим образом раскрыть потенциал мощнейшей видеокарты Nvidia.

Названия приложений и настройки в них, а также список процессоров имеются на каждом из четырёх скриншотов ниже, приглашаю к их изучению:

Выводы вполне очевидны - "Бульдозер" для такой видеокарты не катит никоим образом, а разница между i7-965 (что в разгоне сравнивается автором оригинального материала с работающим на дефолтной частоте i7-2600K) и гораздо более дорогим i7-3960X не везде заслуживает внимания. Иными словами - любой современный процессор Intel Core, в разгоне или без него, раскроет потенциал GTX 690.

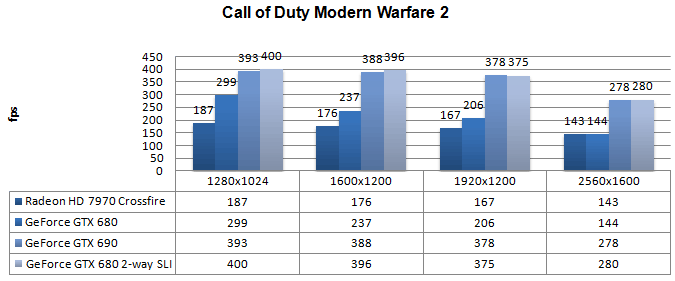

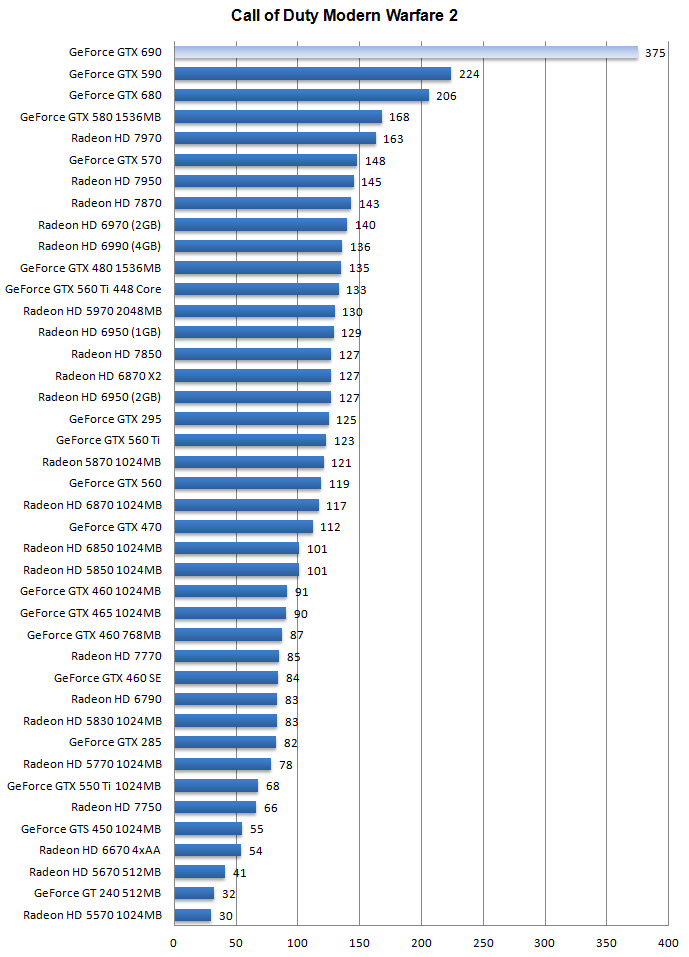

DX9: Call of Duty: Modern Warfare 2

Тестирование проводилось на следующих настройках:

- Уровень - Contingency

- 4x Антиалиасинг

- 16x Анизотропная фильтрация

- Все настройки на максимум

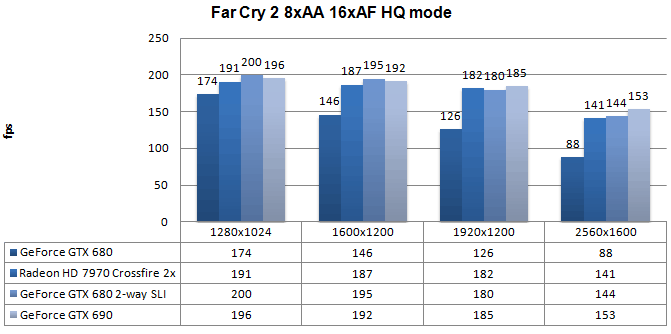

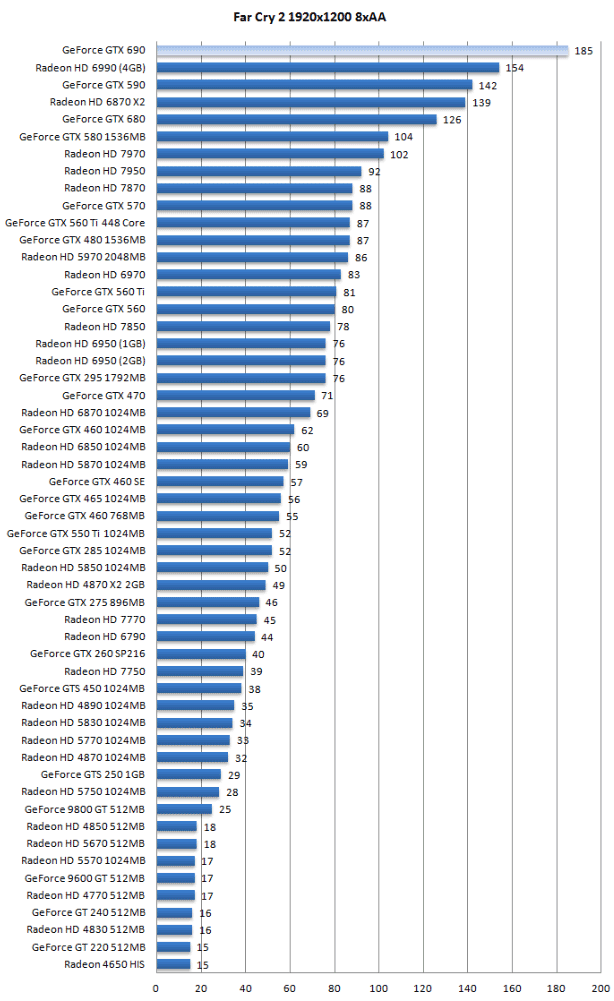

DX10: Far Cry 2

|

Тестирование проводилось на следующих настройках:

|

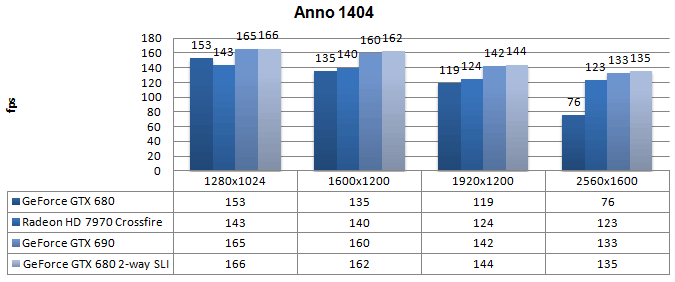

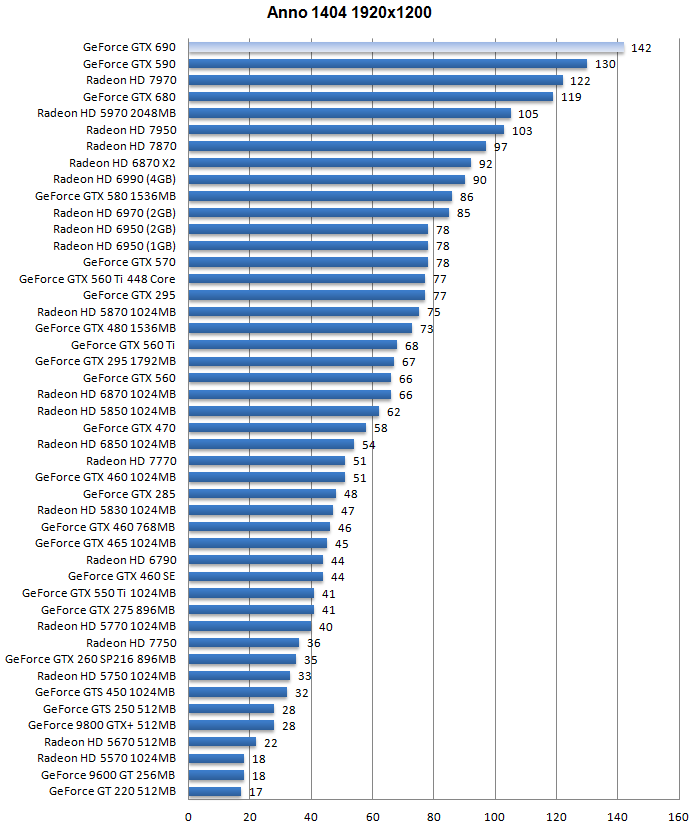

DX10: Anno 1404 - Dawn of Discovery

|

Тестирование проводилось на следующих настройках:

|

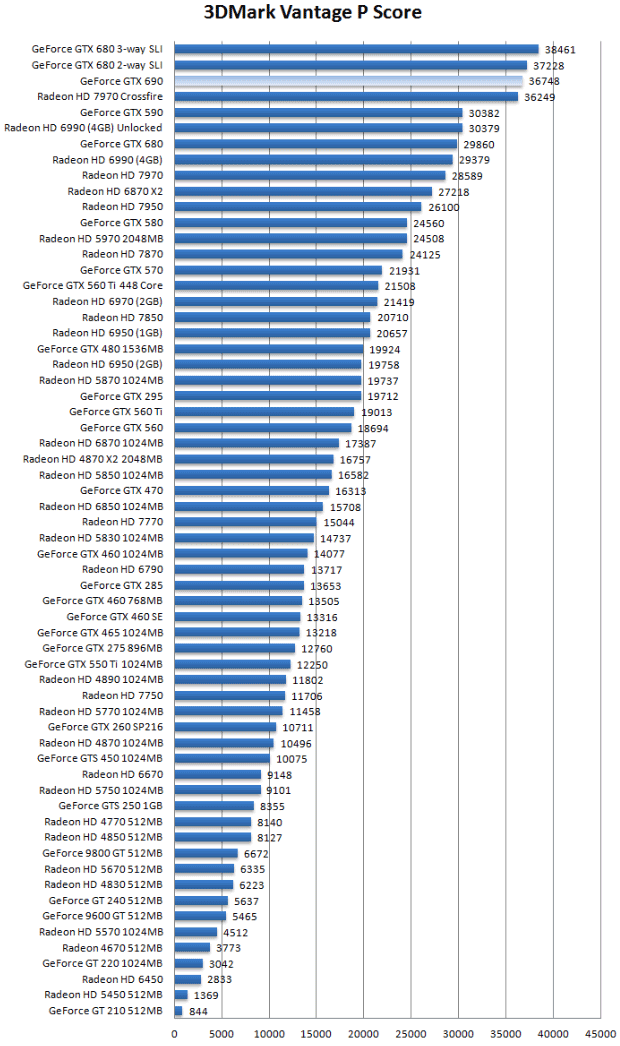

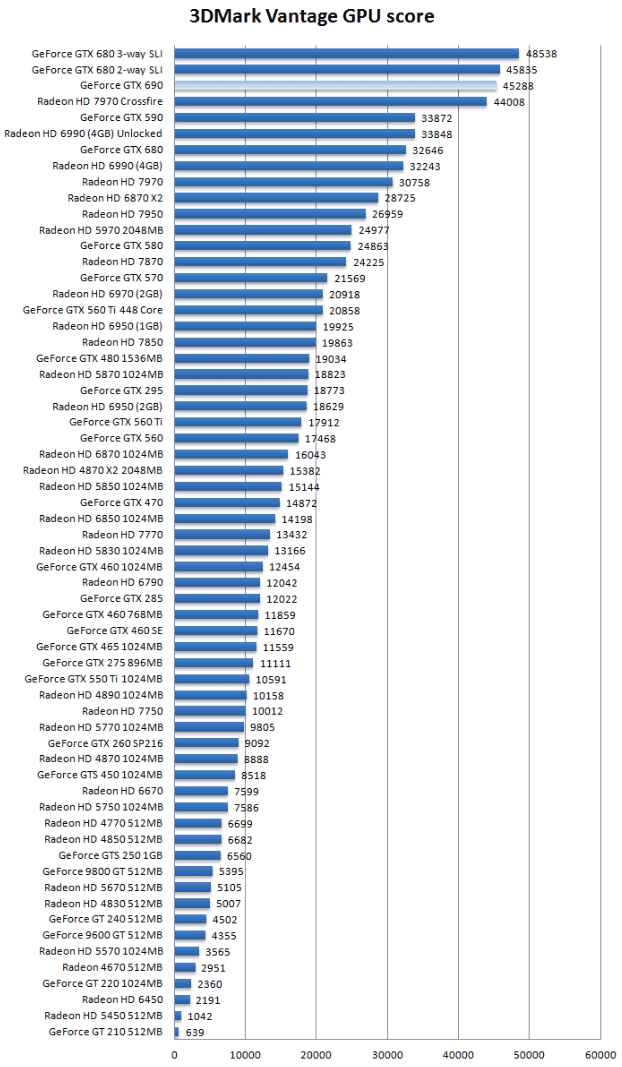

DX10: 3DMark Vantage

Как ясно из таблицы - тестирование в Вантаже происходило на пресете Performance.

Ранее, P-тестированием всё и ограничивалось, но теперь (уже в течении довольно-таки длительного периода времени) Гилберт проводит ещё и тест чисто по GPU, как наиболее правильный по его мнению:

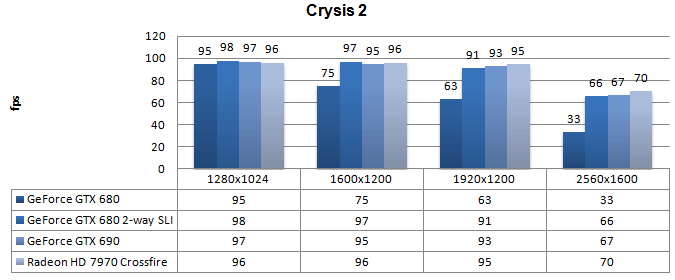

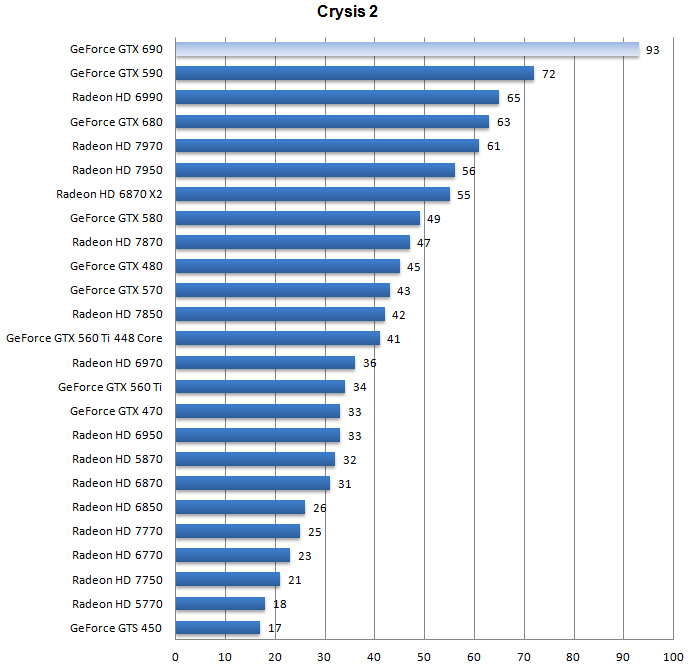

DX11: Crysis 2 + текстуры высокого разрешения

Игра тестировалась с установленным DX11 патчем и набором текстур высокого разрешения. Про пользу от инсталляции этих полезных вещей Вы можете почитать вот тут.

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

Вот какое гонялось Time Demo:

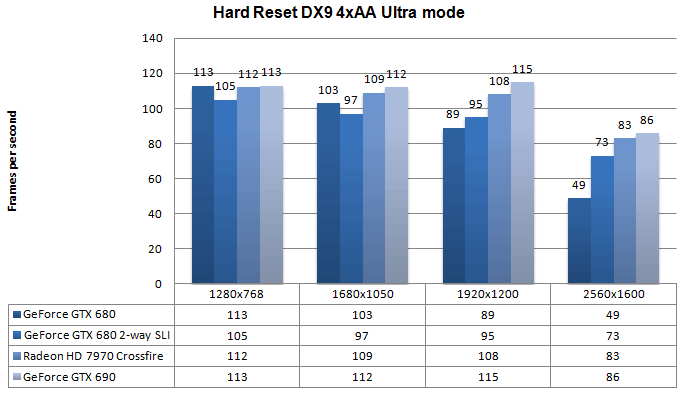

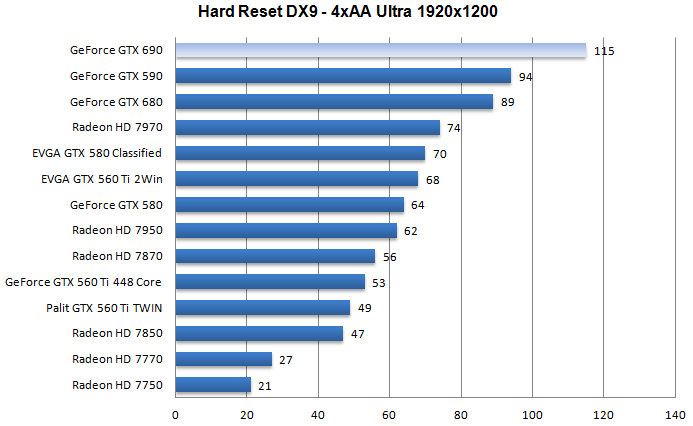

DX9: Hard Reset

|

Тестирование проводилось на следующих настройках:

|

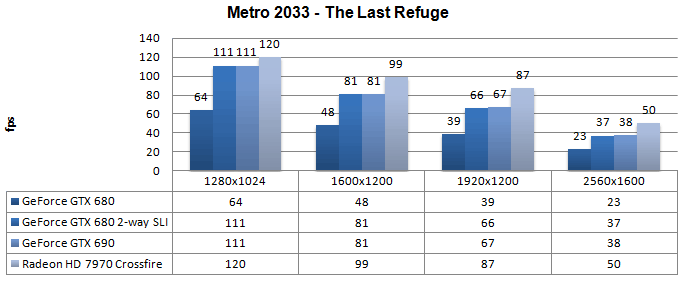

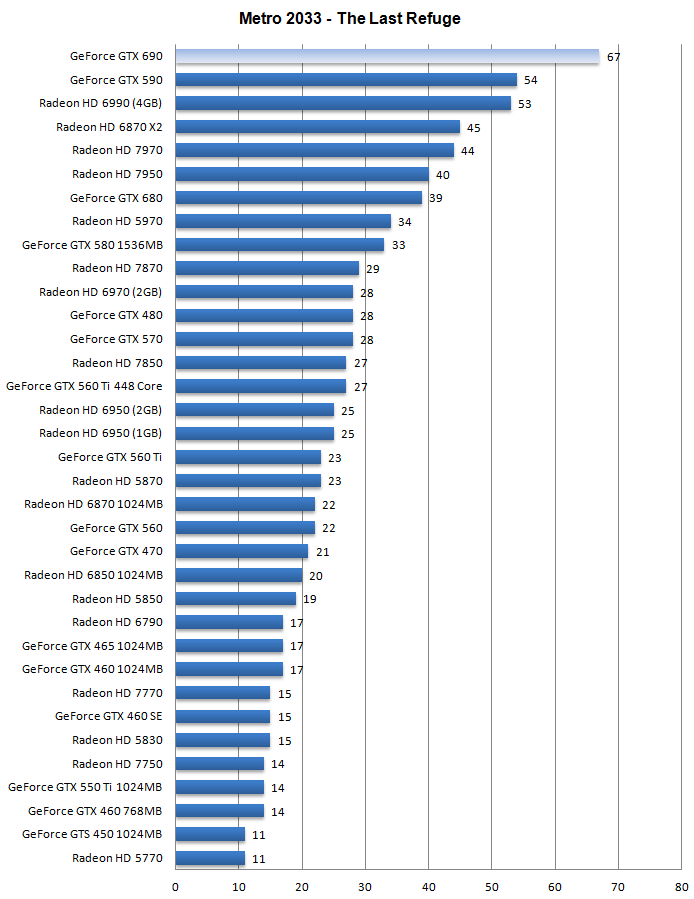

DX11: Metro 2033

|

Настройки в игре: вся графика на максимум, DX11, ААА включен, Physx выключен. |

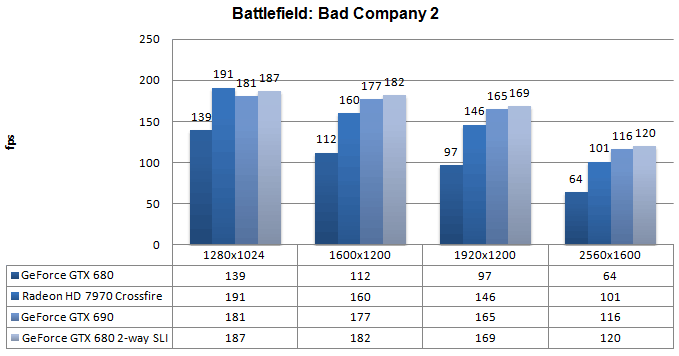

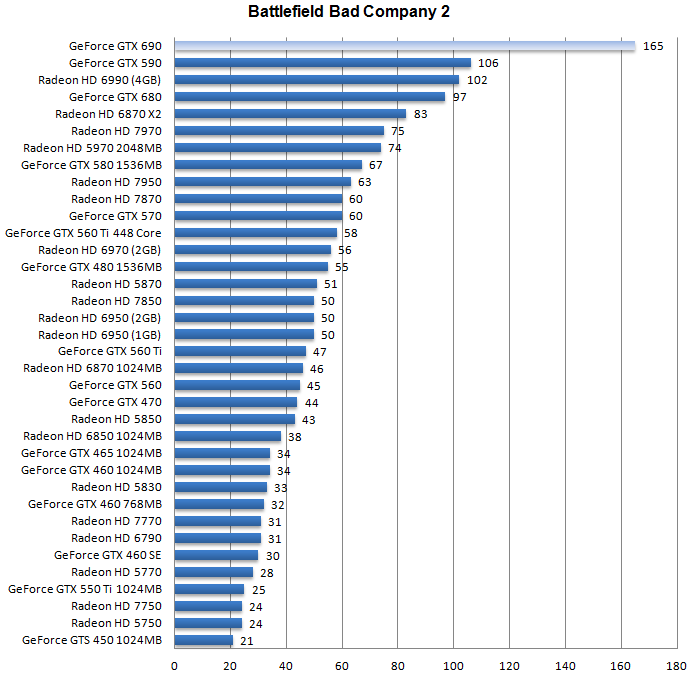

DX11: Battlefield Bad Company 2

|

Тестирование проводилось на следующих настройках:

|

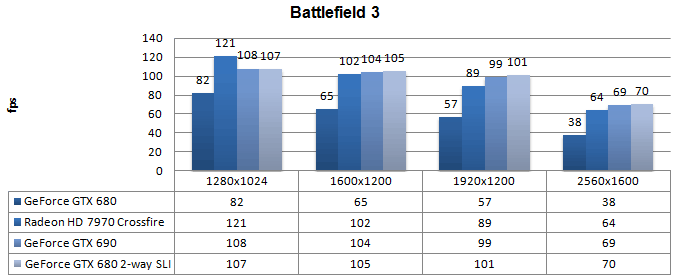

DX11: Battlefield 3

|

Тестирование проводилось на следующих настройках:

|

Используемое TimeDemo:

DX11: Aliens Versus Predator

|

Тестирование проводилось на следующих настройках:

|

DX11: Lost Planet 2

|

Тестирование проводилось на следующих настройках:

|

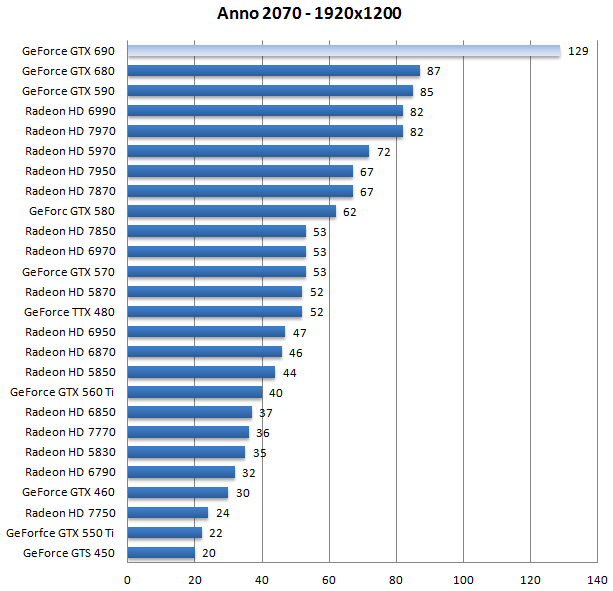

DX11: Anno 2070

|

Тестирование проводилось на следующих настройках:

|

Сводный график производительности различных решений в игре:

А вот видео из этой игры, записанное Guru3D:

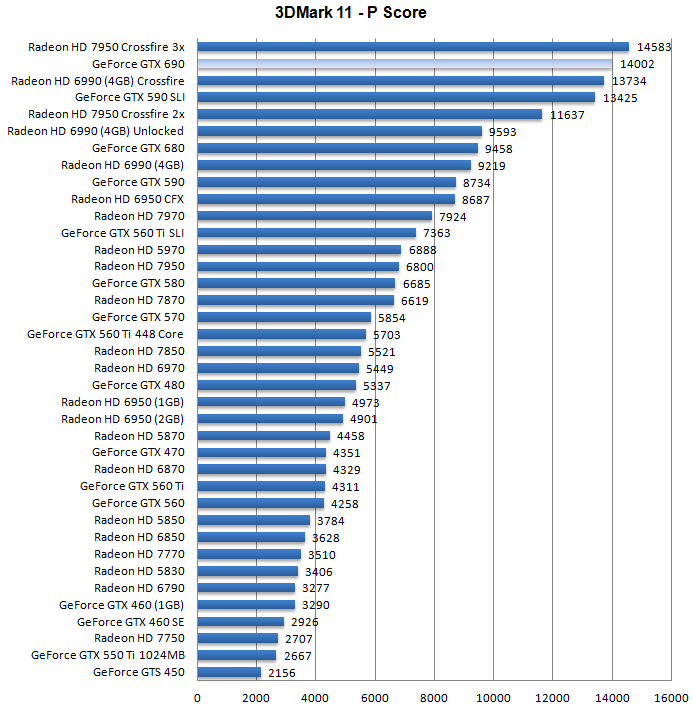

DX11: 3DMark 11

Последний из доступных 3ДМарк'ов, всегда интересно посмотреть на то, как выступят в нём различные DX11 видеокарты.

Тест проходил на пресете Performance.

Результаты разгона видеокарты GeForce GTX 690

Мне очень интересно, насколько можно разогнать "двуглавый" ТОП Nvidia - сможет ли он продемонстрировать более интересный результат, чем GTX 680?

| Частоты референсной карты GeForce GTX 690 (в МГц) | Частоты GeForce GTX 690 в номинале (в МГц) | Частоты GeForce GTX 690 в разгоне (в МГц) |

| Ядро: 915 | 915 | 1250 |

| Boost: 1019 | 1019 | 1250 |

| Видеопамять: 6000 | 6000 | 7200 |

Для сравнения, вот как погналась карточка Gigabyte GeForce GTX 680 OC Edition:

| Частоты референсной карты GeForce GTX 680 (в МГц) | Частоты Gigabyte GeForce GTX 680 OC Edition в номинале (в МГц) | Частоты Gigabyte GeForce GTX 680 OC Edition в разгоне (в МГц) |

| Ядро: 1006 | 1071 | 1171 |

| Boost: 1058 | 1123 | 1250 |

| Видеопамять: 6000 | 6000 | 6612 |

Разгоняли видеокарту с помощью утилиты MSI Afterburner, автор оригинального материала советует для использования последнюю (2.2.0) версию. Power Limit был увеличен до 35%, чтобы частоты в режиме Dynamic Boost не скакали туда-сюда. Сообщается, что на данный момент нет возможности регулировки напряжения посредством софта, так что разгон проводился без игр с "вольтажом". Кулер в разгоне работал на 70%, шумел он на такой скорости очень ощутимо.

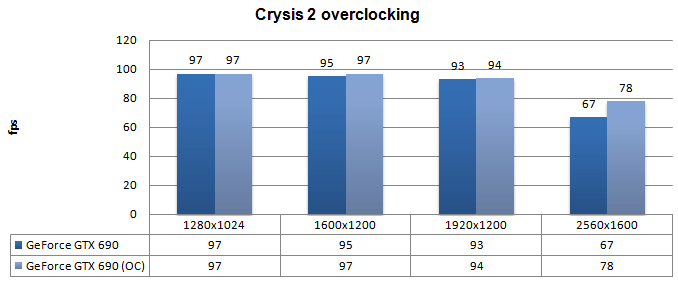

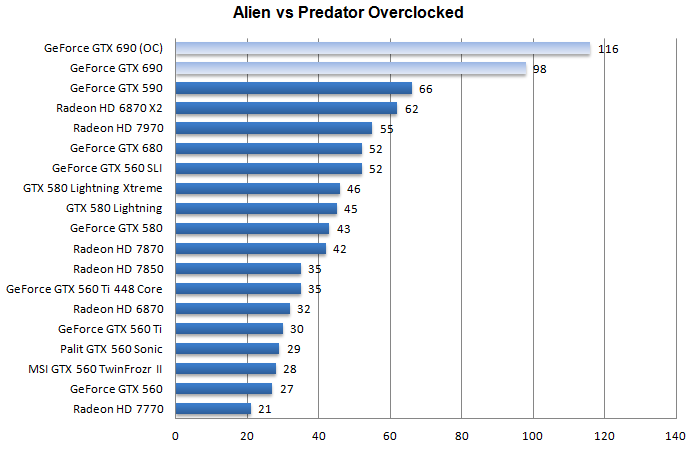

Далее нам покажут достижения разогнанной GTX 690 в некоторых приложениях. Традиционно, тест проводится в следующих играх/бенчмарках: Crysis 2, 3DMark 11 и Aliens vs Predator. Смотрим результаты:

Тестирование проводилось на следующих настройках:

- DirectX 11

- Установлен набор текстур высокого разрешения

- Качество графики - Ultra

- 4xAA

- Уровень - Times Square (2-х минутное time demo)

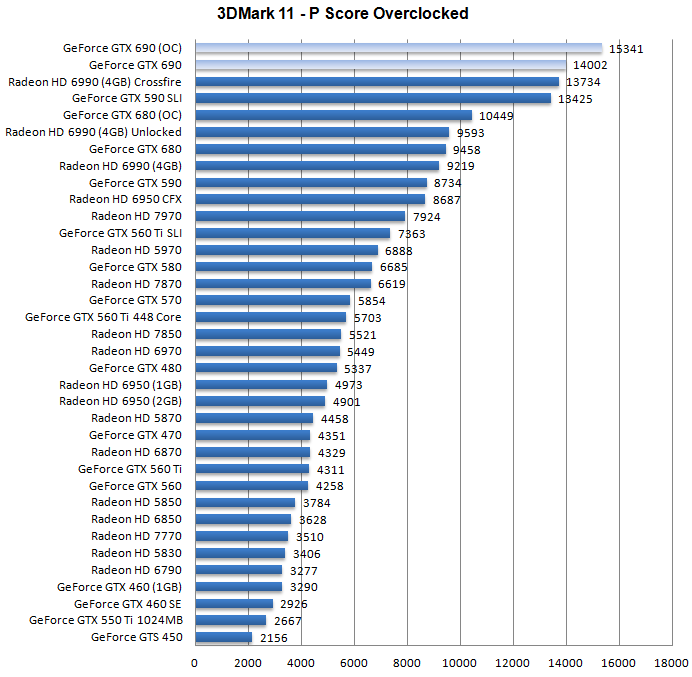

А вот результат в 3DMark 11:

Aliens vs Predator замыкает список тестов:

Тестирование проводилось на следующих настройках:

- DirectX 11 (Full)

- 4x Антиалиасинг

- 16х Анизотропная фильтрация

- SSAO включено

- Все настройки на максимум

Выводы

Новинка от Nvidia называется буквально зверской видеокартой - как по производительности, так и по цене. Почти тысяча долларов США - шутка ли? С другой стороны, такая покупка выглядит удачнее, чем приобретение пары референсных GTX 680 со схожей производительностью, но более высоким суммарным шумом и энергопотреблением (да и количеством занимаемого в ПК места).

GTX 690 выглядит не в пример лучше прошлого двухчипового решения "зелёного лагеря", видеокарты GeForce GTX 590 - как в плане производительности, так и во многих других. В новинке используется более семи миллиардов транзисторов (в одних лишь графических ядрах), что должно впечатлить кого угодно... наверное.

Далее нам расписывается, насколько хорошо выступила новинка в играх, но я это пересказывать не буду, ибо зачем тогда публиковались сами тесты? Важно отметить, что ревьювер подсчитал, что производительности одной GTX 690 хватит для 40-50 FPS в играх в разрешении 5760х1080. Да и для 3Д гейминга двухчиповый монстр подойдёт прекрасно.

Энергопотребление изделия называется крайне адекватным, его даже сравнивают с показателем одночипового ТОПа прошлого поколения, GTX 580. Касаемо температур - нас предупреждают, что они могут быть в районе ниже 80 градусов по Цельсию при особо интенсивной и долгой игре. Опасаться их не стоит, просто стоит иметь в виду такие данные и обзавестись достойным корпусом с хорошей системой охлаждения.

Шум в игровой нагрузке называется вполне приемлемым, если, конечно, карточку не разгонять - вот тогда он даст о себе знать. Автор оригинального материала рекомендует к такой видеокарте процессор Core i5-2500 как добротное решение, ну а если есть 3570/3770 (Ivy Bridge) - то и вовсе хорошо, ведь только они совместимы с PCIe Gen 3.0.

Проблем с драйверами в ходе тестирования также не было обнаружено - все игры работали прекрасно и показывали хороший прирост по сравнению с одиночной GTX 680.

В общем и целом, сайт Guru3D рекомендует видеокарту GeForce GTX 690 к приобретению тем, для кого производительность в играх важнее стоимости графического адаптера. Продукту Nvidia присуждается высокая награда:

p.s. Обязательно посмотрите "Армаду" по GTX 690, она постоянно пополняется новыми видеокартами этого семейства.

Автор оригинальной статьи - Hilbert Hagedoorn, "перевод" - Slayer Moon, эксклюзивно для www.u-sm.ru

Статья является вольным переводом, даже скорее, пересказом обзора устройства с сайта Guru3D, она не нарушает ничьих прав, ибо все права принадлежат их авторам, а фотографии к статье - фотографам с указанного выше Интернет-ресурса

Если Вы заметите ошибки, помарки и прочее - дайте мне знать: Ctrl+Enter (Орфус).

|

|

| < Обзор и тестирование видеокарты Zotac GeForce GTX 680 AMP! Edition | Тестирование Intel HD 4000 (интегрированное видео в процессорах Ivy Bridge) > |

|---|